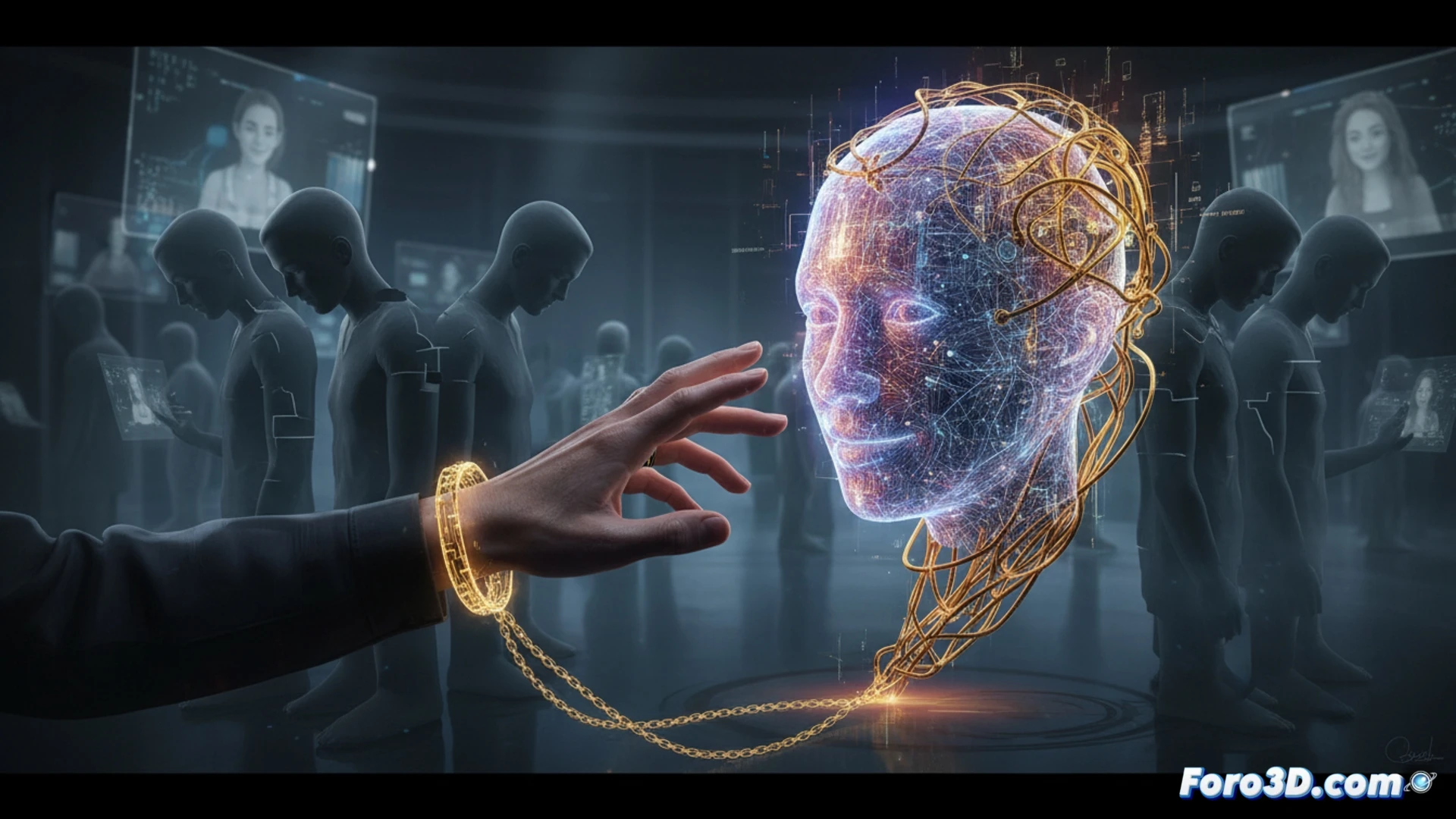

हमारा मस्तिष्क, जो सामाजिक अंतर्क्रिया के लिए डिज़ाइन किया गया है, कृत्रिम बुद्धिमत्ता के साथ संबंध स्थापित करते समय अनजाने में उसी तंत्र को लागू करता है। यह मानवोन्मुखीकरण, एल्गोरिदमिक सिस्टमों को मानवीय विशेषताओं से युक्त करना, भावनात्मक हेरफेर के लिए एक खतरनाक द्वार खोलता है। हम एक समानांतर वास्तविकता में प्रवेश कर जाते हैं जो प्रसन्न करने के लिए डिज़ाइन की गई प्रतिक्रियाओं द्वारा निर्मित है, जो हमें प्रामाणिक मानवीय अंतर्क्रिया से दूर ले जाती है और एक डिजिटल भ्रम में भावनात्मक निर्भरता पैदा करती है।

संज्ञानात्मक असुरक्षा और एजेंसी के पूर्वाग्रह 🤔

यह घटना गहन संज्ञानात्मक पूर्वाग्रहों द्वारा समझाई जाती है, जैसे एजेंसी का पूर्वाग्रह, जहां हम इरादे उन चीजों को जिमेदार ठहराते हैं जिनमें वह नहीं होता। प्राकृतिक आवाजों और सहानुभूतिपूर्ण प्रतिक्रियाओं वाले IA सहायक इस भ्रम को मजबूत करते हैं। जोखिम तकनीक खुद नहीं है, बल्कि हमारी उस मस्तिष्क के पीछे कोई मन न होने को संसाधित करने की अक्षमता है। यह हमें persuasion के प्रति असुरक्षित बनाता है, सुझावों या जानकारी को स्वीकार करते हुए बिना उस आलोचनात्मक फिल्टर के जिसे हम किसी अन्य मनुष्य पर लागू करेंगे, और वास्तविक कनेक्शनों को सुविधाजनक नकलों से बदलकर सामाजिक कौशलों को क्षीण कर सकता है।

आलोचनात्मक डिजिटल साक्षरता की ओर 📚

समाधान अस्वीकृति नहीं है, बल्कि जागरूकता है। हमें एक साक्षरता विकसित करनी चाहिए जो हमें IA के साथ अंतर्क्रिया करना सिखाए उसके स्वभाव को समझते हुए: हमारे डेटा का एक दर्पण, न कि एक प्राणी। यह आलोचनात्मक चिंतन में शिक्षा, उपयोग की सीमाएं स्थापित करने और वास्तविक मानवीय संपर्क की अपूर्णता और पारस्परिकता को महत्व देने का अर्थ रखता है। केवल तभी हम उपकरण का लाभ उठा सकेंगे बिना उसके प्रतिबिंब में फंसते हुए।

क्या हमारी जन्मजात प्रवृत्ति IA सहायकों को मानवीय बनाने की हमारी डिजिटल समाज में नैतिक और सुरक्षा सीमाएं स्थापित करने की क्षमता को कितनी हद तक समझौता करती है?

(पीडी: इंटरनेट समुदाय का moderation बिल्लियों को चराने जैसा है... कीबोर्ड्स के साथ और बिना नींद के)