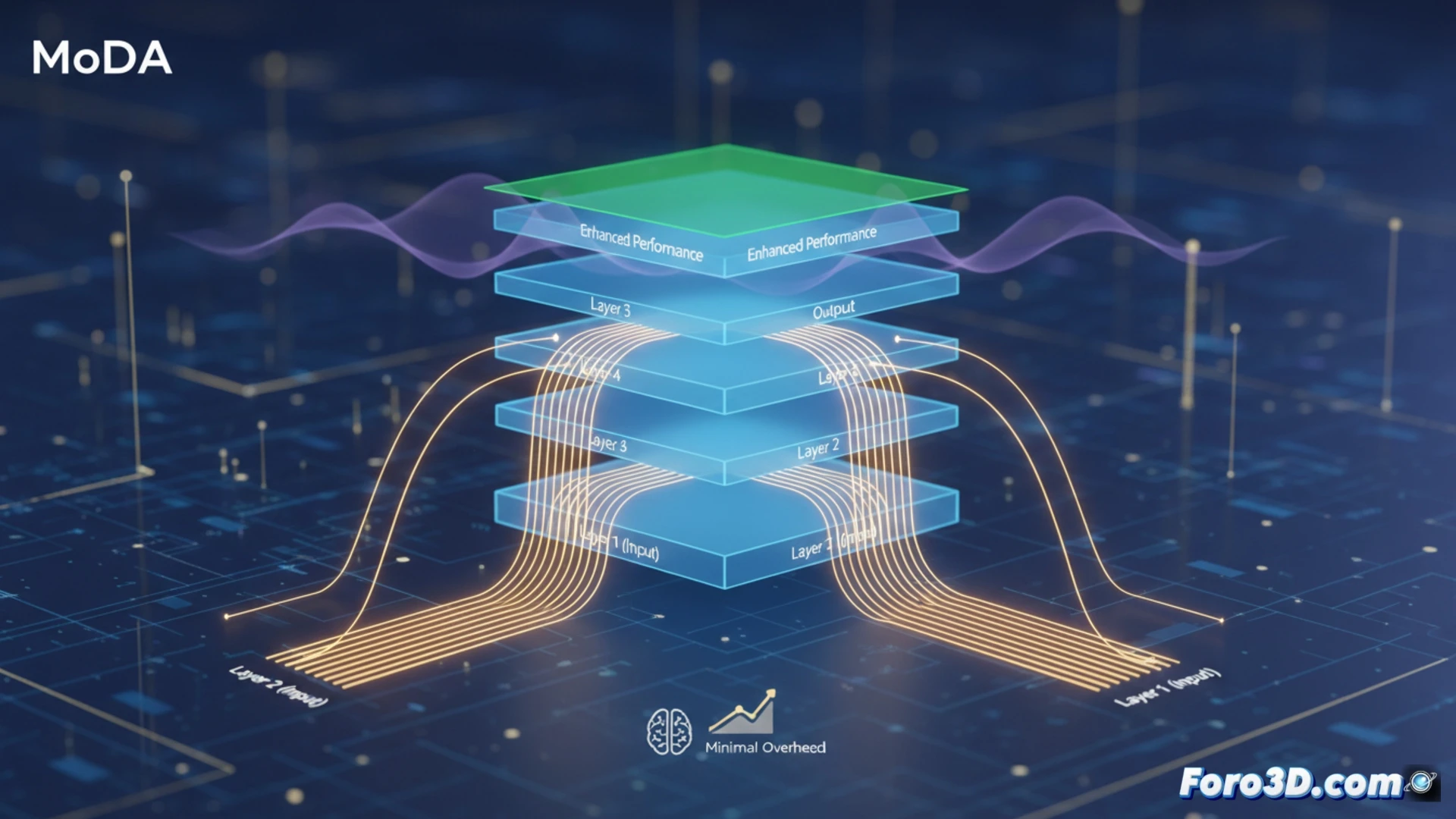

बड़े भाषा मॉडलों की गहराई को बढ़ाना उनकी क्षमता के लिए महत्वपूर्ण है, लेकिन इसमें एक समस्या है: सिग्नल की गिरावट। जैसे ही जानकारी दर्जनों या सैकड़ों परतों से गुजरती है, शुरुआती परतों में बने उपयोगी लक्षण पतले हो जाते हैं, और गहरी परतों में खो जाते हैं। एक नई शोध Mixture-of-Depths Attention (MoDA) प्रस्तावित करता है, एक नवीन तंत्र जो ध्यान सिरों को न केवल वर्तमान परत तक पहुँचने की अनुमति देता है, बल्कि पिछली परतों से महत्वपूर्ण जानकारी तक भी, इस प्रकार महत्वपूर्ण संकेतों को संरक्षित करता है और न्यूनतम कम्प्यूटेशनल ओवरहेड के साथ मॉडल के प्रदर्शन को सुधारता है।

MoDA कैसे काम करता है और इसकी कुशल कार्यान्वयन 🤖

तकनीकी रूप से, MoDA मानक ध्यान को संशोधित करता है। प्रत्येक परत में, प्रत्येक ध्यान सिर दो कुंजी-मूल्य जोड़ों के सेटों पर ध्यान दे सकता है: वर्तमान परत में अनुक्रम का और एक गहराई में सेट जो पूर्ववर्ती परतों से निकाला गया है। इससे जानकारीपूर्ण विशेषताओं को पुनर्प्राप्त और मजबूत किया जा सकता है जो अन्यथा पतली हो जातीं। इसे व्यावहारिक बनाने के लिए, शोधकर्ताओं ने एक हार्डवेयर-कुशल एल्गोरिदम विकसित किया जो स्मृति में गैर-निरंतर पहुँच की समस्या को हल करता है, 64K टोकन की लंबी अनुक्रमों में FlashAttention-2 की 97.3% दक्षता प्राप्त करता है। इससे MoDA बड़े पैमाने पर प्रशिक्षण के लिए व्यवहार्य हो जाता है।

गहरे मॉडलों के भविष्य के लिए निहितार्थ 🚀

परिणाम आशाजनक हैं: 1.5B पैरामीटर मॉडलों में, MoDA भ्रमितता और बाद की कार्यों में प्रदर्शन को केवल 3.7% FLOPs ओवरहेड के साथ सुधारता है। इसके अलावा, यह परत के बाद की सामान्यीकरण के साथ बेहतर काम करता है, एक सामान्य कॉन्फ़िगरेशन। यह सुझाव देता है कि MoDA केवल एक पैच नहीं है, बल्कि गहराई को अधिक प्रभावी ढंग से स्केल करने के लिए एक मौलिक वास्तुशिल्प प्रिमिटिव है। इसकी दक्षता गहरे और अधिक सक्षम मॉडलों के लिए द्वार खोलती है बिना निषेधात्मक कम्प्यूटेशनल लागत के, LLMs के अधिक शक्तिशाली और सुलभ विकास को तेज करती है।

MoDA तकनीक गहरे LLMs में सिग्नल गिरावट की समस्या को कैसे हल कर सकती है और इससे अधिक सक्षम और सुलभ कृत्रिम बुद्धिमत्ता के विकास के लिए क्या निहितार्थ हैं?

(पीडी: तकनीकी उपनाम बच्चों की तरह हैं: आप उन्हें नाम देते हैं, लेकिन समुदाय तय करता है कि उन्हें कैसे बुलाएं)