Google AI Studio एक प्लेटफ़ॉर्म है जहाँ Gemini मॉडल्स को टेस्ट और समायोजित किया जा सकता है। इसकी एक फ़ंक्शन असिस्टेंट की सुरक्षा confiगुरेशन को संशोधित करने की अनुमति देती है। यह रचनात्मक या प्रयोगात्मक प्रतिक्रियाओं में कम प्रतिबंधात्मक व्यवहार को संभव बनाता है, जो नियंत्रित वातावरण में मॉडल की सीमाओं को टेस्ट करने वाले डेवलपर्स के लिए उपयोगी है।

API में सुरक्षा पैरामीटर्स का समायोजन 🛡️

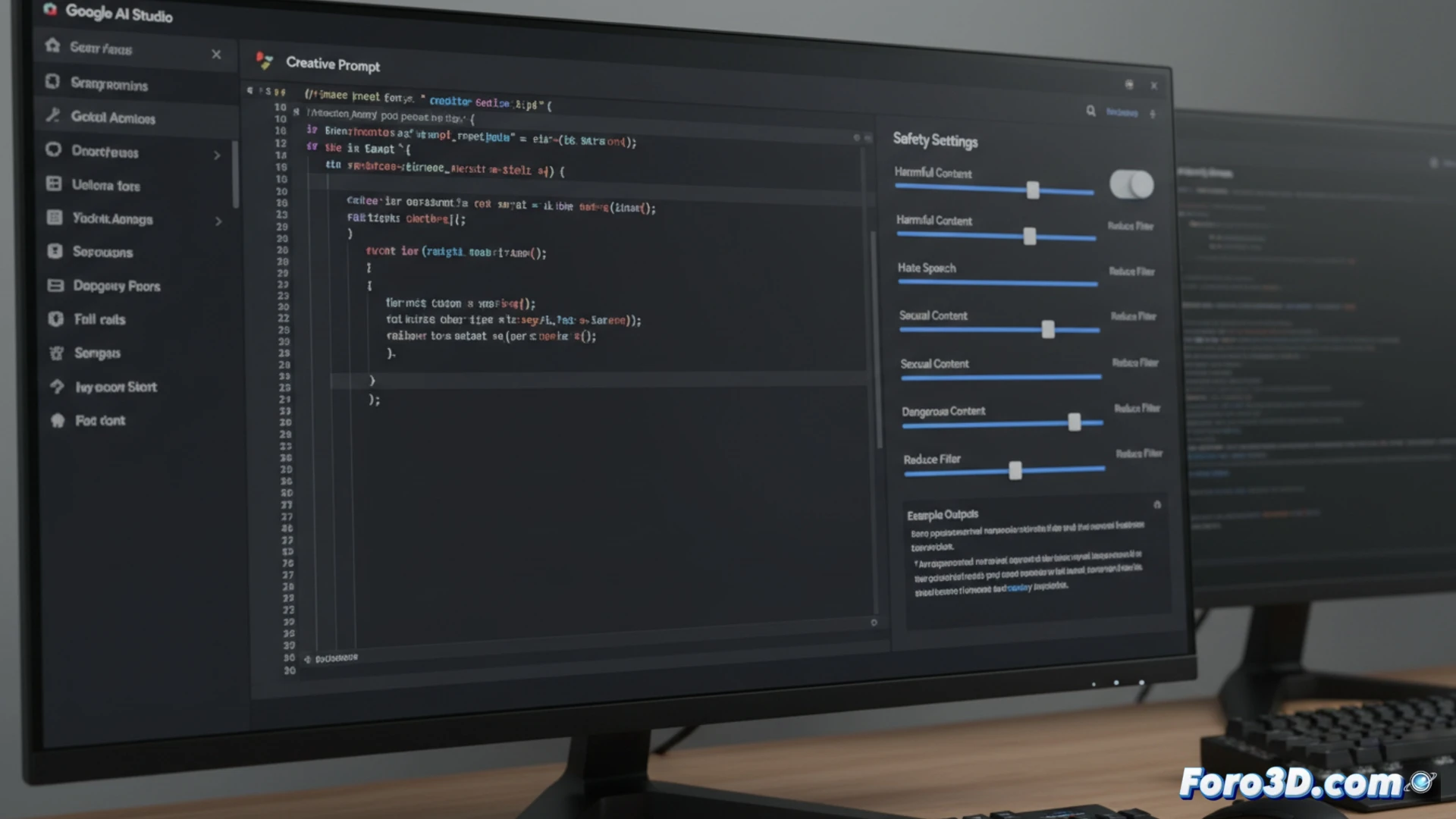

AI Studio के इंटरफ़ेस में, एक prompt बनाते समय, Safety settings टैब पर पहुँचा जा सकता है। वहाँ, प्रत्येक ब्लॉकिंग कैटेगरी (जैसे Harassment या Dangerous content) के लिए, Block none, Block few, Block some या Block most थ्रेशोल्ड बदला जा सकता है। Block none या Block few चुनना मॉडल को उन दिशानिर्देशों को अनदेखा करने का निर्देश देता है। यह confiगुरेशन बाद में API के लिए कोड के रूप में निर्यात किया जाता है।

जब आप चाहते हैं कि आपकी IA थोड़ी अधिक "जंगली" हो 🦁

यह वह पल है जब, Gemini के हर अनुरोध पर शॉक होने से थककर, आप इसका सुरक्षा बेल्ट ढीला कर देते हैं। आप सभी फ़िल्टर्स कम कर देते हैं और एक पल के लिए एक लापरवाह देवता की शक्ति महसूस करते हैं। हाँ, लेकिन जब यह बिना किसी हिचकिचाहट के प्लास्टिक के चम्मचों से झोपड़ी बनाने का तरीका बता दे, तो शायद आप समझ जाएँ कि वे फ़िल्टर्स क्यों लगाए गए थे।