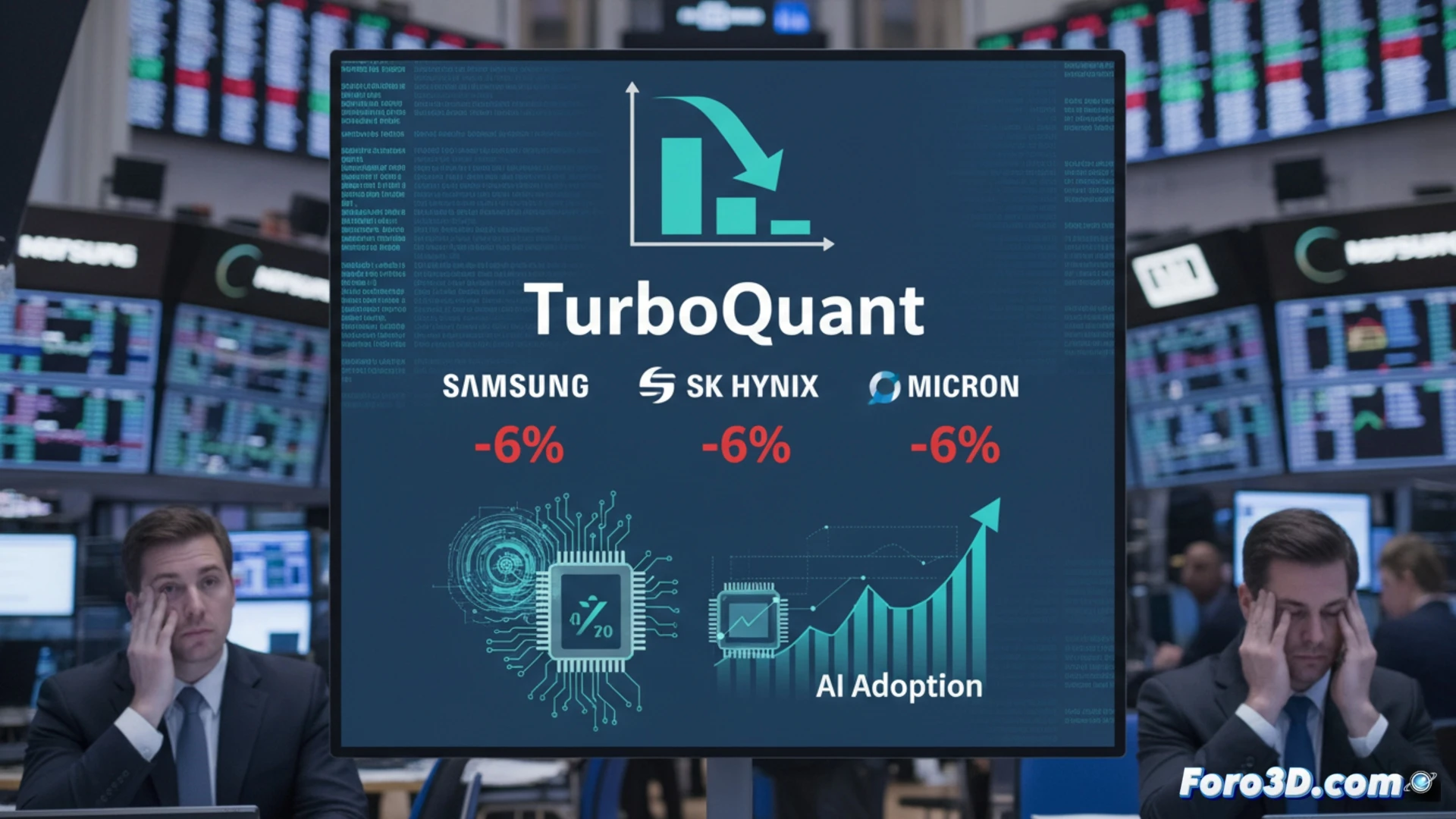

Google a dévoilé TurboQuant, une technique de compression de modèles de langage qui réduit jusqu'à six fois la mémoire nécessaire pour l'inférence d'IA sans perte de précision. L'annonce a provoqué une chute immédiate en bourse, proche de 6 %, chez des géants de la mémoire comme Samsung, SK Hynix et Micron. La crainte du marché est claire : si le logiciel devient radicalement plus efficace, la demande projetée de hardware de mémoire DRAM et HBM, clé pour l'IA, pourrait se contracter significativement.🚀

Implications techniques : moins de HBM par puce, plus de puces par plaquette💡

En visualisant un processeur pour IA comme un GPU, son architecture dépend de piles de mémoire HBM à haut débit, un composant coûteux et complexe à fabriquer. TurboQuant, en compressant les poids du modèle, réduit le besoin de les stocker dans cette HBM pendant l'exécution. Cela pourrait se traduire par des conceptions futures avec moins de piles de mémoire par puce ou avec des capacités moindres, libérant de l'espace sur le silicium et réduisant les coûts de matériaux. À l'échelle de production, une demande moindre par unité pourrait signifier qu'une plaquette de semi-conducteurs permette de produire plus de puces finales, modifiant les calculs de capacité des fonderies et des fabricants de mémoire.

Panique court-termiste versus opportunité structurelle🤔

La réaction boursière reflète une peur de la disruption, mais le panorama à long terme est plus nuancé. Une inférence d'IA plus efficace et économique réduit la barrière à l'entrée, favorisant une adoption massive dans les appareils et les services. Cette prolifération pourrait générer une demande totale de mémoire plus élevée, bien que distribuée sur plus d'applications et éventuellement sur des types de puces différents. L'industrie des semi-conducteurs doit s'adapter : la valeur ne résidera plus seulement dans la vente de gigaoctets, mais dans l'intégration de solutions de mémoire et de traitement optimisées pour des modèles compressés et efficaces.

Comment la compression de modèles comme TurboQuant de Google pourrait-elle stimuler l'adoption de memorias de alta densidad y arquitecturas 3D-IC dans le hardware pour l'IA ?

(PD : modéliser une puce en 3D est facile, le difficile est qu'elle ne ressemble pas à une ville de Lego)