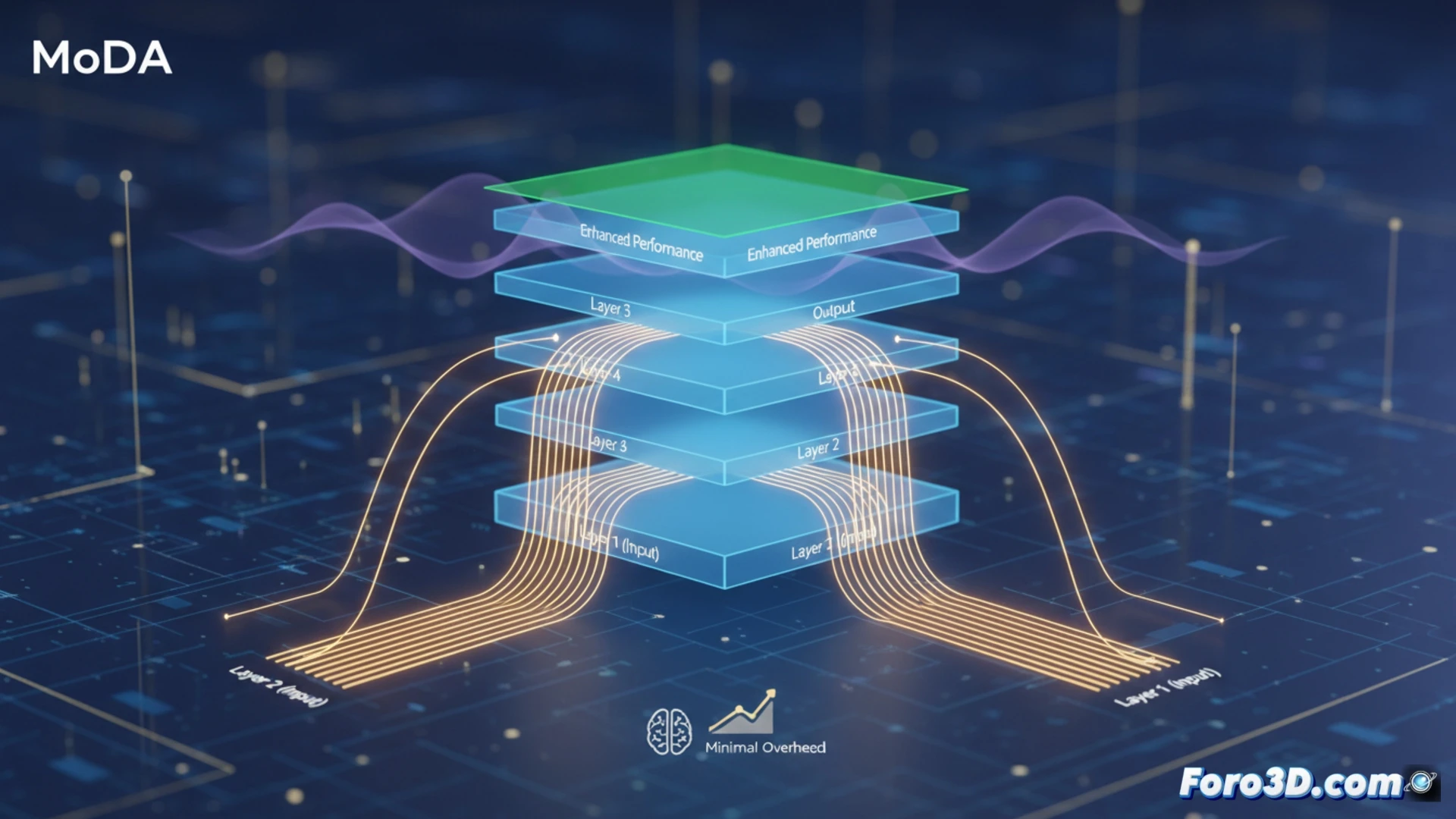

Augmenter la profondeur des modèles de langage grands est clé pour leur capacité, mais pose un problème : la dégradation du signal. À mesure que l'information traverse des dizaines ou des centaines de couches, les traits utiles formés au début se diluent, se perdant dans les plus profondes. Une nouvelle recherche propose Mixture-of-Depths Attention (MoDA), un mécanisme innovant qui permet aux têtes d'attention d'accéder non seulement à la couche actuelle, mais aussi à des informations clés de couches antérieures, préservant ainsi les signaux importants et améliorant les performances du modèle avec une surcharge computationnelle minimale.

Comment fonctionne MoDA et sa mise en œuvre efficace 🤖

Techniquement, MoDA modifie l'attention standard. Dans chaque couche, chaque tête d'attention peut prêter attention à deux ensembles de paires clé-valeur : celui de la séquence dans la couche actuelle et un ensemble en profondeur extrait de couches précédentes. Cela permet de récupérer et de renforcer des caractéristiques informatives qui autrement se seraient diluées. Pour rendre cela pratique, les chercheurs ont développé un algorithme efficace en matériel qui résout le problème des accès non contigus à la mémoire, atteignant 97,3 % de l'efficacité de FlashAttention-2 sur des séquences longues de 64K tokens. Cela rend MoDA viable pour l'entraînement à grande échelle.

Implications pour l'avenir des modèles profonds 🚀

Les résultats sont prometteurs : sur des modèles de 1,5B de paramètres, MoDA améliore la perplexité et les performances sur des tâches ultérieures avec seulement 3,7 % de surcharge en FLOPs. De plus, cela fonctionne mieux avec une normalisation postérieure à la couche, une configuration courante. Cela suggère que MoDA n'est pas seulement un correctif, mais un primitif architectural fondamental pour scaler la profondeur de manière plus efficace. Son efficacité ouvre la porte à des modèles plus profonds et capables sans coûts computationnels prohibitifs, accélérant le développement de LLMs plus puissants et accessibles.

Comment la technique MoDA peut-elle résoudre le problème de la dégradation du signal dans les LLMs profonds et quelles implications cela a-t-il pour le développement d'intelligences artificielles plus capables et accessibles ?

(PD : les surnoms technologiques sont comme les enfants : tu les nommes, mais la communauté décide comment les appeler)