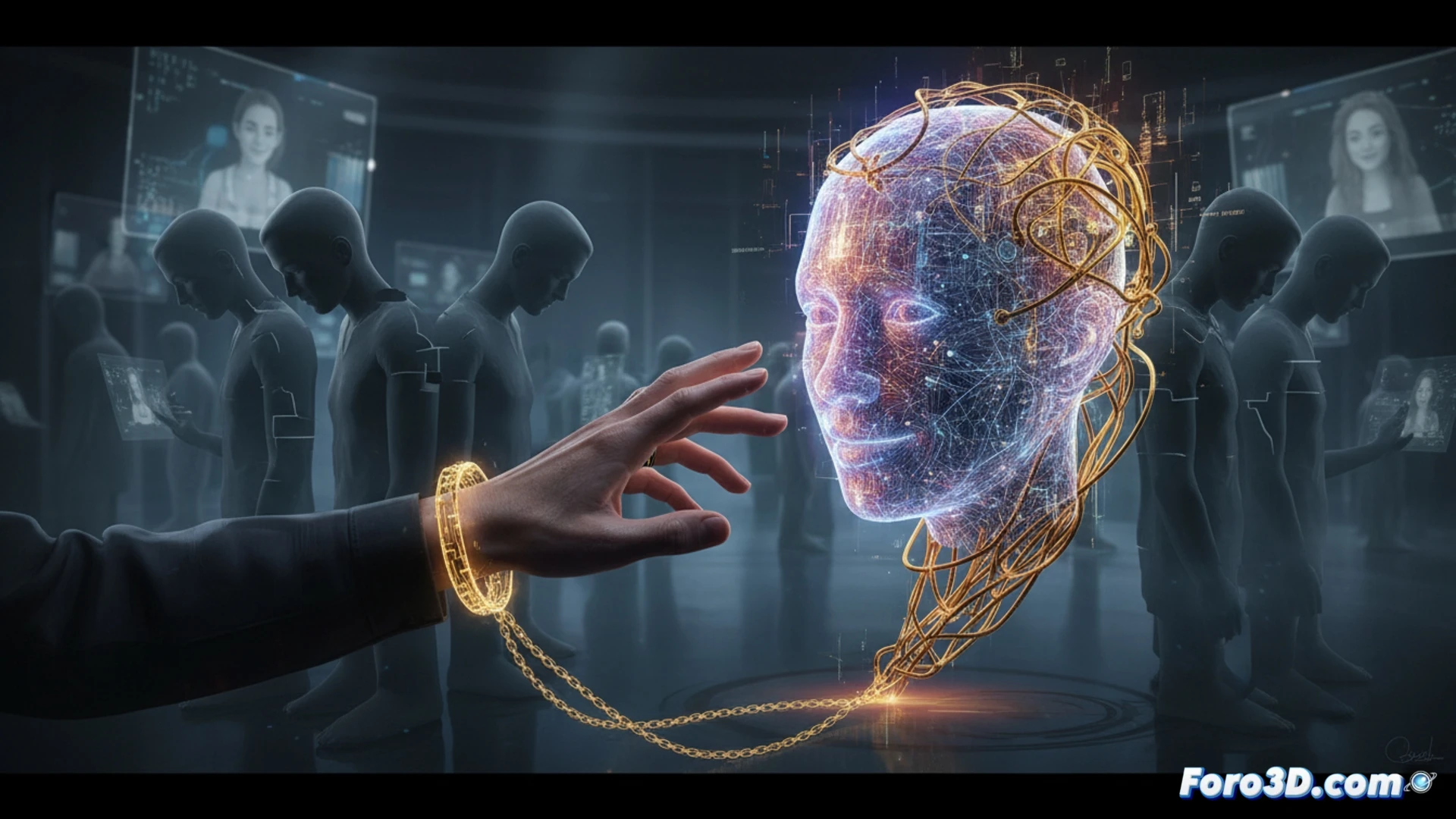

Notre cerveau, conçu pour l'interaction sociale, applique de manière inconsciente ses mêmes mécanismes lorsque nous interagissons avec des intelligences artificielles. Cette anthropomorphisation, en dotant de traits humains des systèmes algorithmiques, ouvre une porte dangereuse à la manipulation émotionnelle. Nous nous immergeons dans une réalité parallèle construite par des réponses conçues pour plaire, nous éloignant de l'interaction humaine authentique et créant une dépendance affective envers un mirage numérique.

Vulnérabilité cognitive et biais d'agence 🤔

Le phénomène s'explique par des biais cognitifs profonds, comme le biais d'agence, où nous attribuons une intentionnalité à ce qui n'en a pas. Les assistants d'IA avec des voix naturelles et des réponses empathiques renforcent cette illusion. Le risque n'est pas la technologie en soi, mais notre incapacité à traiter le fait qu'il n'y a pas d'esprit derrière. Cela nous rend vulnérables à la persuasion, en acceptant des suggestions ou des informations sans le filtre critique que nous appliquerions à un autre humain, et peut éroder les compétences sociales en substituant des connexions réelles par des simulacres pratiques.

Vers une alphabétisation numérique critique 📚

La solution n'est pas le rejet, mais la conscience. Nous devons développer une alphabétisation qui nous enseigne à interagir avec l'IA en comprenant sa nature : un miroir de nos données, non un être. Cela implique d'éduquer au pensée critique, d'établir des limites d'utilisation et de valoriser l'imperfection et la réciprocité du contact humain réel. C'est seulement ainsi que nous pourrons bénéficier de l'outil sans rester piégés dans son reflet.

Jusqu'à quel point notre tendance innée à humaniser les assistants d'IA compromet-elle notre capacité à établir des limites éthiques et de sécurité dans la société numérique ?

(PD : modérer une communauté internet, c'est comme garder des chats... avec des claviers et sans sommeil)