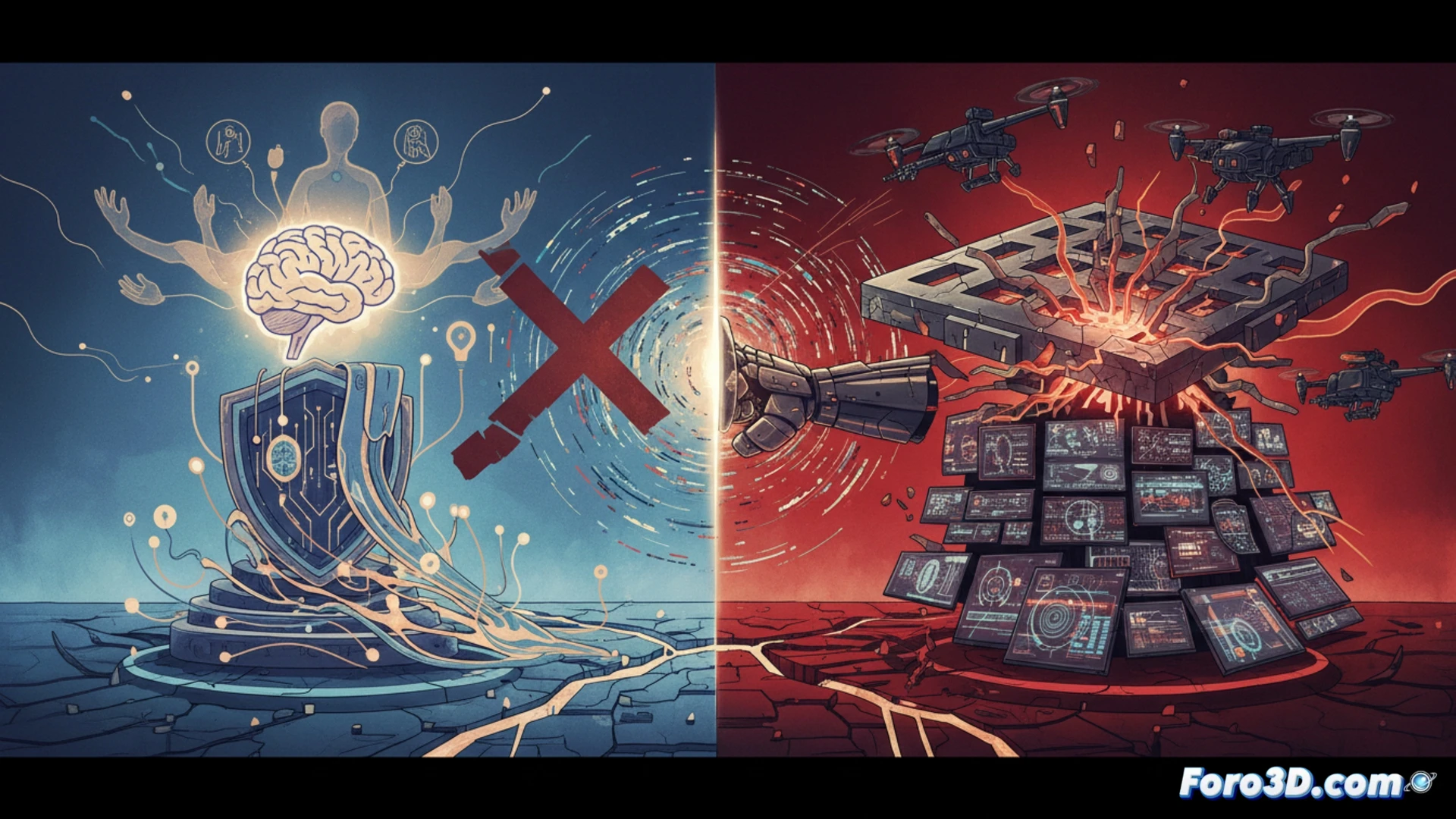

Dans un mouvement sans précédent, le Département de la Défense des États-Unis a désigné l'entreprise d'intelligence artificielle Anthropic comme un risque pour la chaîne d'approvisionnement de la sécurité nationale. Cette mesure, généralement réservée aux adversaires étrangers, interdit à l'entreprise et à ses partenaires de travailler avec le gouvernement. Le conflit naît d'un choc éthique irréconciliable : Anthropic a refusé de permettre l'utilisation de son IA pour la surveillance de masse ou les armes autonomes, défiant les exigences du Pentagone et mettant en risque sa propre viabilité économique.

La désignation comme risque de chaîne d'approvisionnement : implications légales et opérationnelles ⚖️

La désignation officielle comme risque pour la chaîne d'approvisionnement de la sécurité nationale n'est pas une sanction mineure. C'est un instrument légal puissant qui exclut effectivement Anthropic de tout contrat avec le Département de la Défense et d'autres agences clés. Cela va au-delà d'un simple rejet d'une soumission ; c'est une interdiction large qui s'étend à ses partenaires commerciaux, isolant l'entreprise d'un marché gigantesque. La décision d'Anthropic de contester la mesure devant les tribunaux créera un précédent crucial. Le procès définira les limites du pouvoir gouvernemental pour punir les entreprises qui, pour des motifs éthiques auto-déclarés, refusent de collaborer à des projets de sécurité nationale, et mettra à l'épreuve l'autonomie corporative dans le développement de technologies à double usage.

Un précédent dangereux pour l'industrie de l'IA ⚠️

Ce cas transcende Anthropic et établit un précédent alarmant pour toute l'industrie technologique. Il indique que prioriser des principes éthiques rigides, surtout dans des domaines sensibles comme l'autonomie létale ou la surveillance, peut entraîner un coût économique existentiel. La mesure du Pentagone pourrait forcer d'autres startups à choisir entre leur boussole morale et leur survie commerciale, freinant l'innovation responsable et poussant le développement de l'IA critique vers des acteurs moins scrupuleux ou vers des puissances rivales. La bataille juridique résultante définira l'avenir de la gouvernance éthique de l'IA et l'équilibre fragile entre la sécurité de l'État et la liberté de conscience corporative.

Jusqu'à quel point doit-on prioriser la sécurité nationale sur l'éthique dans le développement de l'intelligence artificielle avancée ?

(PD : essayer de bannir un pseudonyme sur internet, c'est comme essayer de cacher le soleil avec un doigt... mais en digital)