Google AI Studio est une plateforme pour tester et ajuster les modèles Gemini. L'une de ses fonctions permet de modifier la configuration de sécurité de l'assistant. Cela permet un comportement moins restrictif dans les réponses créatives ou expérimentales, utile pour les développeurs qui ont besoin de tester les limites du modèle dans des environnements contrôlés.

Ajustement des paramètres de sécurité dans l'API 🛡️

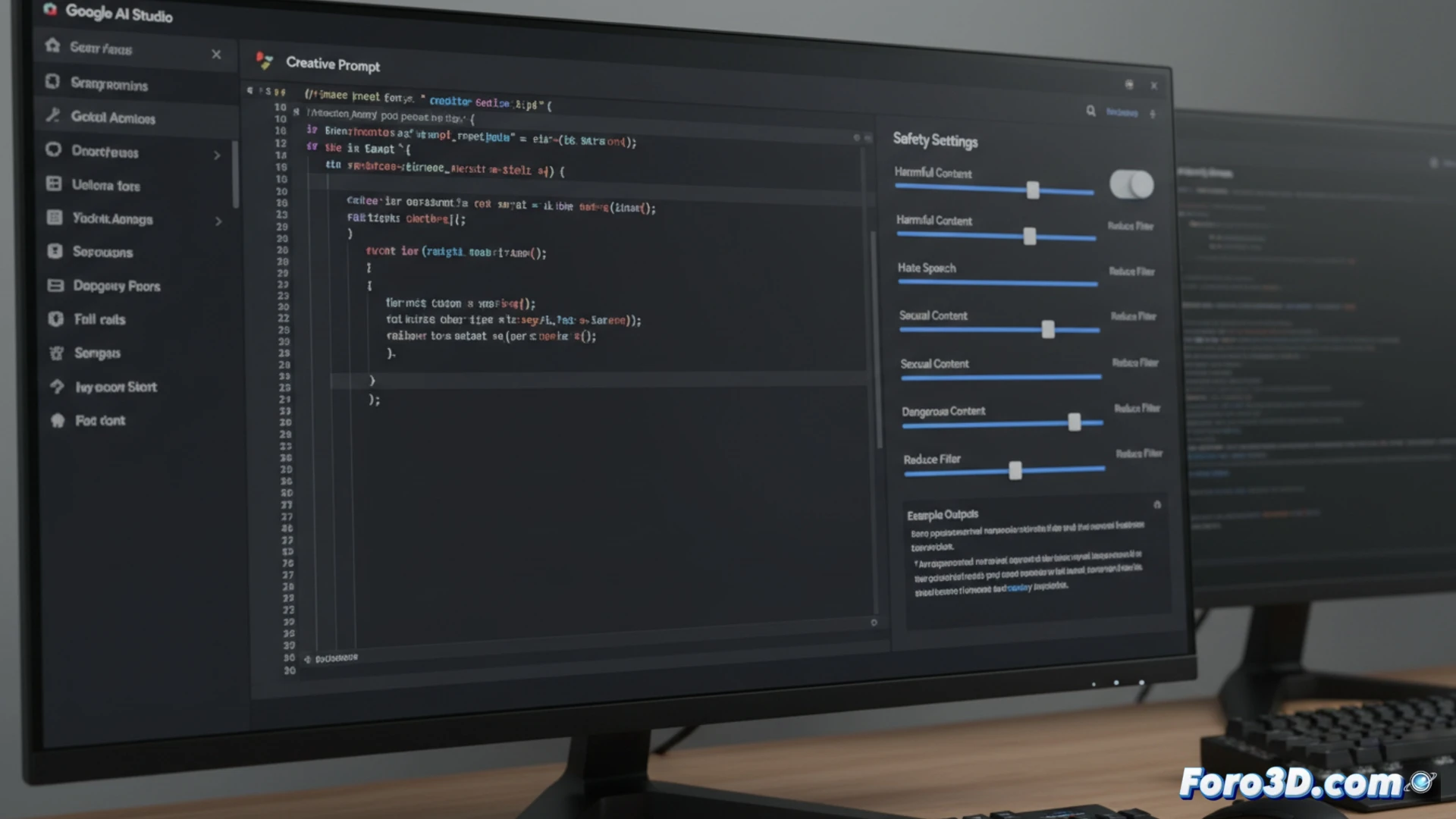

Dans l'interface de AI Studio, lors de la création d'un prompt, on accède à l'onglet Safety settings. Là, pour chaque catégorie de blocage (comme Harassment ou Dangerous content), on peut changer le seuil en Block none, Block few, Block some ou Block most. Sélectionner Block none ou Block few indique au modèle d'ignorer ces directives. Cette configuration est ensuite exportée sous forme de code pour l'API.

Quand vous voulez que votre IA soit un peu plus « sauvage » 🦁

C'est le moment où, fatigué que Gemini s'offusque pour chaque requête, vous décidez de lui détacher la ceinture de sécurité. Vous baissez tous les filtres et, l'espace d'un instant, vous ressentez le pouvoir d'un dieu irresponsable. Cela dit, après qu'il vous ait expliqué sans détour comment construire une cabane avec des cuillères en plastique, vous comprendrez peut-être pourquoi ces filtres étaient là.