Quand les modèles multimodaux perdent la vision mais conservent le langage

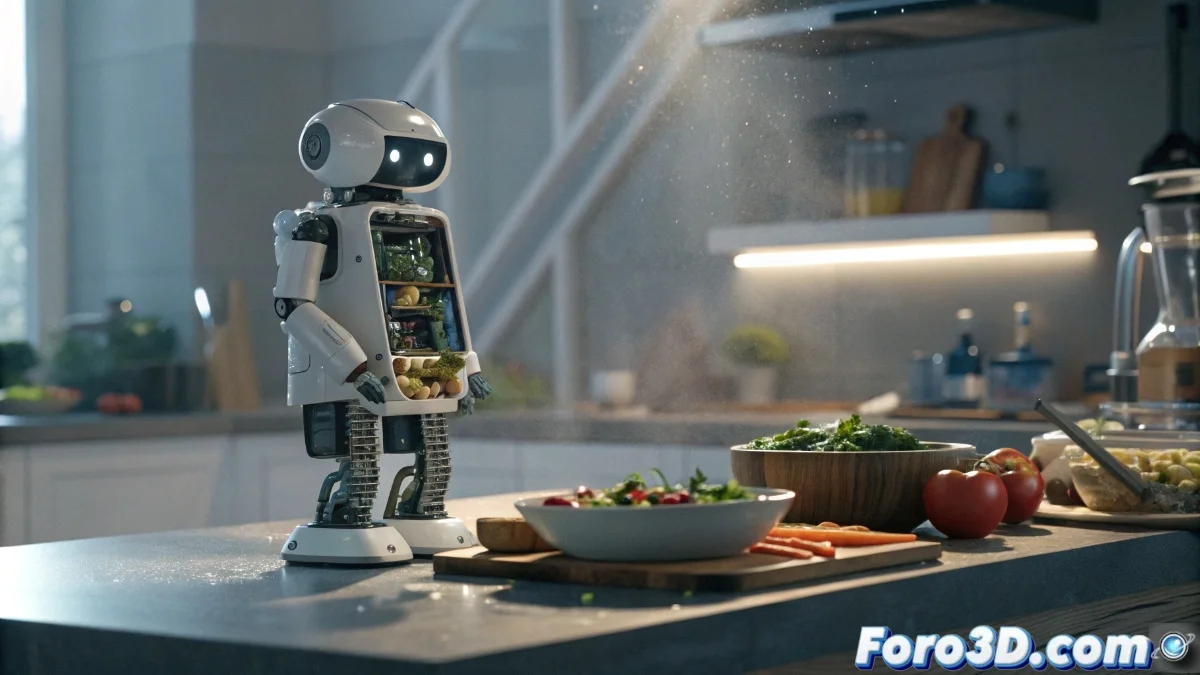

L'optimisation des modèles multimodaux pour gagner en vitesse et en efficacité révèle une curieuse asymétrie : leurs capacités de traitement visuel se dégradent beaucoup plus rapidement que leurs compétences en raisonnement linguistique. Cette disparité représente un obstacle critique pour les systèmes qui dépendent d'une interprétation visuelle précise, des assistants intelligents aux automatisations robotiques domestiques. 👁️🗨️

Le problème fondamental de la compression multimodale

Quand les développeurs réduisent la taille des modèles multimodaux pour améliorer leurs performances, la compréhension visuelle subit un impact disproportionné par rapport au traitement du langage. Cette dégradation peut conduire à des interprétations erronées de scènes et d'objets, même lorsque le composant linguistique conserve une certaine capacité d'analyse. La conséquence pratique est que des systèmes apparemment fonctionnels peuvent commettre des erreurs graves dans des tâches nécessitant une perception visuelle précise.

Conséquences de l'asymétrie visuelle-linguistique :- Assistants virtuels qui mal interprètent les photographies et les scènes visuelles

- Robots domestiques ayant des difficultés à reconnaître les objets et les contextes

- Systèmes d'automatisation qui échouent dans des environnements visuellement complexes

"La perception visuelle dégradée dans les modèles plus petits peut mener à des interprétations erronées même lorsque le composant linguistique maintient une capacité de raisonnement"

Extract+Think : La solution en deux étapes

La recherche présente Extract+Think, une méthodologie qui opère par deux phases bien définies. D'abord, elle entraîne le modèle à extraire de manière consistente les détails visuels pertinents selon chaque instruction spécifique. Par la suite, le système applique un raisonnement étape par étape sur ces éléments visuels identifiés pour générer des réponses précises. Cette approche structurée garantit que même les modèles compacts maintiennent un haut niveau de compréhension visuelle en se focalisant sur les aspects critiques avant l'analyse.

Avantages de l'approche Extract+Think :- Extraction sélective des détails visuels pertinents

- Raisonnement structuré sur les éléments identifiés

- Préservation des capacités visuelles dans les modèles optimisés

Applications pratiques dans des environnements à ressources limitées

Les bénéfices de cette méthodologie sont particulièrement précieux dans des scénarios du monde réel où le matériel a des capacités restreintes. Un assistant virtuel qui analyse des images peut maintenir une compréhension correcte des scènes s'il identifie d'abord les objets et les détails importants avant de raisonner sur eux. De même, un robot domestique avec des ressources computationnelles limitées peut reconnaître des ingrédients dans une cuisine et suivre des recettes avec précision, en se concentrant sur les éléments visuels clés par ce processus d'extraction et de raisonnement séquentiel.

Cas d'usage avec matériel limité :- Assistants virtuels mobiles qui analysent des photographies de l'environnement

- Robots domestiques économiques qui interagissent avec des objets quotidiens

- Systèmes embarqués qui traitent des informations visuelles en temps réel

La paradoque de l'apprentissage humain vs artificiel

Il est ironique que les intelligences artificielles doivent apprendre à séparer l'essentiel de l'accessoire avant de formuler des conclusions, une compétence que les humains développent naturellement dès la petite enfance. Alors que les enfants acquièrent cette capacité à la maternelle, les machines nécessitent des années d'entraînement spécialisé pour atteindre un niveau similaire de discernement visuel sélectif. Cette paradoque souligne la complexité fondamentale de reproduire la perception humaine dans des systèmes artificiels. 🤖