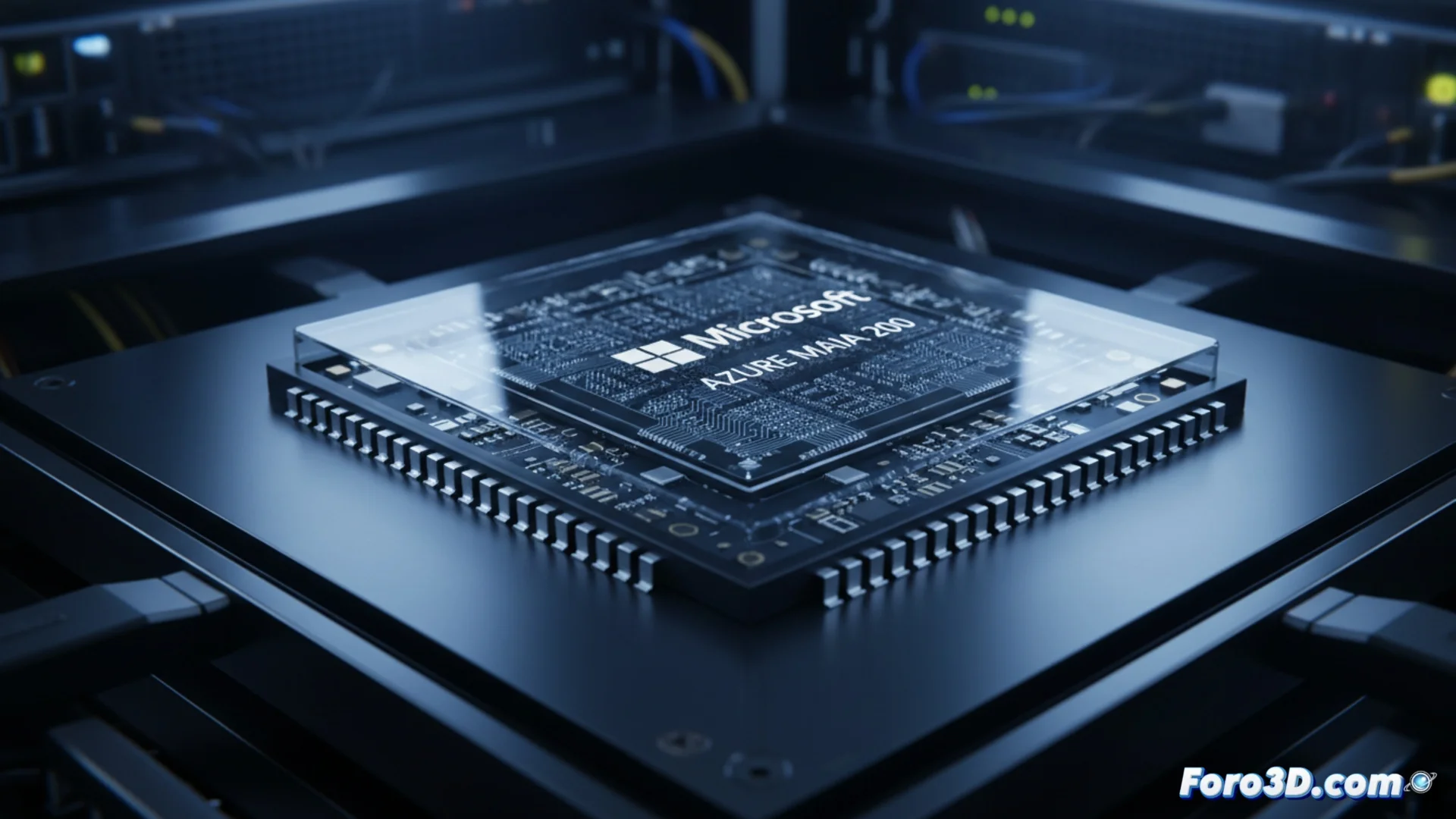

Microsoft lance l'accélérateur d'IA Azure Maia 200

L'entreprise technologique Microsoft a dévoilé son nouveau accélérateur d'intelligence artificielle, l'Azure Maia 200. Ce composant représente l'évolution dans la famille de processeurs Maia, créés spécifiquement pour fonctionner dans des serveurs. Sa tâche principale est de faire fonctionner des modèles d'IA déjà entraînés, afin qu'ils génèrent des réponses et des prédictions. Microsoft conçoit ce matériel pour gérer ces opérations avec une grande vitesse et un niveau d'efficacité qui, selon l'entreprise, surpasse ce que proposent actuellement des rivaux comme Amazon et Google dans ce domaine. 🚀

Focus sur l'efficacité et la vitesse pour l'inférence

L'Azure Maia 200 est fabriqué dans le but d'optimiser l'exécution de modèles d'IA à grande échelle au sein de la plateforme cloud Azure. En produisant son propre chip, Microsoft cherche à avoir un contrôle plus direct sur toute la chaîne du matériel et logiciel, ce qui peut permettre d'ajuster avec plus de précision la manière dont le système gère les données. Cette méthode vise à réduire les temps d'attente et à améliorer l'utilisation de l'énergie lors de l'exécution de modèles complexes, des grands modèles de langage aux systèmes d'analyse d'images. L'entreprise ne révèle pas tous les détails de son architecture, mais indique que la conception priorise la capacité de mémoire et la manière dont les chips sont interconnectés pour gérer les énormes ensembles de paramètres des modèles actuels.

Caractéristiques clés de l'Azure Maia 200 :- Conçu pour exécuter des tâches d'inférence d'IA avec une haute vitesse.

- Visant à améliorer l'efficacité énergétique dans les centres de données.

- Architecture qui priorise la bande passante mémoire et l'interconnexion.

Il semble que la nouvelle compétition mondiale ne se livre pas avec des missiles, mais avec des transistors et qui peut traiter une requête sur des chatons le plus rapidement.

Le panorama concurrentiel des puces pour l'IA

Le lancement du Maia 200 illustre une tendance large dans le secteur technologique, où les grands fournisseurs de services cloud développent leurs propres chips spécialisés. Amazon dispose de ses processeurs Inferentia et Trainium, tandis que Google utilise ses Tensor Processing Units (TPU). En présentant le Maia 200, Microsoft consolide son plan d'offrir une infrastructure d'IA distincte, en concurrençant non seulement sur les services logiciels mais aussi sur la performance du matériel sous-jacent. L'entreprise prévoit d'implémenter ces accélérateurs dans ses centres de données à travers le monde pour booster des services comme Azure OpenAI Service et d'autres opérations d'IA générative.

Principaux acteurs dans les chips personnalisés pour le cloud :- Microsoft : Azure Maia 200 pour l'inférence.

- Amazon Web Services : Chips Inferentia et Trainium.

- Google Cloud : Tensor Processing Units (TPU).

Implications pour l'avenir de l'informatique dans le cloud

Ce mouvement souligne comment la course à la suprématie en IA dépend maintenant de manière critique des puces personnalisées. En contrôlant à la fois le logiciel et le matériel, Microsoft vise à offrir une pile plus intégrée et efficace à ses clients. L'objectif final est de traiter des modèles d'intelligence artificielle plus grands et complexes de manière plus rapide et à moindre coût opérationnel, définissant les nouveaux standards de performance dans le cloud. 🔌