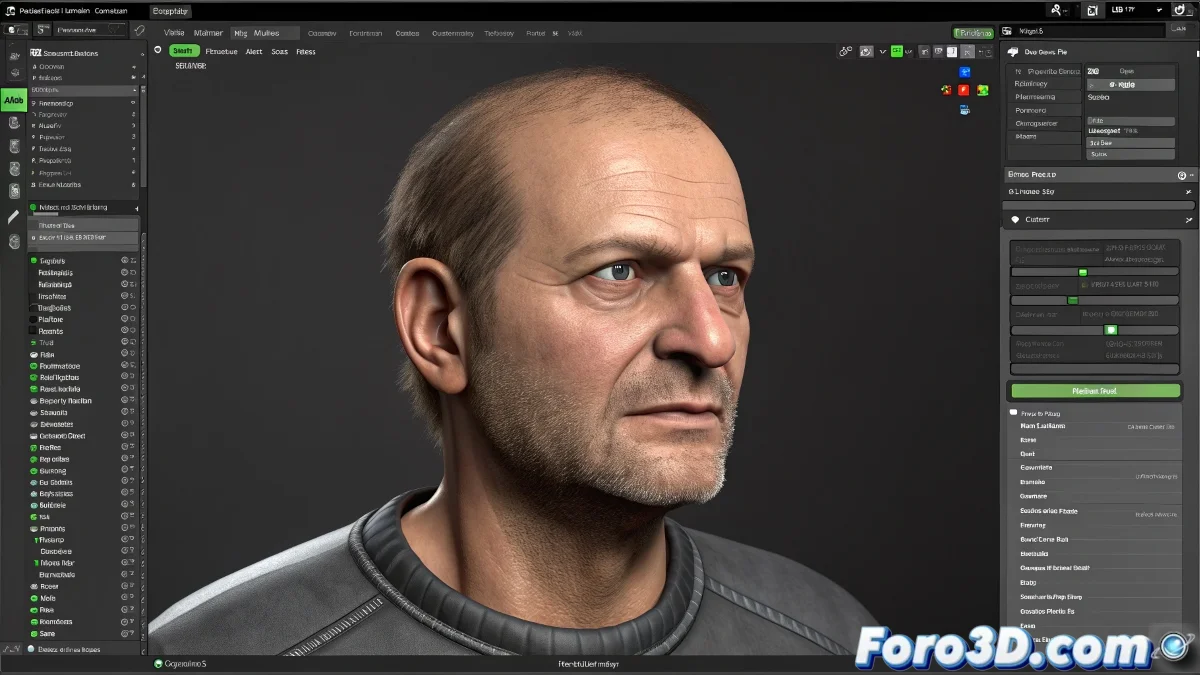

Connecter les mondes : la capture faciale rencontre iClone

Intégrer la capture faciale de FaceShift dans iClone est comme organiser un rendez-vous à l'aveugle entre deux logiciels qui ne parlent pas la même langue de manière native 🎭. FaceShift, spécialisé dans l'enregistrement de chaque nuance d'une expression faciale, et iClone, puissant en animation de personnages en temps réel, peuvent travailler ensemble, mais nécessitent un intermédiaire — un format de fichier universel — pour communiquer. Le processus n'est pas un simple clic, mais un flux de travail qui, avec de la patience, produit des résultats incroyablement expressifs.

Le protocole d'exportation : choisir le bon format

La première étape après une session de capture réussie dans FaceShift est d'exporter l'animation. Ici, le choix du format est critique. FBX est généralement l'option la plus robuste, car il préserve bien les informations de transformation des os faciaux. BVH (Biovision Hierarchy) est une alternative plus ancienne mais encore largement compatible, idéale pour les données de rotation pure. Une fois exporté, ce fichier devient votre paquet de données faciales, prêt à voyager vers iClone. Il est crucial de vérifier que l'exportation n'inclut que les données faciales et non des transformations corporelles indésirables.

Exporter de FaceShift sans vérifier l'échelle, c'est comme envoyer une carte sans échelle, iClone ne saura pas si c'est un geste ou une grimace géante.

L'importation dans iClone et le retargeting initial

Dans iClone, le processus d'importation du fichier FBX ou BVH est simple. Cependant, l'étape cruciale est le retargeting : assigner les os ou contrôleurs de l'animation importée au système facial de votre personnage iClone. iClone a son propre ensemble d'os faciaux (morphs ou bones). Vous devrez peut-être utiliser les outils de retargeting d'iClone pour mapper, par exemple, le mouvement "jawOpen" de FaceShift au contrôleur "Aah" d'iClone. Ce mappage n'est pas toujours automatique et peut nécessiter des ajustements manuels pour que la synchronisation labiale et les expressions paraissent naturelles.

MotionBuilder comme station d'ajustement avancée

Pour les projets qui exigent un contrôle milimétrique, utiliser MotionBuilder comme étape intermédiaire est la voie à suivre. Importez l'animation de FaceShift dans MotionBuilder. Ici, vous pouvez visualiser les données avec une plus grande précision, nettoyer le bruit dans les courbes d'animation, ajuster le timing ou même renforcer certaines expressions. Ensuite, exportez depuis MotionBuilder vers un FBX "nettoyé" et optimisé spécifiquement pour le système de personnages d'iClone. Cette étape supplémentaire ajoute du temps, mais offre une fidélité beaucoup plus grande, surtout pour les dialogues complexes ou les performances subtiles.

Flux de travail optimal pour de meilleurs résultats

Suivez ces étapes pour maximiser vos chances de succès :

- Capture propre : assurez une bonne illumination et calibration dans FaceShift pour minimiser le bruit dès le départ.

- Exportation sélective : lors de l'exportation, choisissez uniquement les os faciaux pertinents pour réduire la complexité du fichier.

- Préparation du personnage : dans iClone, préparez votre personnage avec son rig facial bien configuré avant d'importer.

- Retargeting patient : consacrez du temps à mapper correctement chaque contrôleur importé avec son équivalent dans iClone.

- Essais et erreurs : importez d'abord une séquence courte pour ajuster le processus avant de vous engager sur une prise longue.

Bien que FaceShift ne soit plus officiellement supporté, maîtriser ce flux de travail vous permet de rescatiter sa technologie pour donner vie à des personnages dans iClone. Et quand ce sourire numérique se synchronisera parfaitement, l'effort en aura valu la peine. Et si la lèvre se tord un peu, vous pourrez toujours dire que c'est un tic nerveux du personnage 😉.