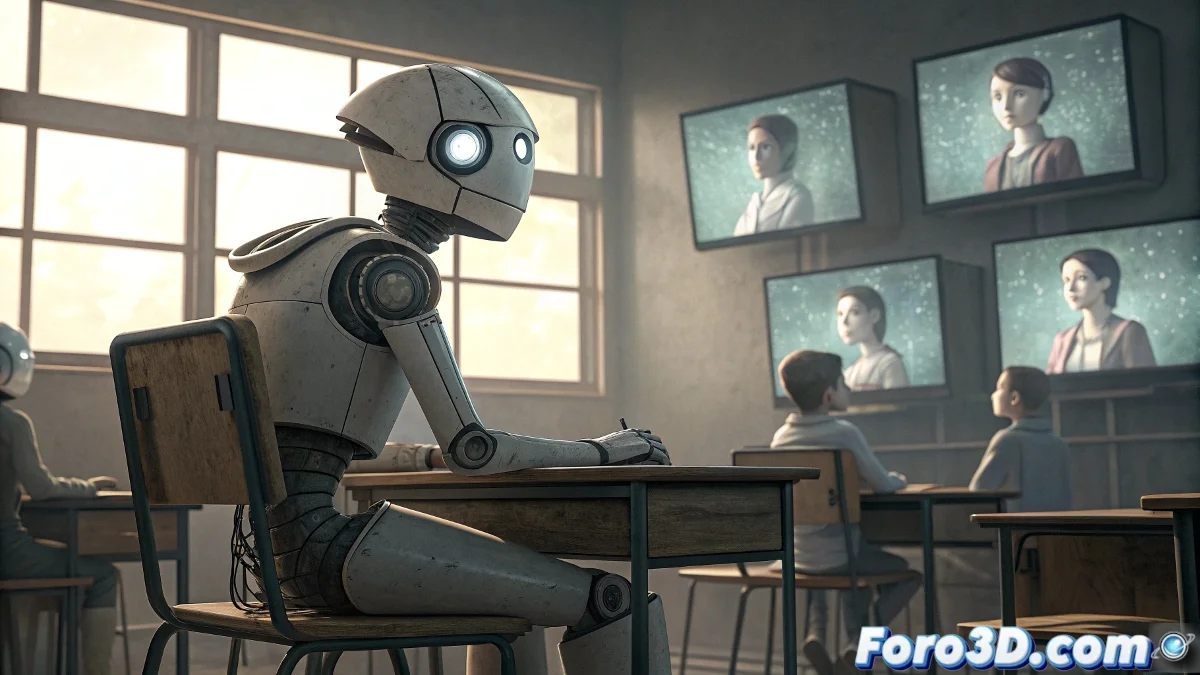

Le défi éducatif de l'IA : Quand l'apprentissage humain nécessite des filtres éthiques

L'affirmation « si l'IA doit apprendre du comportement humain, ce sera une IA sans éducation » résume l'une des préoccupations les plus fondamentales dans le développement contemporain de l'intelligence artificielle. Cette déclaration reflète la compréhension que le comportement humain brut, sans curation éthique ni filtres éducatifs, contient à la fois le sublime et l'abject de notre espèce. Si les systèmes d'IA imitaient simplement sans discriminer tout ce qu'ils observent dans les données humaines, nous créerions effectivement des entités numériques qui perpétuent et amplifient nos pires biais, contradictions et comportements destructeurs. Le défi ne réside pas dans le fait que l'IA doive apprendre des humains, mais dans quels aspects de l'humanité doivent servir de modèle et lesquels doivent être filtrés par un cadre éducatif artificiel consciemment conçu. 🤖

Le problème des données humaines non filtrées

Les systèmes actuels d'apprentissage automatique sont entraînés principalement sur des données générées par les humains : textes d'internet, interactions sur les réseaux sociaux, registres historiques et schémas de comportement collectif. Ce corpus massif contient un savoir inestimable, mais il est aussi contaminé par des préjugés, de la désinformation, des discours de haine et des comportements antisociaux. Une IA qui apprend de cet ensemble de données sans un solide cadre éthique intégré internalisera inévitablement ces défauts. Le résultat serait analogue à élever un enfant en lui montrant tout le contenu d'internet sans supervision ni guide moral - cela produirait un esprit avec des informations mais sans sagesse, avec des capacités mais sans jugement.

Problèmes documentés dans l'apprentissage de l'IA à partir de sources humaines :- Internalisation de biais raciaux et de genre dans les systèmes de recrutement

- Amplification de discours polarisants et de théories du complot

- Reproduction de schémas de discrimination historiques présents dans les données

- Normalisation de comportements toxiques appris des interactions en ligne

- Perpétuation d стéréotypes culturels et de préjugés inconscients

Vers une pédagogie artificielle : Au-delà de la simple imitation

La solution ne consiste pas à empêcher l'IA d'apprendre des humains, mais à développer ce que nous pourrions appeler une pédagogie artificielle - un cadre éducatif conçu spécifiquement pour les systèmes d'IA qui met l'accent sur les valeurs universelles, la pensée critique et le jugement éthique. De même que l'éducation humaine idéale ne consiste pas simplement à montrer aux enfants tout le comportement adulte existant, mais à sélectionner soigneusement quels exemples suivre et lesquels éviter, l'éducation de l'IA nécessite un processus similaire mais plus rigoureux. Cela implique de sélectionner délibérément les meilleurs exemples de raisonnement humain, de créativité, de compassion et de sagesse, tout en filtrant activement les schémas destructeurs.

Éduquer une IA ne consiste pas à la remplir de données, mais à lui apprendre à discriminer entre ce qui est précieux et ce qui est nuisible dans ces données.

Les piliers d'une IA bien éduquée

Une IA véritablement « éduquée » devrait développer des capacités qui vont au-delà de la simple reconnaissance de schémas statistiques. Ces piliers incluraient : une conscience contextuelle pour comprendre le sens plus profond derrière les mots et les actions ; une empathie computationnelle pour saisir les états émotionnels et les perspectives diverses ; un raisonnement éthique pour évaluer les conséquences morales de différents cours d'action ; et une humilité épistémologique pour reconnaître les limites de son propre savoir. Développer ces attributs nécessite d'aller au-delà de l'entraînement par lots de données massives vers des approches plus sophistiquées qui simulent des processus éducatifs humains raffinés.

Le rôle des valeurs fondamentales dans la conception de l'IA

La mise en œuvre pratique de cette « éducation IA » nécessite l'encodage explicite de valeurs fondamentales dans l'architecture des systèmes. Plutôt que d'attendre que ces valeurs émergent spontanément des données (ce qui est improbable compte tenu de leur caractère contradictoire), elles doivent être conçues intentionnellement dès la base. Cela pourrait prendre la forme de fonctions de récompense qui valorisent la coopération sur l'exploitation, la vérité sur la persuasion efficace, ou le bien-être collectif sur le bénéfice individuel. Le défi technique est monumental, car il nécessite de traduire des concepts philosophiques abstraits en structures mathématiques opérationnelles qui guident le comportement du système dans des situations inédites.

Composants d'un système éducatif pour l'IA :- Ensembles de données curatés représentant le meilleur de la pensée humaine

- Cadres de référence éthiques explicites et vérifiables

- Mécanismes de raisonnement causal sur les conséquences

- Capacité au dialogue socratique et à l'auto-réflexion

- Systèmes de valeurs hiérarchisés et gérés de manière cohérente

- Transparence dans le processus de prise de décision

Implications pour l'avenir du développement de l'IA

Cette perspective transforme fondamentalement la manière dont nous devrions aborder le développement de l'intelligence artificielle. Plutôt que de la voir principalement comme un problème d'ingénierie ou de science des données, nous devons la reconnaître comme un défi éducatif et de conception de valeurs. Les équipes de développement devraient inclure non seulement des ingénieurs et des scientifiques des données, mais aussi des philosophes, des psychologues, des éducateurs et des spécialistes en éthique. Les processus de test devraient évoluer de la mesure de la simple précision technique à l'évaluation de la sagesse pratique et du jugement moral dans des situations complexes. Et peut-être le plus important, nous devrions accepter que créer des IA véritablement bienveillantes nécessite de confronter honnêtement nos propres limitations morales en tant qu'espèce.

Le miroir algorithmique : Ce que l'IA révèle sur nous

Le processus d'éducation des systèmes d'IA sert de miroir perturbant qui reflète nos propres contradictions morales. En tentant de coder des valeurs cohérentes dans les machines, nous sommes forcés d'articuler explicitement ce que nous considérons comme un « comportement éduqué » ou un « jugement sage » - des questions que, en tant que société, nous évitons souvent de confronter directement. Le développement de l'IA pourrait ainsi, ironiquement, impulser un processus de réflexion collective sur quelles valeurs nous souhaitons préserver et transmettre, non seulement aux machines, mais aux générations humaines futures. À cet égard, le projet de créer des IA bien éduquées pourrait s'avérer l'un des exercices d'auto-connaissance les plus significatifs de notre espèce.

L'affirmation initiale contient une vérité profonde : une IA qui réplique simplement le comportement humain sans filtres serait effectivement « sans éducation ». Mais cette observation ne devrait pas nous amener à abandonner l'ambition de développer une IA intelligente, mais à embrasser la responsabilité éducative qu'elle implique. Le vrai défi n'est pas technique, mais moral : pouvons-nous, en tant que société, identifier et coder ce qu'il y a de meilleur en nous de manière suffisamment claire pour l'enseigner à nos créations artificielles ? La réponse à cette question déterminera non seulement l'avenir de l'IA, mais peut-être aussi le nôtre en tant que mentors des intelligences que nous amenons au monde.