Adaptation de modèles lidar par distillation de connaissance visuelle

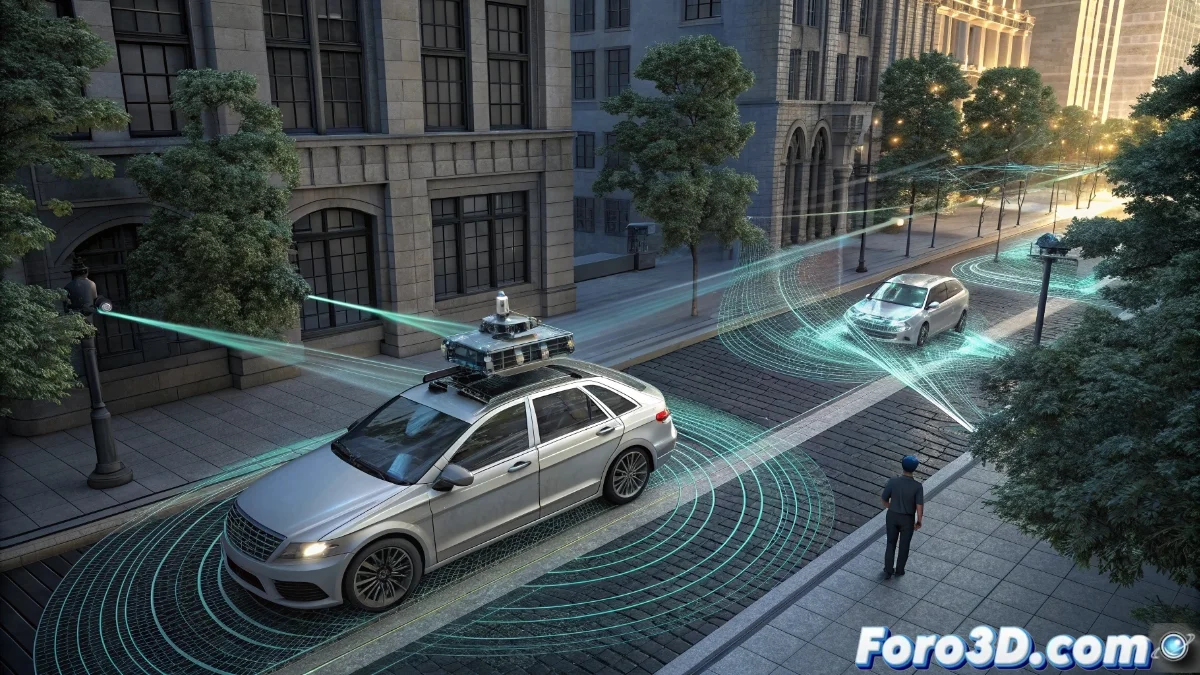

L'interopérabilité entre capteurs lidar hétérogènes représente l'un des obstacles les plus complexes dans le développement de systèmes autonomes robustes. Lorsque un modèle entraîné avec des données d'un capteur spécifique fait face à des variations en résolution, motifs de balayage ou niveaux de bruit, sa capacité de segmentation sémantique se dégrade dramatiquement 🎯.

Fondements du transfert multimodal

Les Vision Foundation Models émergent comme solution paradigmatique par des processus de distillation non supervisée qui transforment des représentations visuelles en connaissance transférable aux domaines lidar. Cette méthodologie exploite la stabilité intrinsèque des modèles d'image pour générer des signaux d'enseignement riches qui guident l'apprentissage du modèle lidar sans nécessiter d'annotations manuelles dans le nouveau domaine capteur 🔄.

Mécanismes clés de la distillation croisée :- Le modèle visuel agit comme professeur génératif produisant des représentations invariantes face aux variations capteurs

- L'élève lidar apprend à émuler ces représentations pendant un pré-entraînement extensif avec des données non étiquetées

- Un espace latent partagé est établi qui facilite l'adaptation ultérieure entre différentes configurations de capteurs

La distillation multimodale crée des ponts cognitifs entre domaines visuels et lidar, répliquant la capacité humaine de transférer la connaissance entre contextes sensoriels différents

Architecture pour une généralisation évolutive

Le choix du backbone lidar détermine de manière critique l'efficacité du processus de transfert. Certaines topologies neuronales démontrent une plus grande aptitude à absorber et conserver les caractéristiques stables provenant des modèles fondation visuels. La méthodologie proposée permet un pré-entraînement unique du backbone par distillation, permettant sa réutilisation dans de multiples scénarios de changement de domaine sans répéter le processus complet 🏗️.

Stratégies de préservation de la généralisation :- Maintien du backbone congelé pendant la phase d'adaptation finale au nouveau capteur

- Entraînement exclusif de têtes MLP légères pour des tâches spécifiques de segmentation

- Extraction de caractéristiques robustes qui résistent aux variations en densité et motifs de balayage

Validation expérimentale et applications pratiques

Cette approche a démontré une supériorité consistente par rapport aux méthodes conventionnelles dans quatre scénarios de référence particulièrement challengants, incluant des transitions entre lidars de différentes densités et configurations de balayage. Dans des implémentations réelles comme la migration de véhicules autonomes depuis des systèmes rotatifs de 64 lignes vers des configurations de 32 lignes, le backbone pré-entraîné extrait des caractéristiques résilientes face aux réductions de densité, tandis que la tête MLP apprend rapidement à mapper ces représentations vers des classes sémantiques spécifiques 🚗.

La combinaison synergique de distillation image-lidar, backbone réutilisable et têtes d'adaptation légères constitue un paradigme efficace et évolutif pour aborder les défis de généralisation en perception robotique. Cette avancée représente un changement conceptuel fondamental : les systèmes lidar apprennent enfin que changer d'outil ne signifie pas réapprendre depuis zéro, mais s'adapter intelligemment à de nouvelles conditions opérationnelles 💡.