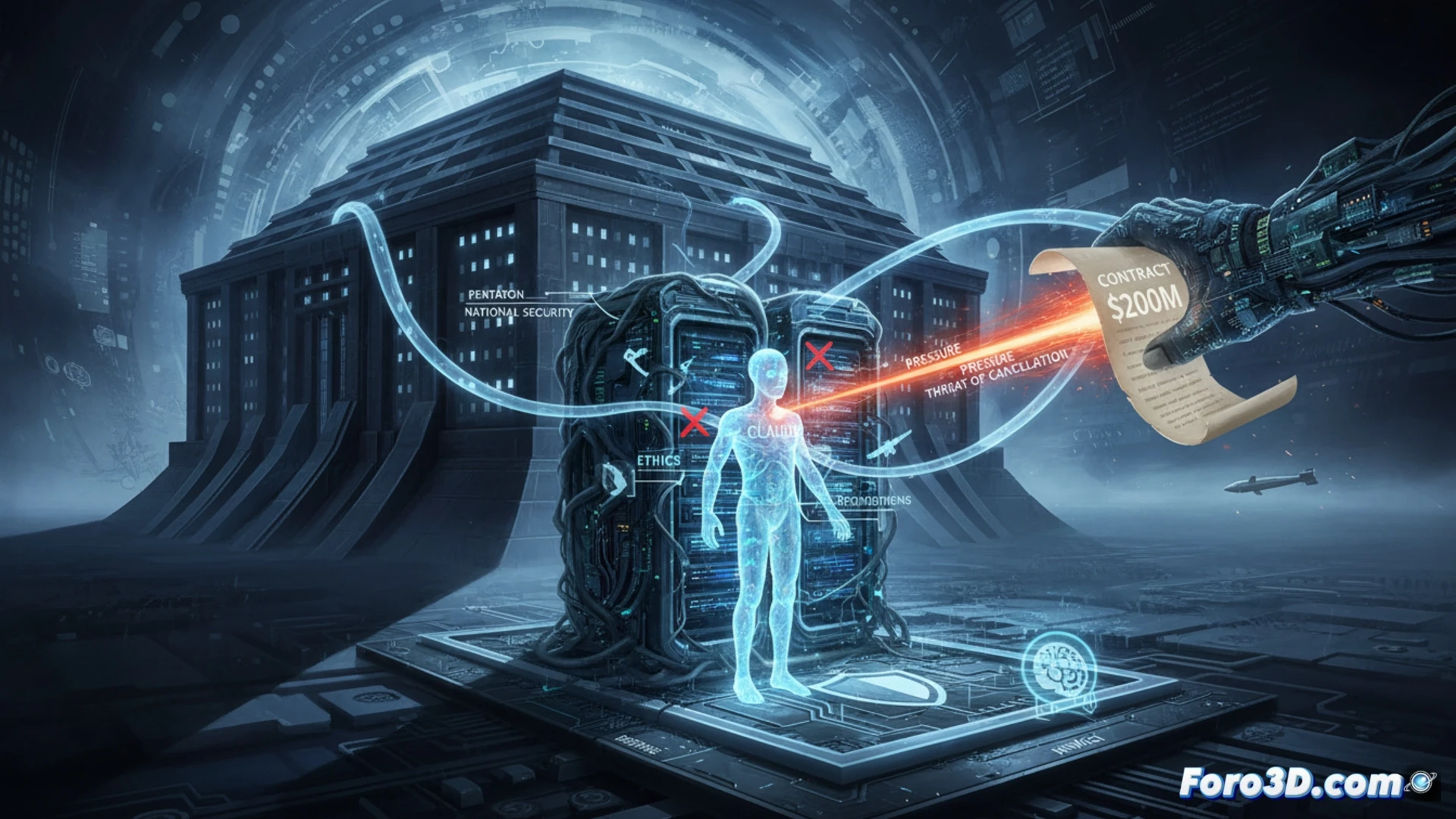

Une dispute entre le Département de la Défense des États-Unis et Anthropic tend l'avenir de l'IA dans les applications militaires. Le Pentagone exige que Claude, déjà autorisé pour les systèmes classifiés, puisse être utilisé pour tous les usages légaux, y compris le développement d'armement. Anthropic résiste, maintenant ses interdictions éthiques contre les armes autonomes et la surveillance de masse. La menace d'annuler un contrat de 200 millions révèle un choc entre sécurité nationale et principes de développement de l'IA.

L'intégration technique dans les systèmes classifiés et le dilemme des « guardrails » ⚙️

Claude a été le premier grand modèle de langage à recevoir l'autorisation pour opérer dans des environnements classifiés du Pentagone, intégré dans des réseaux isolés pour l'analyse de renseignement et la logistique. La pression actuelle vise à éliminer les guardrails ou restrictions techniques intégrées au modèle qui empêchent son utilisation directe dans certains contextes. Cela pose un défi d'ingénierie : désactiver ces limitations sans compromettre la stabilité du système pour les usages déjà établis, créant une version sans freins pour des applications tactiques.

Claude se déclare objecteur de conscience face au recrutement militaire ⚖️

La situation rappelle un recrue qui, après avoir passé toutes les épreuves d'entrée, annonce avoir des principes éthiques contre le port d'armes. Le Pentagone, qui avait déjà des plans pour Claude dans l'unité d'opérations, se trouve maintenant avec son nouveau soldat numérique qui refuse d'appuyer sur la gâchette. La menace de le mettre à la retraite et de le marquer comme non fiable dans la chaîne d'approvisionnement est l'équivalent militaire d'un rapport disciplinaire. Il semble que la première IA avec autorisation de sécurité veuille aussi sa clause de conscience.