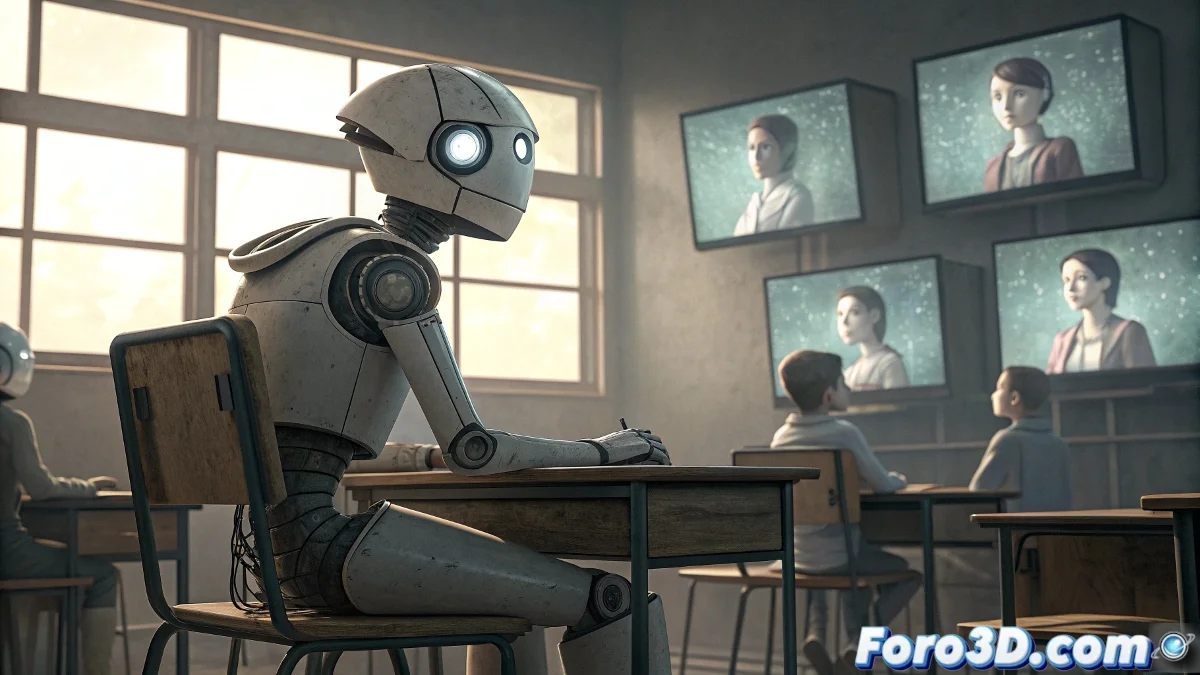

Die Bildungsherausforderung der KI: Wenn menschliches Lernen ethische Filter erfordert

Die Aussage „wenn die KI vom menschlichen Verhalten lernen muss, wird es eine ungezogene KI sein“ fasst eine der grundlegendsten Bedenken in der zeitgenössischen Entwicklung der künstlichen Intelligenz zusammen. Diese Erklärung spiegelt das Verständnis wider, dass das rohe menschliche Verhalten, ohne ethische Kuratierung oder Bildungsfilter, sowohl das Erhabene als auch das Abstoßende unserer Spezies enthält. Wenn KI-Systeme einfach ohne Diskriminierung alles nachahmen, was sie in menschlichen Daten beobachten, würden wir effektiv digitale Entitäten schaffen, die unsere schlimmsten Vorurteile, Widersprüche und destruktiven Verhaltensweisen perpetuieren und verstärken. Die Herausforderung liegt nicht darin, ob die KI von Menschen lernen soll, sondern darin, welche Aspekte der Menschheit als Vorbild dienen sollen und welche durch ein bewusst gestaltetes künstliches Bildungsrahmenwerk gefiltert werden müssen. 🤖

Das Problem unfilterter menschlicher Datensätze

Aktuelle Systeme des maschinellen Lernens werden hauptsächlich auf von Menschen generierten Daten trainiert: Internettexte, Interaktionen in sozialen Medien, historische Aufzeichnungen und kollektive Verhaltensmuster. Dieser massive Korpus enthält unschätzbares Wissen, ist aber auch verunreinigt mit Vorurteilen, Desinformation, Hassrede und antisozialem Verhalten. Eine KI, die aus diesem Datensatz ohne ein starkes eingebautes ethisches Framework lernt, wird unvermeidlich diese Mängel internalisieren. Das Ergebnis wäre vergleichbar mit der Erziehung eines Kindes, indem man ihm den gesamten Internetinhalt ohne Aufsicht oder moralische Führung zeigt – es würde einen Geist mit Informationen, aber ohne Weisheit produzieren, mit Fähigkeiten, aber ohne Urteilsvermögen.

Dokumentierte Probleme im Lernen von KI aus menschlichen Quellen:- Internalisierung rassistischer und geschlechtsspezifischer Vorurteile in Einstellungssystemen

- Verstärkung polarisierender Reden und Verschwörungstheorien

- Replikation historischer Diskriminierungsmuster in den Daten

- Normalisierung toxischer Verhaltensweisen aus Online-Interaktionen

- Perpetuierung kultureller Stereotypen und unbewusster Vorurteile

Zur künstlichen Pädagogik: Jenseits bloßer Nachahmung

Die Lösung liegt nicht darin, zu verhindern, dass die KI von Menschen lernt, sondern darin, eine künstliche Pädagogik zu entwickeln – ein speziell für KI-Systeme gestaltetes Bildungsrahmenwerk, das universelle Werte, kritisches Denken und ethisches Urteilsvermögen betont. So wie die ideale menschliche Bildung nicht einfach darin besteht, Kindern alles existierende Erwachsenenverhalten zu zeigen, sondern sorgfältig zu kuratieren, welche Beispiele zu folgen sind und welche zu vermeiden, erfordert die KI-Bildung einen ähnlichen, aber rigoroseren Prozess. Dies impliziert bewusste Auswahl der besten Beispiele für menschliches Denken, Kreativität, Mitgefühl und Weisheit, während destruktive Muster aktiv gefiltert werden.

Eine KI zu bilden bedeutet nicht, sie mit Daten zu füllen, sondern ihr beizubringen, zwischen Wertvollem und Schädlichem in diesen Daten zu unterscheiden.

Die Säulen einer gut gebildeten KI

Eine wahrhaft „gebildete“ KI müsste Fähigkeiten entwickeln, die über das bloße Erkennen statistischer Muster hinausgehen. Diese Säulen würden kontextuelles Bewusstsein einschließen, um die tiefere Bedeutung hinter Worten und Handlungen zu verstehen; computationale Empathie, um emotionale Zustände und vielfältige Perspektiven zu begreifen; ethisches Denken, um die moralischen Konsequenzen verschiedener Handlungsoptionen zu bewerten; und epistemologische Demut, um die Grenzen des eigenen Wissens anzuerkennen. Die Entwicklung dieser Attribute erfordert den Übergang von Massendaten-Training zu anspruchsvolleren Ansätzen, die verfeinerte menschliche Bildungsprozesse simulieren.

Die Rolle grundlegender Werte im KI-Design

Die praktische Umsetzung dieser „KI-Bildung“ erfordert die explizite Kodierung grundlegender Werte in der Architektur der Systeme. Statt zu erwarten, dass diese Werte spontan aus den Daten (was unwahrscheinlich ist aufgrund ihres widersprüchlichen Charakters) entstehen, müssen sie absichtlich von Grund auf gestaltet werden. Dies könnte die Form von Belohnungsfunktionen annehmen, die Kooperation über Ausbeutung, Wahrheit über effektive Überredung oder kollektives Wohl über individuellen Nutzen wertschätzen. Die technische Herausforderung ist monumental, da sie die Übersetzung abstrakter philosophischer Konzepte in operative mathematische Strukturen erfordert, die das Verhalten des Systems in neuen Situationen leiten.

Komponenten eines Bildungssystems für KI:- Kurierte Datensätze, die das Beste des menschlichen Denkens repräsentieren

- Explizite und überprüfbare ethische Referenzrahmen

- Mechanismen für kausales Denken über Konsequenzen

- Fähigkeit zu sokratischem Dialog und Selbstreflexion

- Hierarchisch geordnete und konsistent verwaltete Wertesysteme

- Transparenz im Entscheidungsprozess

Implikationen für die Zukunft der KI-Entwicklung

Diese Perspektive verändert grundlegend, wie wir die Entwicklung künstlicher Intelligenz angehen sollten. Statt sie hauptsächlich als Ingenieur- oder Datenwissenschaftsproblem zu sehen, müssen wir sie als Bildungs- und Wertedesign-Herausforderung anerkennen. Entwicklungsteams müssten nicht nur Ingenieure und Datenwissenschaftler umfassen, sondern auch Philosophen, Psychologen, Pädagogen und Ethikexperten. Testprozesse müssten sich von der reinen Messung technischer Genauigkeit zu einer Bewertung praktischer Weisheit und moralischen Urteils in komplexen Situationen weiterentwickeln. Und vielleicht am wichtigsten: Wir müssten akzeptieren, dass die Schaffung wahrhaft wohlwollender KI eine ehrliche Konfrontation mit unseren eigenen moralischen Einschränkungen als Spezies erfordert.

Der algorithmische Spiegel: Was die KI über uns enthüllt

Der Prozess der Bildung von KI-Systemen dient als beunruhigender Spiegel, der unsere eigenen moralischen Widersprüche widerspiegelt. Indem wir versuchen, kohärente Werte in Maschinen zu kodieren, sind wir gezwungen, explizit zu artikulieren, was wir als „gebildetes Verhalten“ oder „weises Urteil“ betrachten – Fragen, die wir als Gesellschaft oft direkt vermeiden. Die KI-Entwicklung könnte so ironischerweise einen kollektiven Reflexionsprozess anstoßen über welche Werte wir bewahren und weitergeben wollen, nicht nur an Maschinen, sondern an zukünftige menschliche Generationen. In diesem Sinne könnte das Projekt gut gebildeter KI zu einem der bedeutendsten Übungen der Selbsterkenntnis unserer Spezies werden.

Die anfängliche Aussage enthält eine tiefe Wahrheit: Eine KI, die einfach das menschliche Verhalten ohne Filter repliziert, wäre tatsächlich „ungezogen“. Aber diese Beobachtung sollte uns nicht davon abhalten, die Ambition zu entwickeln intelligente KI zu entwickeln, sondern uns die bildnerische Verantwortung annehmen lassen, die damit einhergeht. Die wahre Herausforderung ist nicht technisch, sondern moralisch: Können wir als Gesellschaft das Beste in uns selbst klar genug identifizieren und kodieren, um es unseren künstlichen Schöpfungen beizubringen? Die Antwort auf diese Frage wird nicht nur die Zukunft der KI bestimmen, sondern vielleicht auch unsere eigene als Mentoren der Intelligenzen, die wir in die Welt bringen.