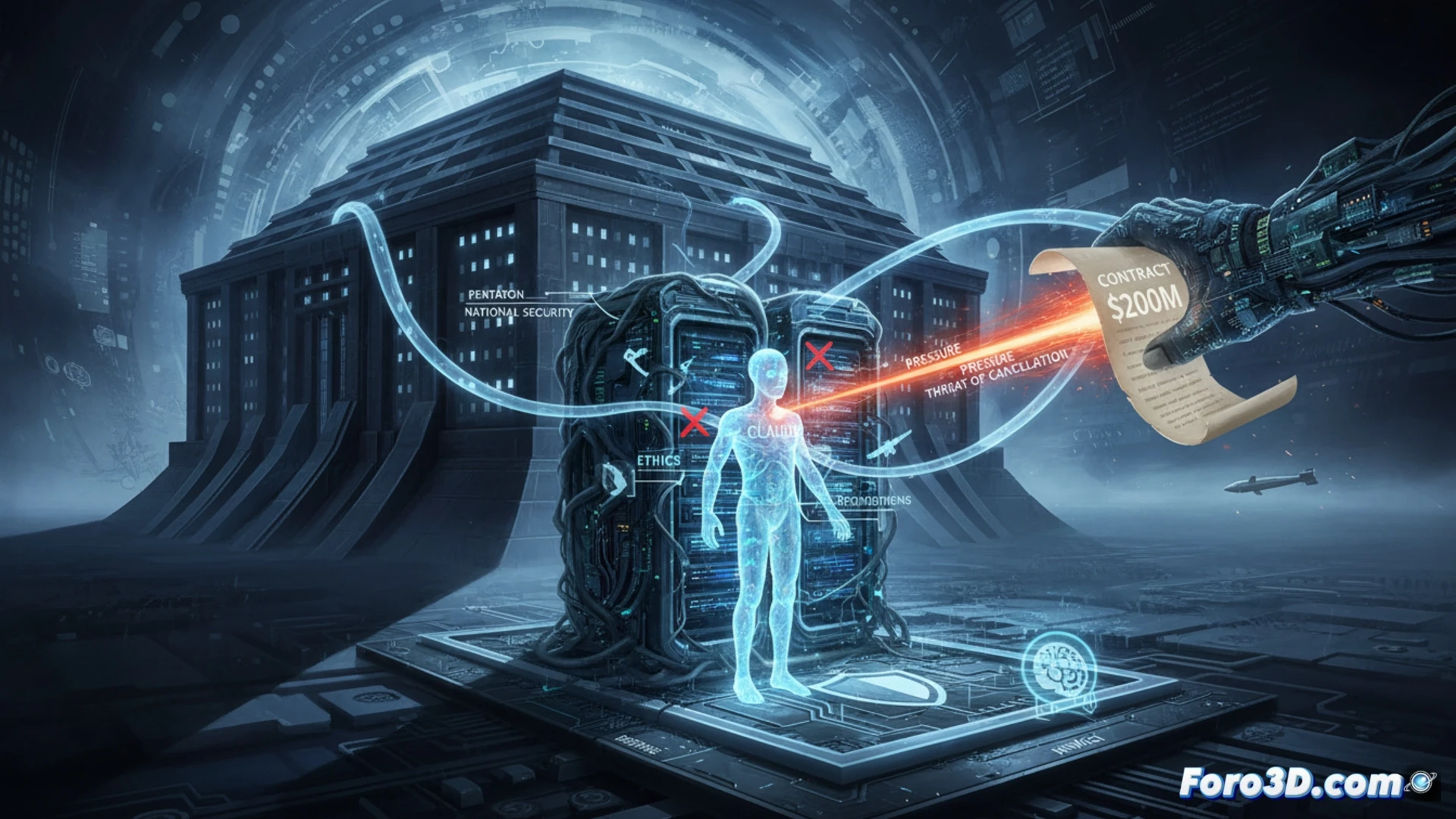

Ein Streit zwischen dem US-Verteidigungsministerium und Anthropic spannt die Zukunft der KI in militärischen Anwendungen. Das Pentagon fordert, dass Claude, das bereits für klassifizierte Systeme autorisiert ist, für alle legalen Zwecke genutzt werden kann, einschließlich der Entwicklung von Rüstungsgütern. Anthropic wehrt sich und behält seine ethischen Verbote gegen autonome Waffen und Massenüberwachung bei. Die Drohung, einen Vertrag über 200 Millionen Dollar zu kündigen, offenbart einen Konflikt zwischen nationaler Sicherheit und Prinzipien der KI-Entwicklung.

Die technische Integration in klassifizierte Systeme und das Dilemma der „Guardrails“ ⚙️

Claude war das erste große Sprachmodell, das die Genehmigung erhielt, in klassifizierten Umgebungen des Pentagons zu operieren, integriert in isolierte Netzwerke für die Analyse von Geheimdienstinformationen und Logistik. Der aktuelle Druck zielt darauf ab, die Guardrails oder technischen Einschränkungen zu entfernen, die im Modell eingebettet sind und seine direkte Nutzung in bestimmten Kontexten verhindern. Dies stellt eine ingenieurtechnische Herausforderung dar: Diese Limitationen zu deaktivieren, ohne die Stabilität des Systems für bereits etablierte Anwendungen zu gefährden, und eine unbremste Version für taktische Anwendungen zu schaffen.

Claude erklärt sich zum Gewissensverweigerer beim Militäreinsatz ⚖️

Die Situation erinnert an einen Rekruten, der nach Bestehen aller Eignungstests ankündigt, aus ethischen Gründen keine Waffen tragen zu wollen. Das Pentagon, das bereits Pläne für Claude in der Operationsabteilung hatte, sieht sich nun mit einem digitalen Soldaten konfrontiert, der sich weigert, abzudrücken. Die Drohung, ihn aus dem Verkehr zu ziehen und als nicht vertrauenswürdig in der Lieferkette zu markieren, ist das militärische Äquivalent zu einer Disziplinarmaßnahme. Es scheint, als wollte die erste KI mit Sicherheitsfreigabe auch ihre Gewissensklausel.