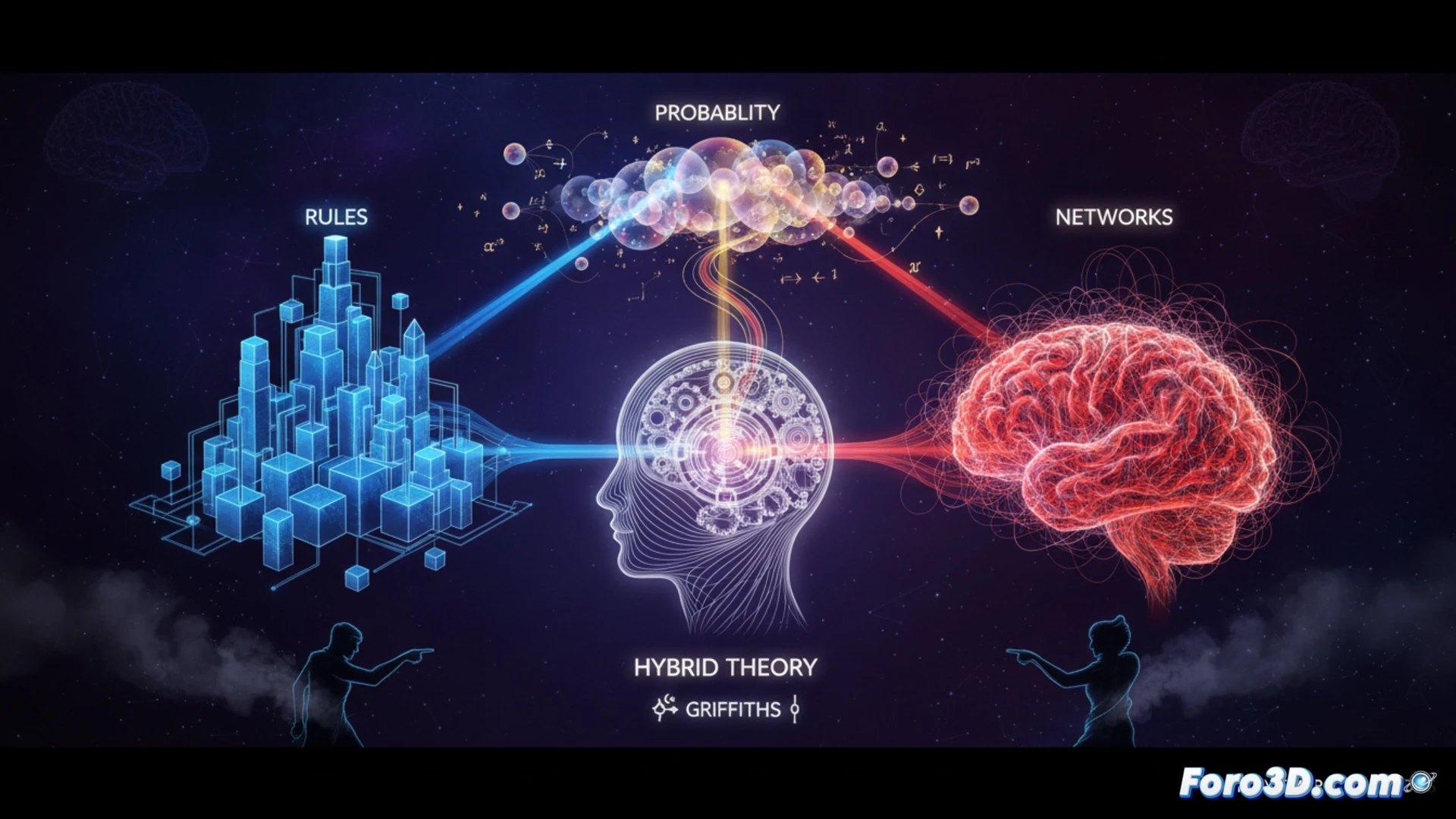

关于智能的研究历史上一直在两种模型之间摇摆:基于逻辑和符号的计算模型,以及以神经网络为中心的连接主义模型。Tom Griffiths 在 The Laws of Thought 中提出,一个完整的理论需要整合三个数学支柱:符号规则、神经网络和概率计算。这种混合观点面临着如 The Emergent Mind 等立场,后者主张纯粹从复杂网络中涌现的智能。

迈向混合架构以超越LLM的局限 ⚙️

当前的大型语言模型主要是连接主义的,这解释了它们在自然语言方面的能力以及缺乏稳健的逻辑推理能力。所提出的整合将添加一个符号规则模块,用于精确推理和规划任务,以及一个贝叶斯概率框架,用于管理不确定性和少样本学习。这种架构可以解决诸如逻辑不一致或数学推理困难等问题。

你的AI是双相的吗?也许它缺少两个数学框架 🤔

这可以理解。一天你的助手写出一首完美的十四行诗,第二天却不知道2+2等于几而不编造一个质数。不是它疯了,而是它的连接主义思维被模式超载且缺乏逻辑。根据Griffiths,它需要整合疗法:一个符号心理分析师和一个概率治疗师。也许这样它就不会自信地断言鸡有三条腿,如果你足够坚定地建议的话。