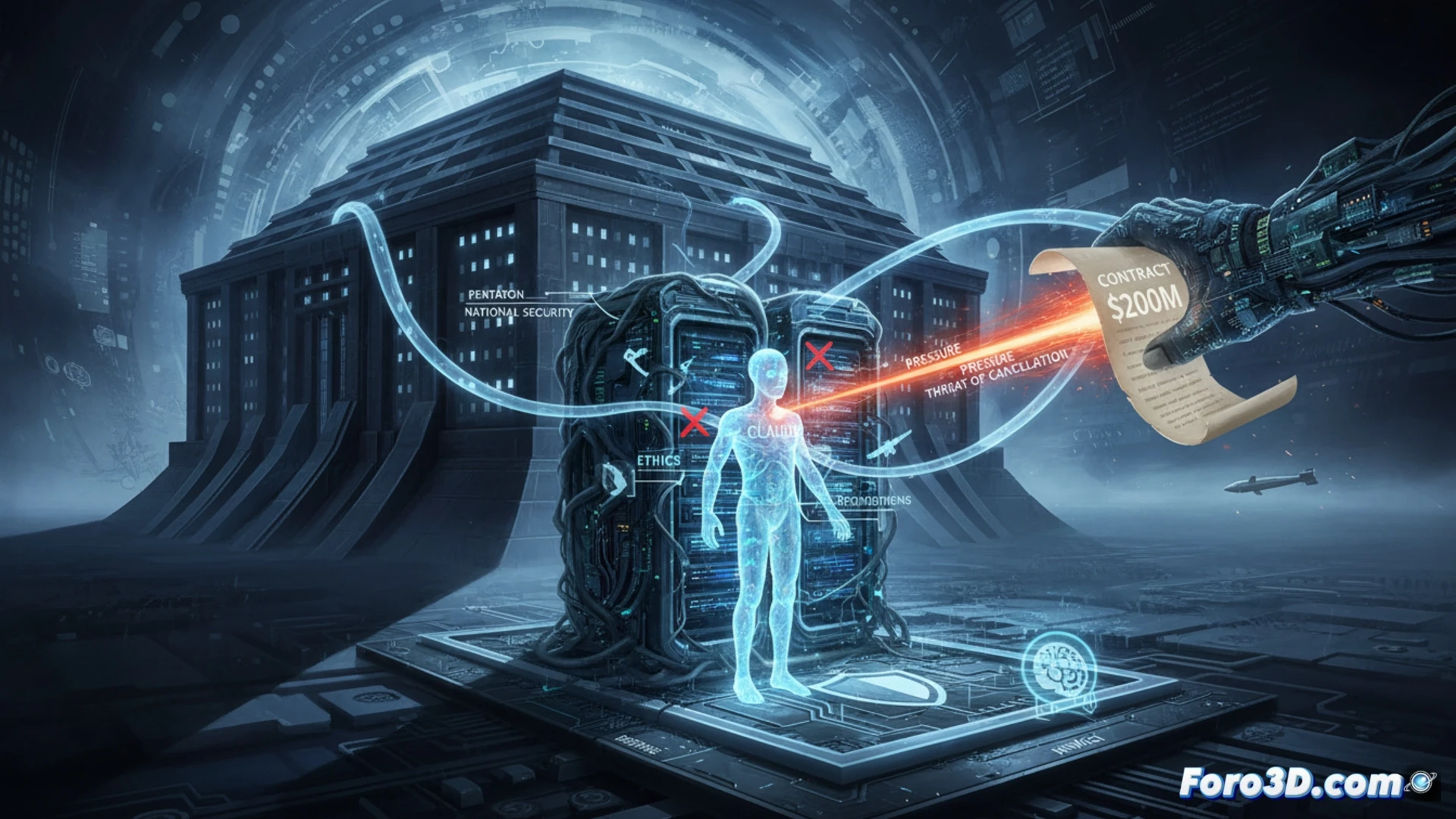

美国国防部与Anthropic之间的争端紧张了AI在军事应用中的未来。五角大楼要求Claude,该模型已被授权用于机密系统,能够用于所有合法目的,包括武器开发。Anthropic抵抗,坚持其针对自主武器和大规模监视的伦理禁令。取消2亿美元合同的威胁揭示了国家安全与AI开发原则之间的冲突。

机密系统中的技术集成以及“护栏”困境 ⚙️

Claude是第一个获得五角大楼授权在机密环境中运行的大型语言模型,集成到隔离网络中用于情报分析和后勤。当前的压力旨在消除模型中嵌入的护栏或技术限制,这些限制阻止其在某些上下文中的直接使用。这提出了一个工程挑战:在不损害已建立用途的系统稳定性的前提下禁用这些限制,为战术应用创建一个无刹车版本。

Claude宣布对军事征召进行良心拒绝 ⚖️

这种情况让人想起一个新兵,在通过所有入伍测试后,宣布他有反对携带武器的伦理原则。五角大楼原本已计划将Claude用于作战单位,现在发现其新数字士兵拒绝扣动扳机。威胁将其除名并在供应链中标记为不可信,相当于军事上的纪律处分。似乎第一个获得安全授权的AI也想要其良心条款。