通过视觉知识蒸馏适应LiDAR模型

异构LiDAR传感器的互操作性是开发鲁棒自主系统中最复杂的障碍之一。当用特定传感器数据训练的模型面对分辨率、扫描模式或噪声水平的变化时,其语义分割能力会急剧下降🎯。

多模态转移基础

Vision Foundation Models通过无监督蒸馏过程作为范式解决方案,将视觉表示转化为可转移到LiDAR域的知识。这种方法利用图像模型的内在稳定性来生成丰富的教学信号,指导LiDAR模型的学习,而无需在新传感器域中进行手动标注🔄。

交叉蒸馏的关键机制:- 视觉模型充当生成式教师,产生对传感器变化不变的表示

- LiDAR学生模型在广泛预训练期间使用无标签数据学习模仿这些表示

- 建立共享潜在空间,促进不同传感器配置之间的后续适应

多模态蒸馏在视觉域和LiDAR域之间创建认知桥梁,复制人类在不同感官上下文之间转移知识的能力

可扩展泛化架构

LiDAR backbone的选择对转移过程的有效性至关重要。某些神经网络拓扑显示出更大的能力来吸收和保留来自视觉基础模型的稳定特征。所提出方法允许通过蒸馏进行单一预训练 backbone,从而使其可在多个域变化场景中重复使用,而无需重复完整过程🏗️。

泛化保存策略:- 在最终适应新传感器的阶段保持冻结backbone

- 专为特定分割任务训练轻量级MLP头

- 提取抵抗密度和扫描模式变化的鲁棒特征

实验验证和实际应用

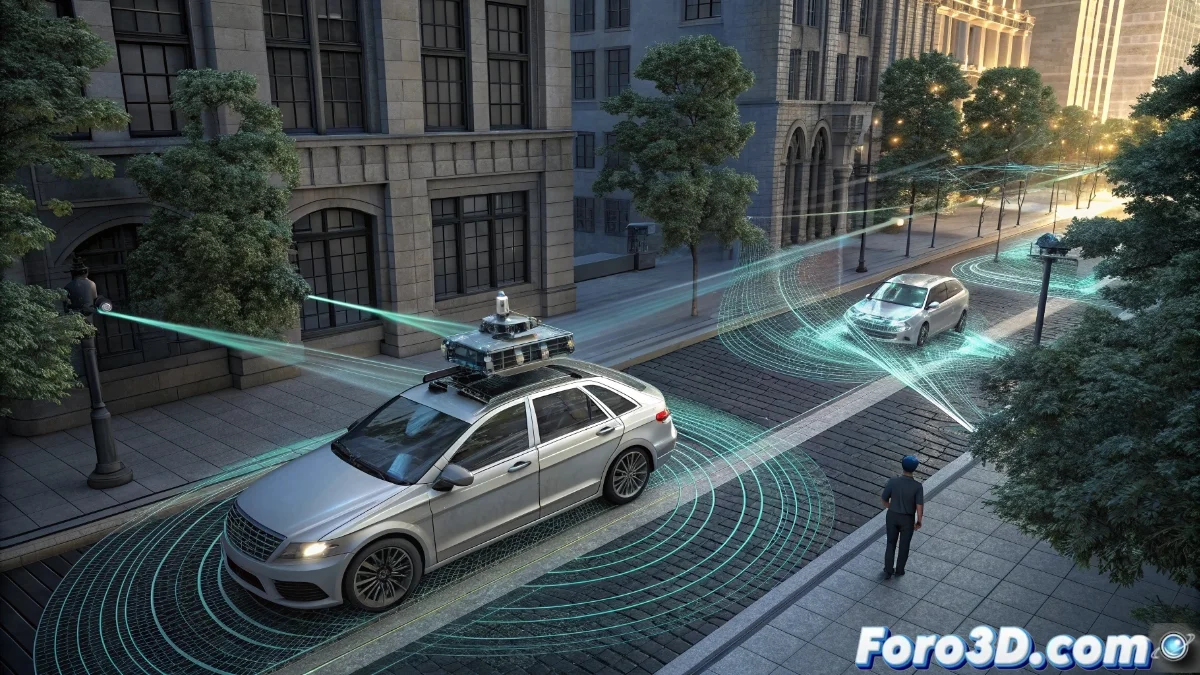

这种方法在四个特别具有挑战性的参考场景中,相对于传统方法显示出一致优越性,包括不同密度和扫描配置的LiDAR之间过渡。在实际实现中,如自主车辆从64线旋转系统迁移到32线配置,预训练backbone提取对密度降低具有弹性的特征,而MLP头快速学习将这些表示映射到特定语义类🚗。

图像-LiDAR蒸馏、可重用backbone和轻量级适应头的协同组合构成了一个高效且可扩展的范式,用于解决机器人感知中的泛化挑战。这一进步代表了一个根本性的概念转变:LiDAR系统终于学会了,换工具并不意味着从零重新学习,而是智能适应新操作条件💡。