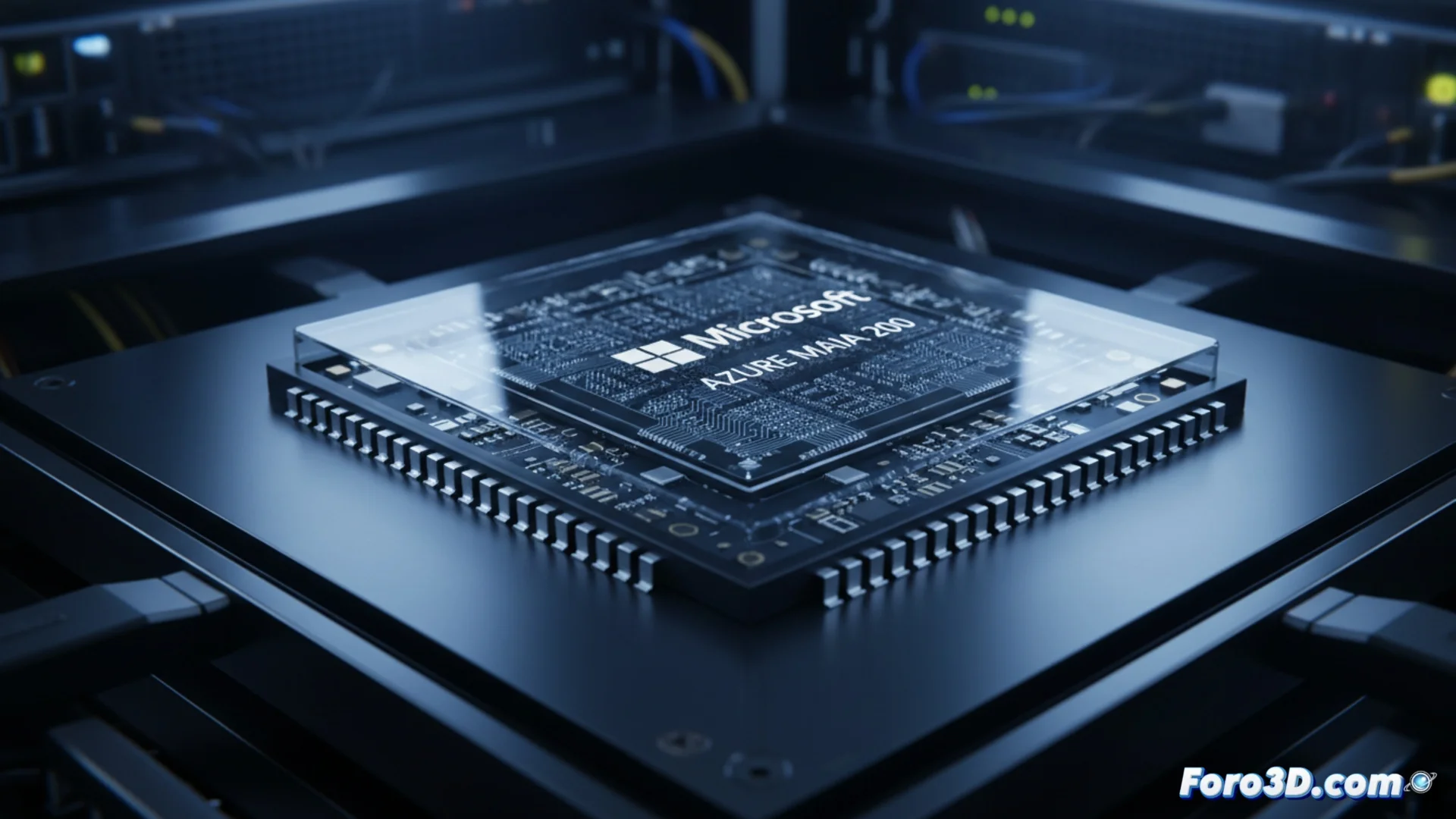

Microsoft 推出 AI 加速器 Azure Maia 200

科技公司 Microsoft 发布了其新的人工智能加速器,Azure Maia 200。此组件代表 Maia 处理器家族的演进,这些处理器专门为在服务器中运行而设计。其主要任务是运行已训练的 AI 模型,以生成响应和预测。Microsoft 设计这种硬件,以高速和高效处理这些操作,据公司称,其效率超过当前 Amazon 和 Google 等竞争对手在该领域的水平。🚀

专注于推理的高效性和速度

Azure Maia 200 的制造目的是优化在 Azure 云平台中大规模执行 AI 模型的方式。通过生产自己的芯片,Microsoft 寻求对整个硬件和软件链的更直接控制,从而能够更精确地调整系统处理数据的方式。这种方法旨在减少等待时间,并改善运行复杂模型时的能源使用,从大型语言模型到图像分析系统。公司未展示其架构的所有细节,但表示设计优先考虑内存容量以及芯片之间的连接方式,以管理当前模型的巨大参数集。

Azure Maia 200 的关键特性:- 设计用于以高速执行 AI 推理任务。

- 旨在提升数据中心的能源效率。

- 架构优先考虑内存带宽和互连。

看来新的全球竞争不是用导弹,而是用晶体管,看谁能更快处理关于小猫的查询。

AI 硅片的竞争格局

Maia 200 的推出显示了科技行业的一个广泛趋势,即大型云服务提供商开发自己的专用芯片。Amazon 拥有 Inferentia 和 Trainium 处理器,而 Google 使用其 Tensor Processing Units (TPU)。通过推出 Maia 200,Microsoft 巩固了其提供独特 AI 基础设施的计划,不仅在软件服务上竞争,还在底层的性能硬件上竞争。公司计划在全球数据中心部署这些加速器,以推动 Azure OpenAI Service 和其他生成式 AI 操作。

云端定制芯片的主要参与者:- Microsoft:Azure Maia 200 用于推理。

- Amazon Web Services:Inferentia 和 Trainium 芯片。

- Google Cloud:Tensor Processing Units (TPU)。

对云计算未来的影响

这一举措突显了 AI 霸权之竞赛如今 critically 依赖于定制硅片。通过同时控制软件和硬件,Microsoft 旨在为其客户提供更集成和高效的堆栈。最终目标是以更快速度和更低运营成本处理更大、更复杂的 AI 模型,从而定义云端的新性能标准。🔌