当多模态模型失去视觉但保留语言时

多模态模型的优化 以获得速度和效率,揭示了一个奇异的非对称性:其视觉处理能力比语言推理能力衰退得快得多。这种差异对依赖精确视觉解释的系统构成了关键障碍,从智能助手到家用机器人自动化。👁️🗨️

多模态压缩的基本问题

当开发者缩小多模态模型的大小以提高性能时,视觉理解遭受的冲击比语言处理不成比例。这种退化可能导致错误解释场景和物体,即使语言组件保留一定的分析能力。实际后果是,看似功能正常的系统在需要精确视觉感知的任务中可能犯下严重错误。

视觉-语言非对称性的后果:- 错误解释照片和视觉场景的虚拟助手

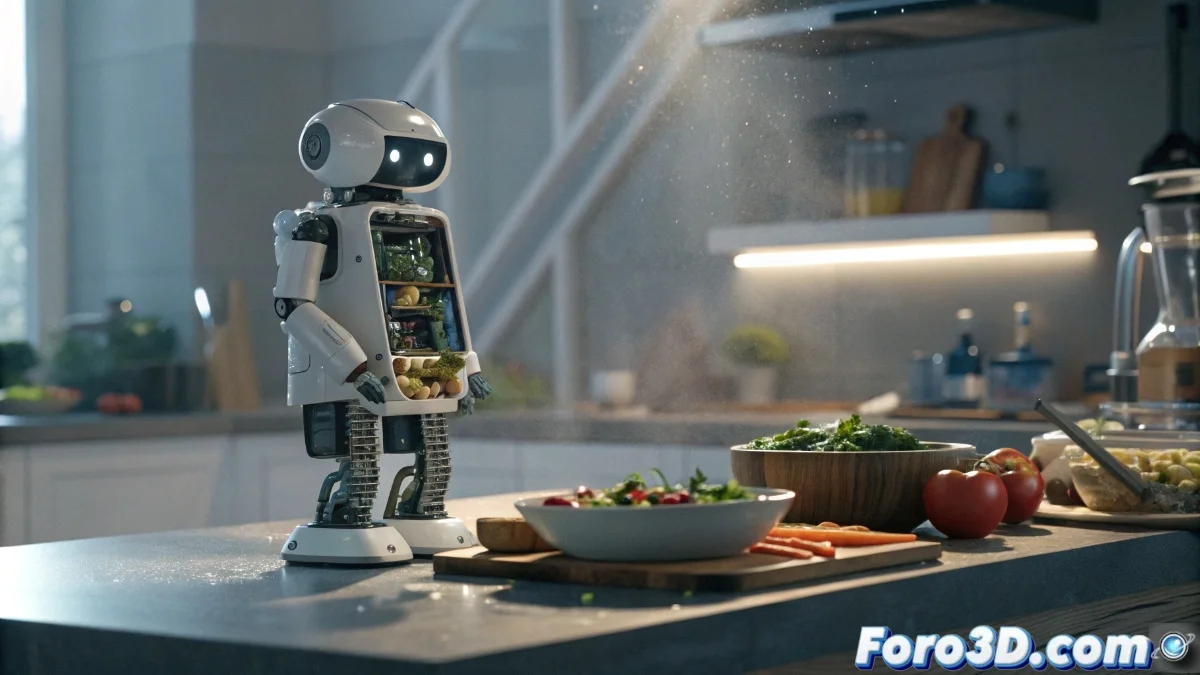

- 难以识别物体和上下文的家用机器人

- 在视觉复杂环境中失败的自动化系统

"较小模型中退化的视觉感知可能导致错误解释,即使语言组件保持推理能力"

Extract+Think:两阶段解决方案

研究提出了Extract+Think,一种通过两个明确定义的阶段运作的方法论。首先,训练模型根据每个特定指令一致提取相关视觉细节。随后,系统对这些已识别的视觉元素应用逐步推理以生成精确响应。这种结构化方法确保即使是紧凑模型也能通过在分析前聚焦关键方面来保持高水平的视觉理解。

Extract+Think 方法的优势:- 选择性提取相关视觉细节

- 对已识别元素的结构化推理

- 在优化模型中保留视觉能力

在资源有限环境中的实际应用

这种方法论的好处在现实世界场景中特别有价值,其中硬件能力受限。分析图像的虚拟助手如果先识别物体和重要细节,然后再对其推理,就能保持正确的场景理解。同样,具有有限计算资源的家用机器人可以通过这种顺序提取和推理过程聚焦关键视觉元素,从而精确识别厨房中的食材并遵循食谱。

有限硬件的使用案例:- 分析环境照片的移动虚拟助手

- 与日常物体互动的经济家用机器人

- 实时处理视觉信息的嵌入式系统

人类学习与人工智能学习悖论

讽刺的是,人工智能需要学会在得出结论前区分本质与附属,这是人类在婴儿早期自然发展出的技能。虽然儿童在幼儿园就掌握了这种能力,但机器需要多年的专门训练才能达到类似的视觉选择性辨识水平。这个悖论突显了在人工智能系统中复制人类感知的基本复杂性。🤖