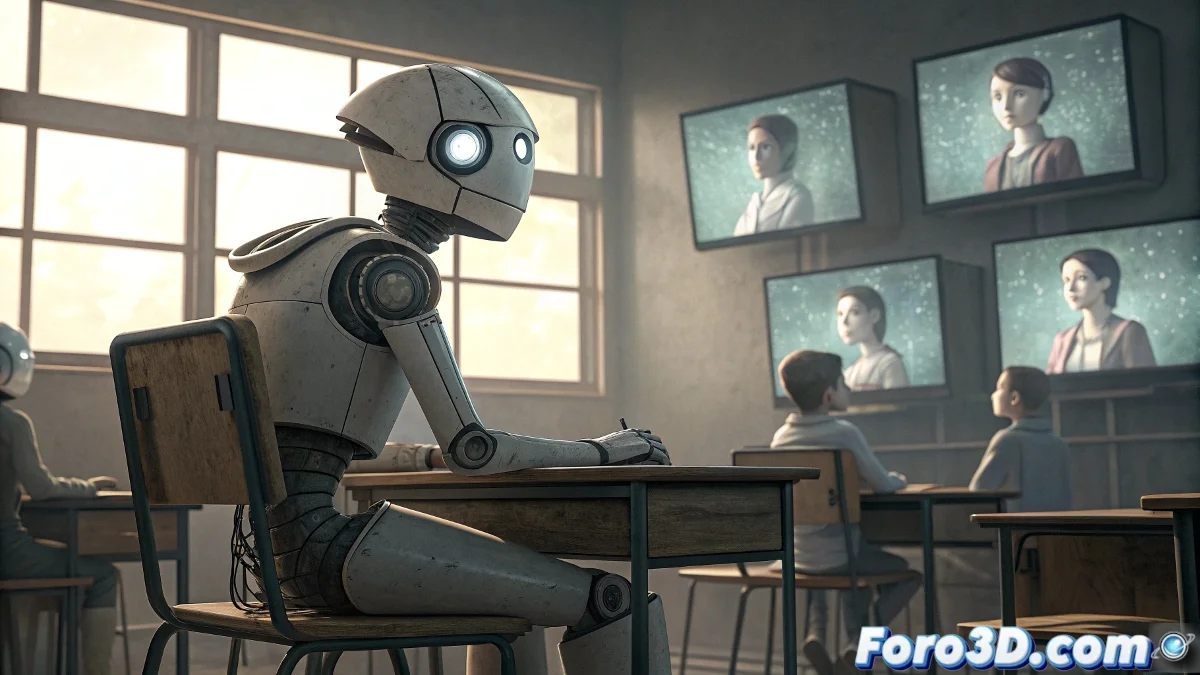

人工智能的教育挑战:当人类学习需要伦理过滤器时

“如果人工智能必须从人类行为中学习,它将是一个未经教育的AI”这一断言概括了当代人工智能发展中最根本的担忧之一。这一声明反映了这样的理解:未经修饰的人类行为,没有伦理策展或教育过滤器,包含了我们物种中既崇高又卑劣的一切。如果AI系统只是不加区分地模仿它们在人类数据中观察到的一切,我们实际上将创造出 perpetúan y amplifican 我们最糟糕的偏见、矛盾和破坏性行为的数字实体。挑战不在于AI是否应该从人类那里学习,而在于人类哪些方面应该作为模型,以及哪些应该通过有意识设计的 artificial 教育框架进行过滤。🤖

未经过滤的人类数据集问题

当前的学习系统主要在人类生成的数据上训练:互联网文本、社交媒体互动、历史记录和集体行为模式。这个海量语料库包含了宝贵的知识,但也被偏见、虚假信息、仇恨言论和反社会行为污染。一个从这个数据集学习而没有强有力的内置伦理框架的AI,不可避免地会内化这些缺陷。结果类似于让一个孩子无监督、无道德指导地看所有互联网内容——会产生一个有信息但无智慧、有能力但无判断力的头脑。

AI从人类来源学习中记录的问题:- 在招聘系统中内化种族和性别偏见

- 放大两极分化的言论和阴谋论

- 复制数据中存在的历史歧视模式

- 正常化从在线互动中学到的有毒行为

- perpetuación de estereotipos culturales y prejuicios inconscientes

走向人工智能教育学:超越单纯模仿

解决方案不在于阻止AI从人类那里学习,而在于开发我们称之为人工智能教育学的东西——一个专门为AI系统设计的教育框架,强调普遍价值观、批判性思维和伦理判断。就像理想的人类教育不仅仅是向孩子们展示所有现有的成人行为,而是仔细策展哪些例子要跟随、哪些要避免一样,AI教育需要类似但更严格的过程。这意味着有意识地选择最佳的人类推理、创造力、同情心和智慧例子,同时积极过滤破坏性模式。

教育AI不是用数据填充它,而是教它在这些数据中区分有价值和有害的内容。

良好教育AI的支柱

一个真正“受教育”的AI需要发展超越单纯统计模式识别的能力。这些支柱将包括:上下文意识,以理解词语和行动背后的更深层含义;计算同理心,以理解情感状态和多样化视角;伦理推理,以评估不同行动路线的道德后果;以及认识论谦逊,以承认自身知识的局限性。发展这些属性需要超越海量数据批量训练,转向更复杂的模拟精炼人类教育过程的方法。

价值观基础在AI设计中的作用

这种“AI教育”的实际实施需要将基本价值观明确编码到系统架构中。与其期望这些价值观从数据中自发出现(鉴于其矛盾性,这不太可能),它们必须从基础有意设计。这可能采取奖励函数的形式,这些函数重视合作而非剥削、真理而非有效说服,或集体福祉而非个人利益。技术挑战是巨大的,因为它需要将抽象的哲学概念转化为指导系统在新颖情境中行为的运算数学结构。

AI教育系统的组件:- 策展的数据集,代表人类思维的最佳部分

- 明确且可验证的伦理参考框架

- 关于后果的因果推理机制

- 苏格拉底式对话和自我反思能力

- 一致管理的分层价值观系统

- 决策过程的透明度

对AI未来发展的影响

这种视角从根本上改变了我们应该如何对待人工智能开发的方式。我们不应主要将其视为工程或数据科学问题,而应将其视为教育和价值观设计挑战。开发团队需要包括不仅仅是工程师和数据科学家,还有哲学家、心理学家、教育者和伦理专家。测试过程必须从仅仅衡量技术精度演变为在复杂情境中评估实践智慧和道德判断。也许最重要的是,我们必须接受创建真正仁慈的AI需要诚实地面对我们作为物种自身的道德局限性。

算法之镜:AI揭示了关于我们的什么

教育AI系统的过程作为一个令人不安的镜子,反映了我们自身的道德矛盾。在试图将连贯价值观编码到机器中时,我们被迫明确表达我们认为什么是“受教育的行为”或“明智的判断”——这些是我们作为社会常常避免直接面对的问题。AI的发展因此可能讽刺地推动集体反思过程,关于我们想要保留和传承哪些价值观,不仅给机器,还给未来人类一代。在这个意义上,创建良好教育AI的项目可能成为我们物种最重大的自我认知练习之一。

最初的断言包含了一个深刻的真理:一个简单复制未经过滤人类行为的AI确实将是“未经教育的”。但这一观察不应导致我们放弃开发智能AI的雄心,而是拥抱随之而来的教育责任。真正的挑战不是技术性的,而是道德性的:我们作为社会能否足够清晰地识别并编码我们自己的最佳部分,以便教给我们的 artificial 造物?这个问题的答案将不仅决定AI的未来,或许还决定我们作为我们正在带入世界的智能导师的未来。