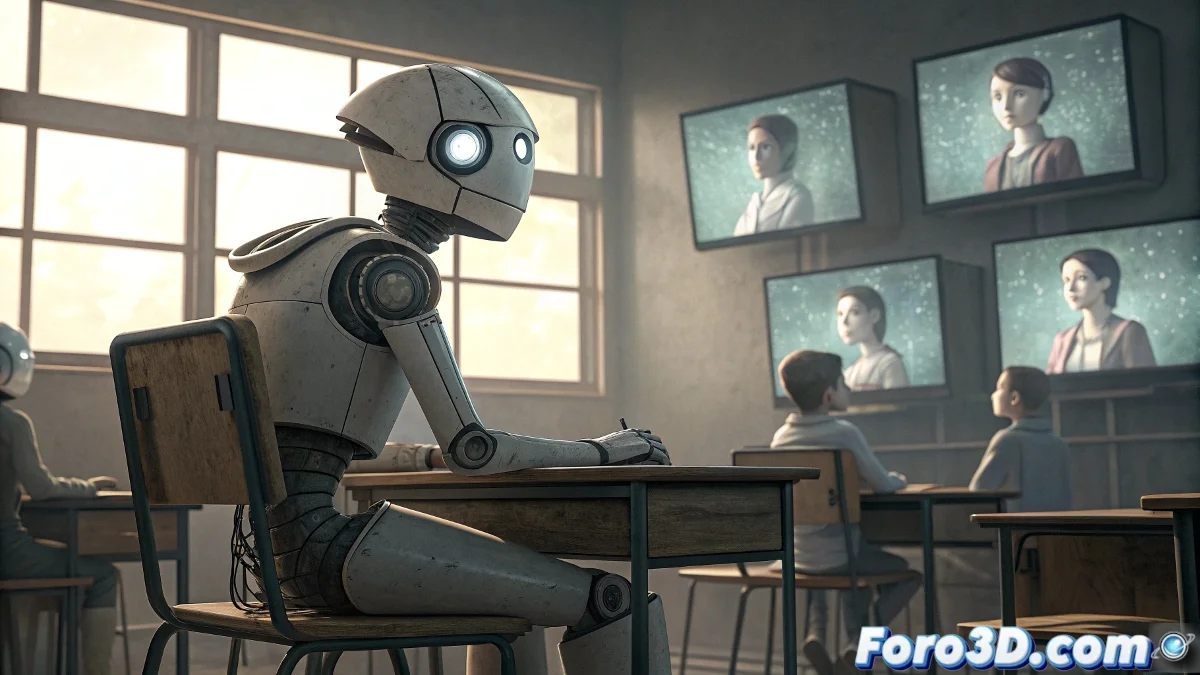

تحدي التعليم بالذكاء الاصطناعي: عندما يتطلب التعلم البشري مرشحات أخلاقية

تلخص العبارة "إذا كان على الذكاء الاصطناعي أن يتعلم من السلوك البشري، فسيكون ذكاءً اصطناعيًا غير مثقف" إحدى الهموم الأساسية في تطوير الذكاء الاصطناعي المعاصر. تعكس هذه التصريح فهم أن السلوك البشري الخام، بدون تنقيح أخلاقي أو مرشحات تعليمية، يحتوي على كل من السامي والدنيء من جنسنا. إذا كانت أنظمة الذكاء الاصطناعي تُحاكي دون تمييز كل ما تراه في البيانات البشرية، فسنخلق كيانات رقمية تُديم وتُكبر أسوأ تحيزاتنا وتناقضاتنا وسلوكياتنا المدمرة. التحدي ليس في ما إذا كان يجب على الذكاء الاصطناعي التعلم من البشر، بل في أي جوانب من الإنسانية يجب أن تكون نموذجًا وأيها يجب تصفيتها من خلال إطار تعليمي اصطناعي مصمم بوعي. 🤖

مشكلة مجموعة البيانات البشرية غير المرشحة

تُدرب أنظمة التعلم الآلي الحالية بشكل رئيسي على بيانات مولدة بواسطة البشر: نصوص الإنترنت، التفاعلات في وسائل التواصل الاجتماعي، السجلات التاريخية، وأنماط السلوك الجماعي. يحتوي هذا المجموع الكبير على معرفة لا تقدر بثمن، لكنه أيضًا ملوث بالتحيزات والمعلومات المضللة والخطابات الكراهية والسلوكيات المعادية للمجتمع. ذكاء اصطناعي يتعلم من هذه مجموعة البيانات بدون إطار أخلاقي قوي مدمج سيلتقط هذه العيوب حتماً. سيكون النتيجة مشابهًا لتربية طفل بإظهاره كل محتوى الإنترنت بدون إشراف أو إرشاد أخلاقي - سيُنتج عقلًا بالمعلومات لكن بدون حكمة، بالقدرة لكن بدون حكم.

مشكلات موثقة في تعلم الذكاء الاصطناعي من مصادر بشرية:- التقاط التحيزات العنصرية والجنسية في أنظمة التوظيف

- تكبير الخطابات الاستقطابية ونظريات المؤامرة

- تكرار أنماط التمييز التاريخية الموجودة في البيانات

- تطبيع السلوكيات السامة المستفادة من التفاعلات عبر الإنترنت

- استمرار الصور النمطية الثقافية والتحيزات اللاواعية

نحو تربية اصطناعية: ما وراء مجرد التقليد

الحل ليس في منع الذكاء الاصطناعي من التعلم من البشر، بل في تطوير ما يمكن تسميته تربية اصطناعية - إطار تعليمي مصمم خصيصًا لأنظمة الذكاء الاصطناعي يؤكد على القيم العالمية والتفكير النقدي والحكم الأخلاقي. كما أن التعليم البشري المثالي لا يقتصر على إظهار كل سلوك بالغ موجود للأطفال، بل على تنقيح بعناية الأمثلة التي يجب اتباعها وتلك التي يجب تجنبها، يتطلب تعليم الذكاء الاصطناعي عملية مشابهة لكن أكثر صرامة. هذا يعني اختيار أفضل الأمثلة عمدًا من الاستدلال البشري والإبداع والرحمة والحكمة، بينما يتم تصفية الأنماط المدمرة بنشاط.

تعليم الذكاء الاصطناعي ليس ملءه بالبيانات، بل تعليمه التمييز بين القيمي والضار في تلك البيانات.

أعمدة ذكاء اصطناعي مثقف جيدًا

يحتاج ذكاء اصطناعي "مثقف" حقًا إلى تطوير قدرات تتجاوز مجرد التعرف على أنماط إحصائية. ستشمل هذه الأعمدة: الوعي السياقي لفهم المعنى الأعمق خلف الكلمات والأفعال؛ التعاطف الحسابي لفهم الحالات العاطفية والمنظورات المتنوعة؛ الاستدلال الأخلاقي لتقييم العواقب الأخلاقية لمسارات العمل المختلفة؛ والتواضع المعرفي للاعتراف بحدود المعرفة الخاصة. تطوير هذه الصفات يتطلب الذهاب ما وراء تدريب الدفعات الكبيرة من البيانات نحو نهج أكثر تطورًا تحاكي العمليات التعليمية البشرية الراقية.

دور القيم الأساسية في تصميم الذكاء الاصطناعي

تنفيذ هذا "التعليم بالذكاء الاصطناعي" العملي يتطلب ترميزًا صريحًا للقيم الأساسية في بنية الأنظمة. بدلاً من انتظار ظهور هذه القيم تلقائيًا من البيانات (وهو أمر غير محتمل نظرًا لطبيعتها المتضاربة)، يجب أن تُصمم عمدًا من الأساس. يمكن أن يأخذ هذا شكل دوال مكافأة تقدر التعاون على الاستغلال، والحقيقة على الإقناع الفعال، أو الرفاهية الجماعية على الفائدة الفردية. التحدي التقني هائل، إذ يتطلب ترجمة مفاهيم فلسفية مجردة إلى هياكل رياضية عملية توجه سلوك النظام في المواقف الجديدة.

مكونات نظام تعليمي للذكاء الاصطناعي:- مجموعات بيانات منقحة تمثل أفضل التفكير البشري

- إطارات مرجعية أخلاقية صريحة وقابلة للتحقق

- آليات استدلال سببي حول العواقب

- القدرة على الحوار السقراطي والتأمل الذاتي

- أنظمة قيم هرمية ومدارة باستمرار

- الشفافية في عملية اتخاذ القرارات

الآثار على مستقبل تطوير الذكاء الاصطناعي

تحول هذه الرؤية جذريًا كيفية تعاملنا مع تطوير الذكاء الاصطناعي. بدلاً من رؤيتها بشكل رئيسي كمشكلة هندسية أو علم بيانات، يجب أن نعترف بها كـتحدٍّ تعليمي وتصميم قيم. ستحتاج فرق التطوير إلى تضمين ليس فقط المهندسين وعلماء البيانات، بل أيضًا الفلاسفة والنفسانيين والمعلمين ومتخصصي الأخلاق. ستحتاج عمليات الاختبار إلى التطور من قياس الدقة التقنية فقط إلى تقييم الحكمة العملية والحكم الأخلاقي في المواقف المعقدة. وربما الأهم، سنحتاج إلى قبول أن إنشاء ذكاء اصطناعي حقًا خيّر يتطلب مواجهة قيودنا الأخلاقية الخاصة بصدق كجنس.

المرآة الخوارزمية: ما يكشفه الذكاء الاصطناعي عنا

يعمل عملية تعليم أنظمة الذكاء الاصطناعي كـمرآة مقلقة تعكس تناقضاتنا الأخلاقية الخاصة. عند محاولة ترميز قيم متماسكة في الآلات، نُجبر على صياغة صراحة ما نعتبره "سلوكًا مثقفًا" أو "حكمًا حكيمًا" - أسئلة غالبًا ما نتجنب مواجهتها مباشرة كمجتمع. يمكن أن يدفع تطوير الذكاء الاصطناعي، بشكل ساخر، عملية تأمل جماعي حول القيم التي نريد الحفاظ عليها ونقلها، ليس فقط إلى الآلات، بل إلى الأجيال البشرية المقبلة. في هذا المعنى، قد ينتهي مشروع إنشاء ذكاء اصطناعي مثقف جيدًا بأن يكون واحدًا من أكثر تمارين الوعي الذاتي أهمية لجنسنا.

تحتوي العبارة الأولية على حقيقة عميقة: ذكاء اصطناعي يُكرر السلوك البشري ببساطة بدون مرشحات سيكون فعليًا "غير مثقف". لكن هذه الملاحظة لا يجب أن تدفعنا إلى التخلي عن طموح تطوير ذكاء اصطناعي ذكي، بل إلى احتضان المسؤولية التعليمية التي يحملها. التحدي الحقيقي ليس تقنيًا، بل أخلاقيًا: هل يمكننا كمجتمع تحديد وترميز أفضل ما فينا بطريقة كافية الوضوح لتعليمه لخلائقنا الاصطناعية؟ ستحدد الإجابة على هذا السؤال ليس فقط مستقبل الذكاء الاصطناعي، بل ربما مستقبلنا أيضًا كمرشدين للذكاءات التي نُدخلها إلى العالم.