Lo que mencionas no es ninguna tontería, sino una técnica que algunos llaman rigging facial a partir de mapas o imágenes bitmap, que funcionan como guías para controlar expresiones. En vez de animar directamente los huesos o blendshapes, se usa una imagen que contiene una especie de

mapa de deformación o zonas específicas, que luego se asocian a controles de la cara.

Cómo funciona esta técnica en 3D

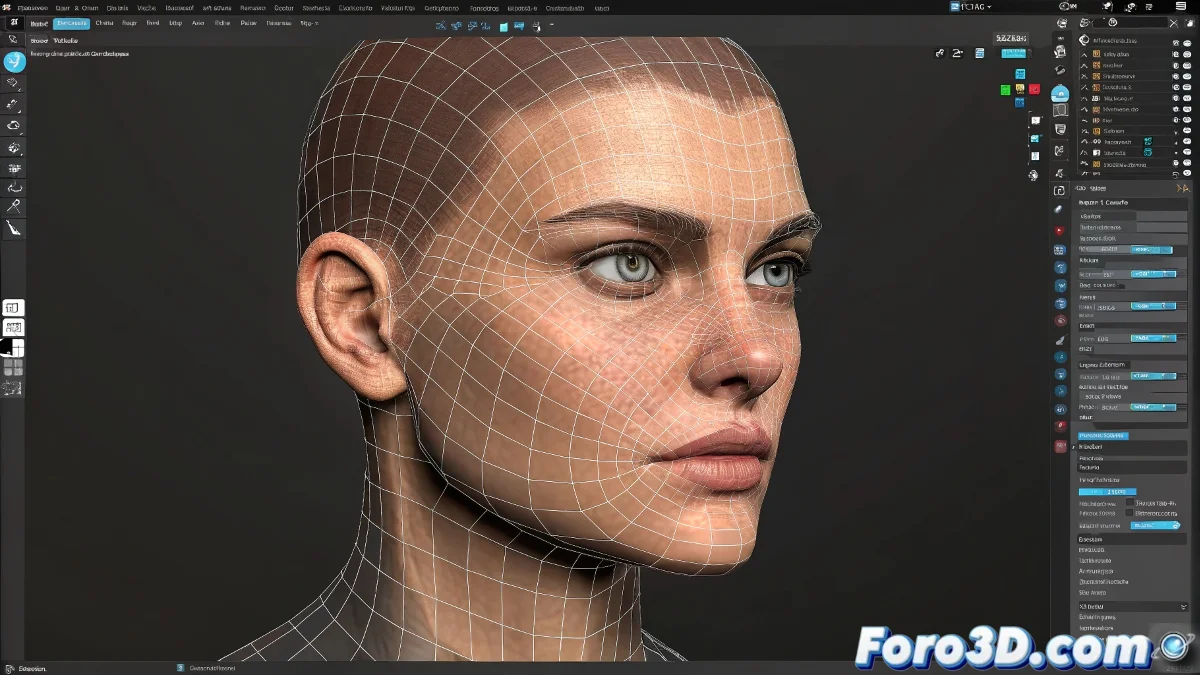

Normalmente, el proceso consiste en tomar una imagen esquemática del rostro del personaje, una especie de plantilla donde se marcan zonas como cejas, labios, ojos o mejillas. Luego, en el software 3D (como Maya, 3ds Max o Blender), esta imagen se utiliza para generar controladores o deformadores basados en esos segmentos. Así, al mover un control, la malla se deforma siguiendo la información del mapa, haciendo más intuitiva la animación facial.

En programas como

Faceware o

Adobe Character Animator se usan métodos similares, aunque con capturas de video. En 3ds Max, algunos scripts o plugins permiten importar imágenes como referencias para crear controladores faciales basados en esas zonas.

Consejo final y toque irónico

Si te animas a probarlo, verás que la animación facial basada en mapas es como tener un “fotomatón” de emociones: rápido, visual y práctico, aunque claro, no reemplaza la experiencia de un buen animador. Al final, hasta la cara más digital puede terminar con un tic raro si no la mimas bien.