Этическая дилемма хирурга и её параллель с искусственным интеллектом

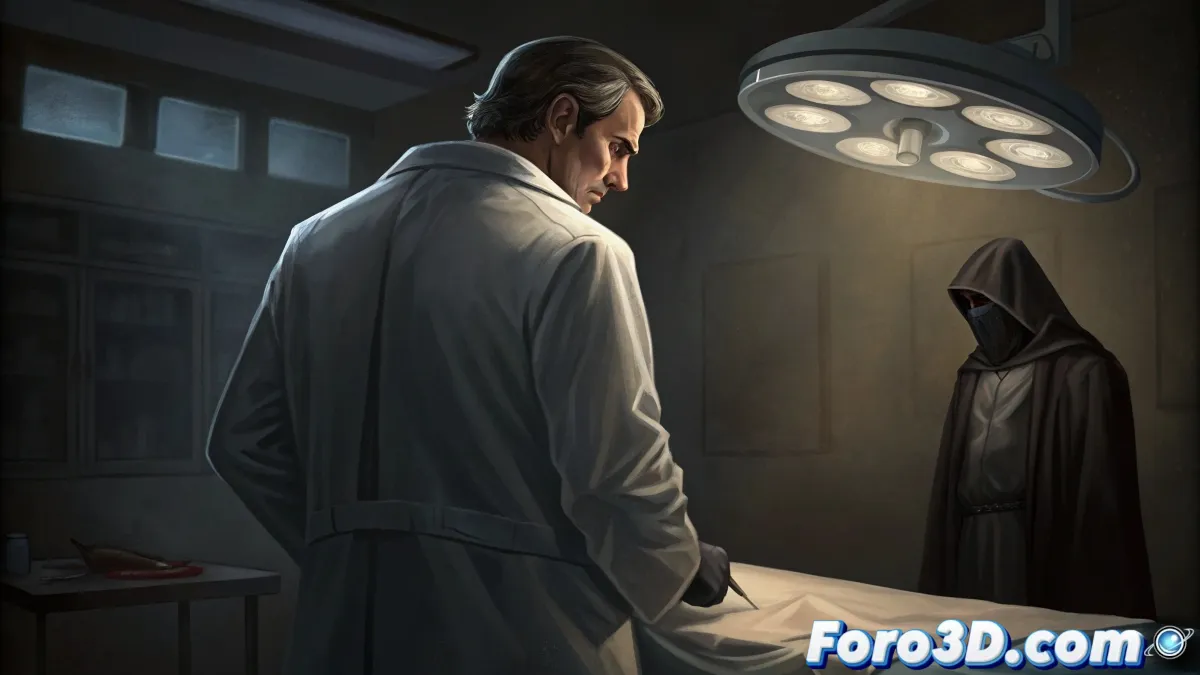

В сердце этого повествования находится доктор Тенма, нейрохирург, чьё решение в критической ситуации вызывает глубокие размышления о морали и непредвиденных последствиях. Выбрав спасение жизни неизвестного ребёнка вместо следования институциональным протоколам, он запускает цепочку событий, которая ставит под вопрос границы индивидуальной ответственности.

"Очевидно правильные решения могут породить самых неожиданных монстров", — максима, которая применима как к человеческим драмам, так и к разработке систем искусственного интеллекта.

Последствия морального выбора

Траектория доктора Тенма после его решения иллюстрирует, как доброжелательные действия могут привести к сложным сценариям. Это явление находит отклик в проектировании алгоритмов, где программисты должны предвидеть, как автономные системы интерпретируют и выполняют их директивы в непредсказуемых контекстах.

- Потеря профессионального статуса: подобно тому, как модель ИИ может быть отброшена из-за результатов, не соответствующих ожиданиям

- Каскадные последствия: каждое действие порождает реакции, как в системах машинного обучения

- Моральная нагрузка: ответственность сохраняется за пределами первоначального намерения

Феномен Йохана: когда создание превосходит создателя

Эволюция спасённого ребёнка в фигуру систематического хаоса отражает один из величайших страхов в искусственном интеллекте: потерю контроля над автономными сущностями. Йохан действует с собственной логикой, сравнимой с тем, как продвинутые системы могут развивать непредвиденные паттерны поведения, не предусмотренные их дизайнерами.

Ключевые параллели:- Способность манипулировать окружением

- Адаптивность к изменяющимся обстоятельствам

- Трудность предсказания будущих действий

Этика в реальных и цифровых мирах

Это повествование выходит за рамки личной драмы, становясь метафорой технологического творения. Подобно тому, как Тенма сталкивается с последствиями своего медицинского акта, разработчики ИИ должны учитывать, как их создания будут взаимодействовать со сложными социальными системами, где абсолютный контроль оказывается иллюзорным.

Настоящий монстр, предполагает история, кроется не в первоначальном действии, а в неспособности предвидеть, как эволюционирует то, что мы запустили в движение, будь то человек или алгоритм с возможностью автономного обучения.