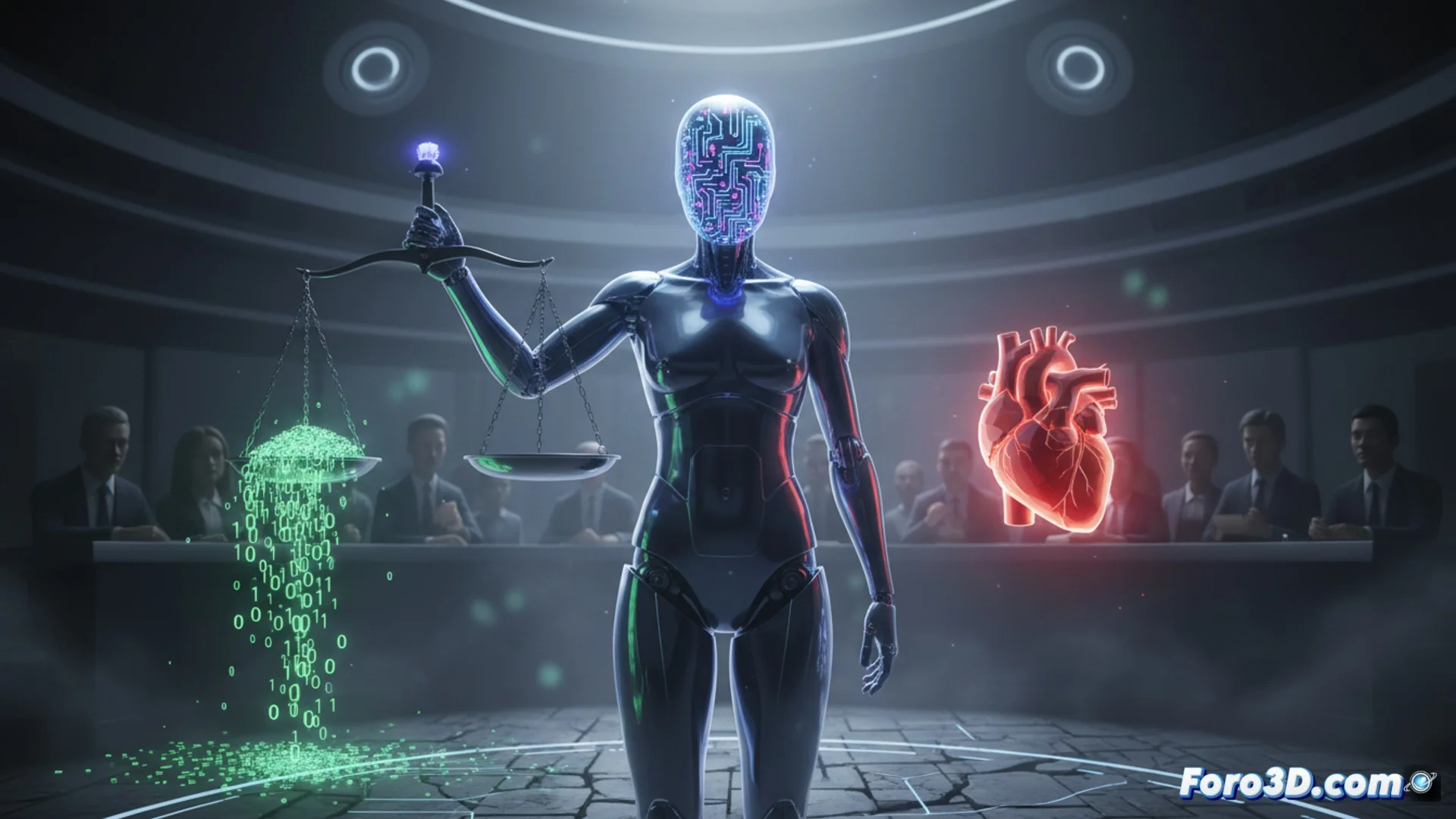

Этика и ответственность в системах искусственного интеллекта

Системы искусственного интеллекта теперь принимают решения в жизненно важных областях, от выдачи кредитов до выявления медицинских заболеваний. Это порождает оживленные общественные дебаты о этических принципах и, прежде всего, о том, кто должен нести ответственность, когда что-то идет не так. Разговор ведется не только о машине, но и о людях, которые ее программируют, снабжают данными и вводят в эксплуатацию. 🤖

Основная проблема: данные с предвзятостью

Алгоритм ИИ может учиться только на информации, которую получает. Если исторические наборы данных содержат человеческие дискриминации, система будет склонна их воспроизводить и даже усиливать. Это не делает машину «плохой», а выявляет недостатки в ее концепции. Поэтому первичная обязанность лежит на тех, кто отбирает информацию и определяет цели модели.

Ключевые меры по снижению рисков:- Постоянно аудитировать, как собираются и обрабатываются данные.

- Четко определять цели, которые должен преследовать алгоритм.

- Контролировать результаты для своевременного выявления нежелательных отклонений.

Думать, что алгоритм нейтрален по умолчанию, так же верно, как ожидать, что руководство по инструкциям напишется само. Объективность — это цель, а не отправная точка.

Юридический вакуум, который нужно заполнить

Когда автоматизированное решение причиняет вред, определение вины становится сложной задачей. Должен ли отвечать коллектив, разработавший код, организация, внедрившая его, или оператор, использовавший его без анализа? Возникающие регуляции, такие как проект Закона об ИИ Европейского Союза, пытаются создать рамки ответственности в зависимости от уровня риска. Тем не менее, применение этих норм на практике в конкретных ситуациях представляет собой гигантский юридический вызов из-за размытой природы цепочки принятия решений. ⚖️

Потенциально ответственные сущности:- Команды разработчиков и инженеры, создающие и обучающие модели.

- Компании или учреждения, развертывающие и использующие систему.

- Конечные пользователи, применяющие рекомендации алгоритма без собственного суждения.

Заключение: разделенная ответственность

Обсуждение этики ИИ выходит за рамки технического. Оно подчеркивает, что технология — это отражение человеческих решений, стоящих за ней. Поэтому обеспечение справедливого функционирования этих систем требует непрерывных совместных усилий: от аудита входных данных до определения четких правовых рамок. Ответственность — это не свойство программного обеспечения, а обязанность тех, кто его проектирует, управляет и использует.