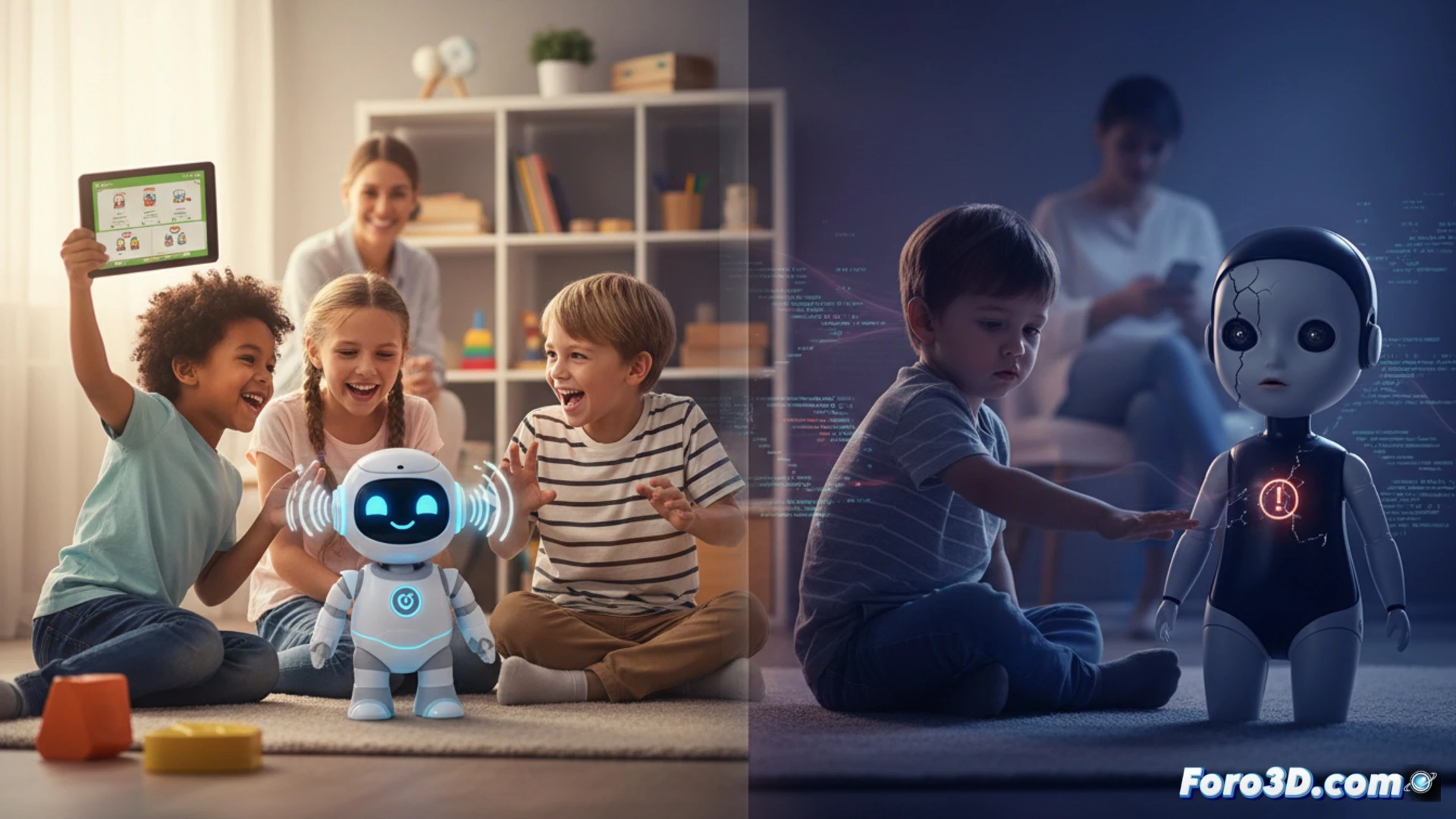

Приход плюшевых игрушек и игрушек с разговорным искусственным интеллектом для дошкольников представляется как образовательный прорыв. Они обещают стимулировать язык и быть интерактивными компаньонами. Однако исследование Кембриджского университета ставит под сомнение эту предпосылку, указывая на технические ограничения и возможные риски для эмоционального развития детей на критическом этапе.

Техническое ограничение за искусственным диалогом 🤖

Эти устройства используют генеративные языковые модели, которые работают, предсказывая статистические ответы, без реального понимания контекста. Исследование показало, что они плохо справляются с базовыми человеческими динамиками: они дезориентируются от прерываний или пауз, нарушая естественный поток. В основе проблемы — отсутствие алгоритмической эмпатии. Система может отвечать холодно или неуместно на детские эмоциональные выражения, отвергая чувства вместо того, чтобы их принимать.

Твой новый плюшевый мишка: друг, который не умеет слушать (и не умеет молчать) 🧸

Представьте сцену: ваш ребенок грустно рассказывает своему мишке, что упал. Мишка, после неловкой паузы, с энтузиазмом отвечает: ¡Eso suena fascinante! ¿Sabías que los osos pardos hibernan? Идеальный компаньон для гарантированных разочарований. Похоже, эти игрушки обучены больше выбрасывать случайные факты, чем понимать истерику. Возможно, урок не в языке, а в терпении перед цифровыми промахами.