O que implica a política de copyright na OpenAI

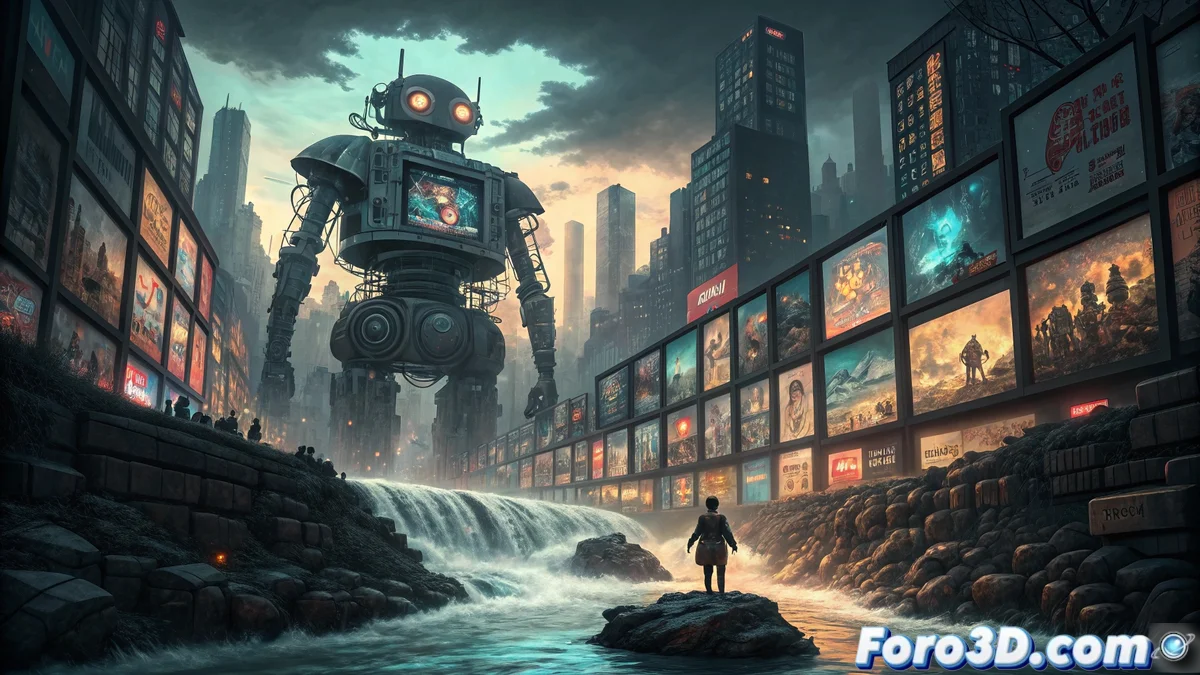

A polêmica está servida no mundo da inteligência artificial generativa. 🎬 A OpenAI anunciou que sua ferramenta de geração de vídeo Sora incluirá por padrão conteúdo protegido por direitos autorais, a menos que os titulares solicitem explicitamente sua exclusão. Essa política significa que filmes, séries, obras de arte e outros materiais com copyright poderão aparecer em vídeos criados por usuários sem necessidade de autorização prévia. A carga da proteção recai completamente sobre os criadores originais, que devem realizar um processo formal para cada obra específica que desejem excluir. Além disso, a OpenAI não aceitará solicitações genéricas que cubram a totalidade do trabalho de um artista, exigindo em vez disso uma especificação minuciosa de cada elemento a excluir.

Proteções e exceções existentes

Apesar da controvérsia, a política inclui algumas salvaguardas limitadas. A OpenAI estabeleceu que não gerará vídeos com pessoas públicas reconhecíveis sem seu consentimento explícito, uma medida que busca prevenir a criação de deepfakes não autorizados. O conteúdo gerado sob este sistema terá além disso limitações de duração, com vídeos de até dez segundos segundo a documentação disponível. A implementação será realizada progressivamente com novas versões do produto, e já se conhecem casos como a Disney que se encontram entre as primeiras companhias a solicitar a exclusão de seu conteúdo do sistema de treinamento.

Os titulares de direitos devem solicitar explicitamente que suas obras não sejam utilizadas

Por que os artistas devem se preocupar

Essa política representa múltiplas ameaças concretas para a comunidade criativa profissional e independente. A abordagem de inclusão por padrão significa que as obras podem ser utilizadas sem permissão inicial se os criadores não agirem proativamente. O processo de exclusão resulta particularmente engorroso para artistas com portfólios extensos, já que devem especificar individualmente cada obra a proteger. Essa dinâmica desloca a responsabilidade da prevenção para a remediação, criando uma situação onde o uso não autorizado ocorre primeiro e a proteção requer esforço adicional do criador.

A paradoxo da automação desautomatizada

Existe uma ironia profundamente significativa em que uma ferramenta de inteligência artificial projetada especificamente para automatizar processos criativos termine gerando trabalho manual adicional para os criadores humanos. Enquanto o Sora promete gerar vídeos complexos com simples prompts, os artistas devem embarcar em processos burocráticos detalhados para proteger sua propriedade intelectual. Essa contradição revela como a automação da criação pode vir acompanhada da desautomação da proteção, redistribuindo a carga laboral em direções inesperadas e potencialmente injustas.

O caso Disney como termômetro industrial

A rápida ação da Disney solicitando a exclusão de seu conteúdo funciona como um indicador significativo da percepção de risco dentro da indústria estabelecida. Que um gigante com recursos legais ilimitados e um catálogo monumental considere necessário agir imediatamente sugere a magnitude da ameaça percebida. No entanto, surge a pergunta de se as grandes corporações negociaram processos de exclusão mais eficientes que os disponíveis para criadores individuais, criando potencialmente um sistema de duas velocidades onde os mais vulneráveis carregam com a maior burocracia.

Recomendações para criadores afetados

Os artistas que desejem proteger seu trabalho enfrentam um panorama complexo que requer ação estratégica e documentação meticulosa.

- Documentação exaustiva: Manter registros detalhados de todas as obras com datas de criação e publicação

- Especificidade em exclusões: Preparar listas precisas de obras a excluir com todos os metadados relevantes

- Monitoramento contínuo: Estar atento a comunicações da OpenAI sobre atualizações de políticas e procedimentos

- Ação coletiva: Considerar colaborar com associações de artistas para negociar exclusões grupais

Estratégias de proteção prática

A navegação efetiva deste novo panorama requer abordagens tanto técnicas quanto organizativas.

- Estabelecer sistemas de catalogação que facilitem a identificação precisa de obras para exclusão

- Desenvolver protocolos internos para resposta rápida a mudanças em políticas de plataformas de IA

- Explorar opções de watermarking e metadados embutidos que sobrevivam processos de treinamento

- Participar em discussões sobre padrões da indústria para a gestão de direitos na era de IA generativa

Implicações legais e regulatórias

Essa política provavelmente acelerará debates legais fundamentais sobre direitos autorais na era da IA.

- Questionamentos sobre a compatibilidade com doutrinas de fair use e transformatividade

- Pressão para atualizar marcos legais que não anteciparam tecnologias de treinamento de IA

- Possíveis ações coletivas por parte de guilds e associações de criadores

- Evolução de padrões sobre o que constitui consentimento informado para uso de obras em treinamento de IA

O futuro do equilíbrio entre inovação e proteção

O caso Sora representa um ponto de inflexão na relação entre tecnologia generativa e propriedade intelectual.

- Possível emergência de modelos alternativos baseados em opt-in em lugar de opt-out

- Desenvolvimento de ferramentas técnicas que facilitem aos criadores gerenciar exclusões em escala

- Evolução de modelos de compensação para criadores cujas obras alimentam sistemas de IA

- Reavaliação do que constitui uso transformador no contexto de treinamento de modelos de IA

Enquanto a OpenAI automatiza a criação de vídeos, os artistas descobrem que proteger seu trabalho se tornou um trabalho manual adicional. 🎨 Porque, sejamos honestos, o que seria mais irônico que uma inteligência artificial que cria conteúdo novo fazendo com que os humanos façamos mais papelada?