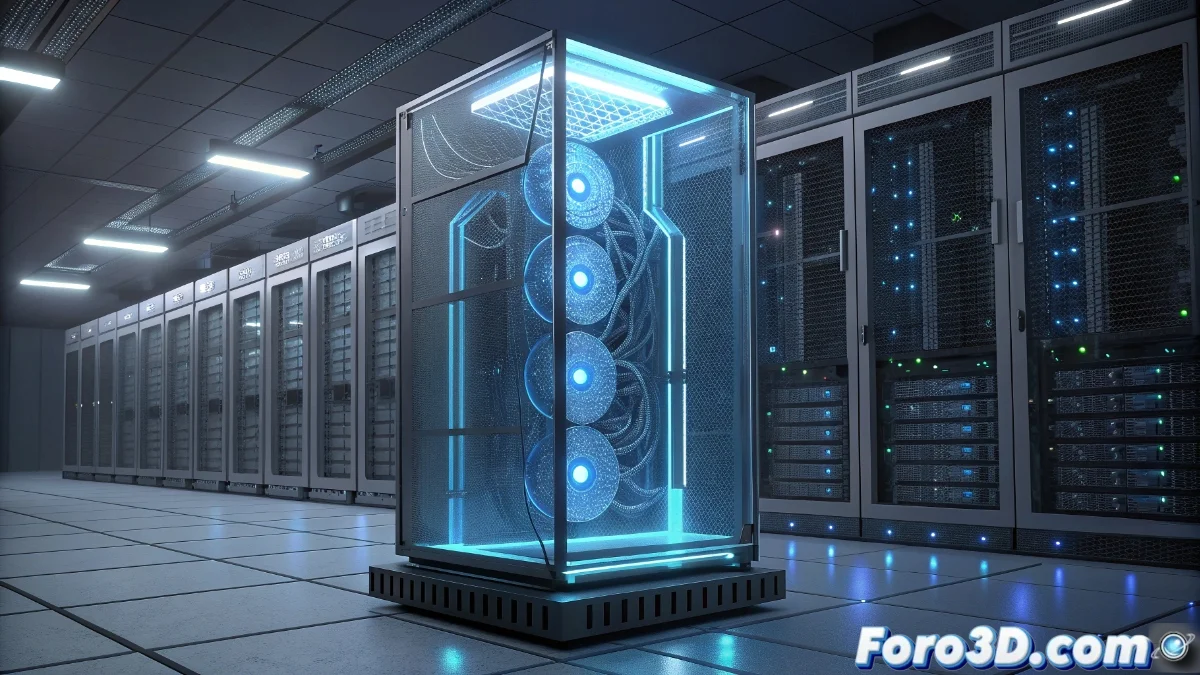

O servidor NVIDIA DGX A100: potência integral para inteligência artificial

O servidor dedicado NVIDIA DGX A100 constitui uma solução completa especialmente projetada para o treinamento massivo e implantação de sistemas de inteligência artificial. Esta plataforma integra oito unidades de processamento gráfico A100 conectadas por meio da tecnologia NVLink, criando um ecossistema de computação paralela sem precedentes. 🚀

Arquitetura de computação avançada

A interconexão NVLink entre as oito GPUs A100 estabelece um domínio de memória unificado que revoluciona o processamento de dados. Esta configuração elimina completamente os gargalos tradicionais na transferência de informações, permitindo que os modelos de deep learning mais complexos sejam treinados em tempos significativamente reduzidos.

Componentes chave do sistema:- Oito GPUs NVIDIA A100 com interconexão NVLink de alta velocidade

- Processador AMD EPYC de alto desempenho para gerenciamento centralizado

- 1 Terabyte de memória RAM para manipulação de datasets massivos

- Armazenamento NVMe para transferências ultrarrápidas

- Sistema de refrigeração avançado para máxima eficiência energética

- Otimização nativa para TensorFlow, PyTorch e outros frameworks

A capacidade de processamento distribuído inerente ao design facilita o manejo de datasets que superam os terabytes, mantendo uma eficiência energética ótima por meio de tecnologia de refrigeração de última geração.

Aplicações em ambientes profissionais

Este sistema está especificamente orientado a projetos de pesquisa avançada onde a escala de modelos ou o volume de dados resultam inmanejáveis para infraestruturas convencionais. Universidades e corporações tecnológicas empregam o DGX A100 para desenvolver sistemas de linguagem natural, visão computacional para veículos autônomos e simulações científicas complexas.

Casos de uso principais:- Desenvolvimento de modelos de linguagem natural em escala industrial

- Sistemas de visão computacional para automóveis autônomos

- Simulações científicas e de pesquisa avançada

- Execução de múltiplas cargas de trabalho por meio de virtualização

- Redução de latência em processos de inferência em tempo real

- Melhoria do throughput em processamento por lotes massivos

Considerações práticas de implementação

A virtualização de GPUs permite executar múltiplas workloads simultaneamente, convertendo esta plataforma em uma solução versátil tanto para ambientes de desenvolvimento quanto de produção. É crucial considerar que quando todas as GPUs operam em capacidade máxima, o consumo energético requer infraestrutura elétrica especializada, comparável ao consumo de instalações industriais de média escala. ⚡