A ética e a responsabilidade nos sistemas de inteligência artificial

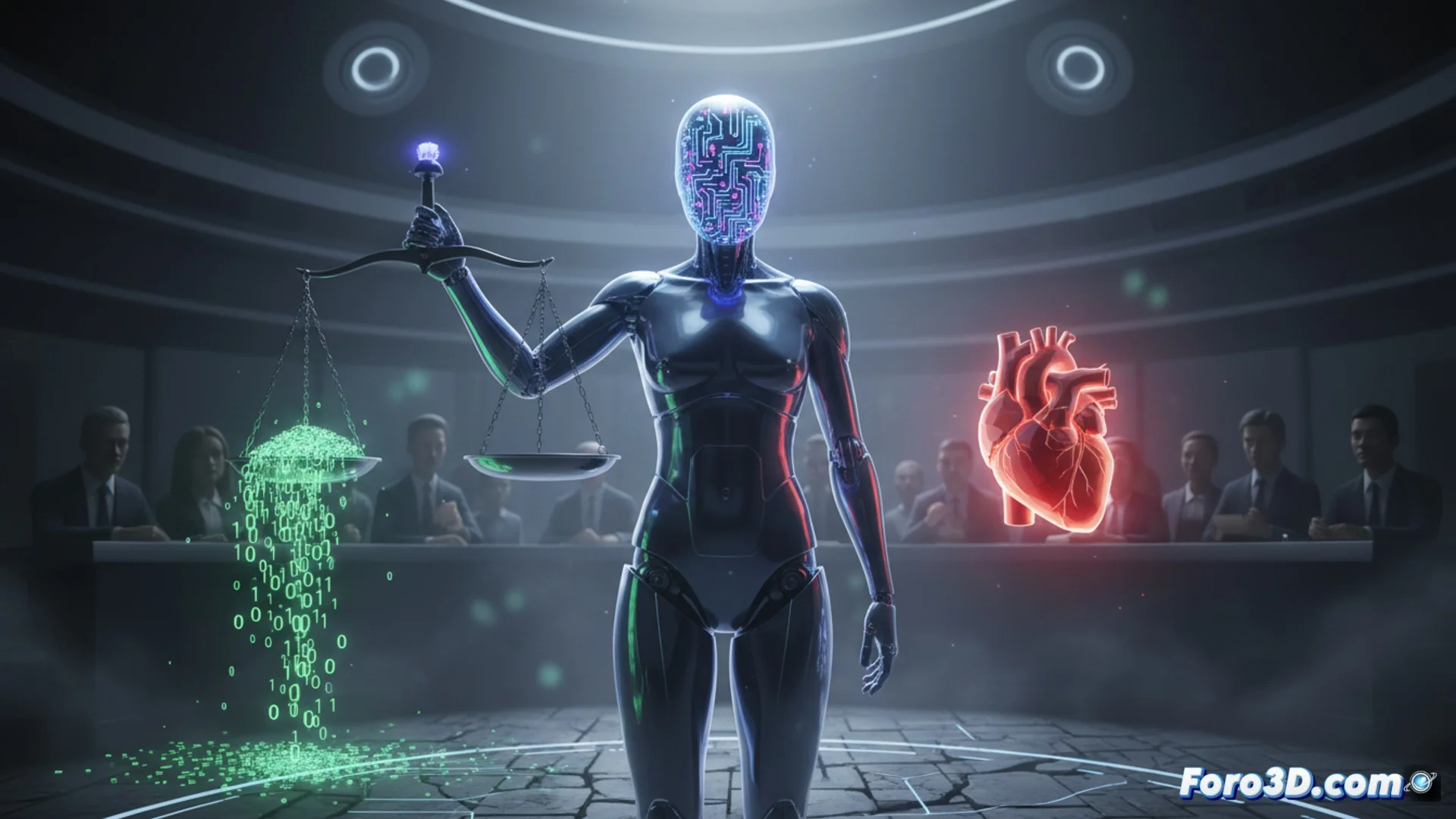

Os sistemas de inteligência artificial agora decidem em âmbitos vitais, desde conceder empréstimos até detectar doenças médicas. Isso gera um intenso debate público sobre os princípios éticos e, acima de tudo, sobre quem deve responder quando as coisas dão errado. A conversa não gira apenas em torno da máquina, mas das pessoas que a programam, alimentam com dados e a colocam em funcionamento. 🤖

O problema de fundo: os dados com preconceitos

Um algoritmo de IA só pode aprender da informação que recebe. Se os conjuntos de dados históricos incluem discriminações humanas, o sistema tenderá a replicá-las e até a potencializá-las. Isso não torna a máquina "má", mas evidencia as falhas em sua concepção. Por isso, a obrigação primária corresponde a quem seleciona a informação e estabelece as metas do modelo.

Medidas chave para mitigar riscos:- Auditar de forma constante como se coletam e processam os dados.

- Definir com clareza os objetivos que o algoritmo deve perseguir.

- Supervisionar os resultados para identificar desvios indesejados a tempo.

Pensar que um algoritmo é neutro por padrão é tão acertado quanto esperar que um manual de instruções se escreva sozinho. A objetividade é um objetivo, não um ponto de partida.

Um vazio legal a preencher

Quando uma decisão automatizada causa um dano, determinar a culpa se torna uma tarefa árdua. Deve responder o grupo que desenvolveu o código, a organização que o implementou ou o operador que o usou sem analisá-lo? Regulamentações emergentes, como o rascunho da Lei de IA da União Europeia, tentam criar marcos de responsabilidade de acordo com o nível de risco. No entanto, levar essas normas à prática em situações concretas representa um desafio jurídico monumental, dada a natureza difusa da cadeia de decisão. ⚖️

Entidades potencialmente responsáveis:- Equipes de desenvolvimento e engenheiros que criam e treinam os modelos.

- Empresas ou instituições que implantam e usam o sistema.

- Usuários finais que aplicam as recomendações do algoritmo sem critério próprio.

Conclusão: uma responsabilidade compartilhada

A discussão sobre a ética da IA transcende o técnico. Ressalta que a tecnologia é um reflexo das decisões humanas que estão por trás. Portanto, garantir que esses sistemas atuem de forma justa exige um esforço contínuo e conjunto: desde auditar os dados de entrada até definir marcos legais claros. A responsabilidade não é um atributo do software, mas um dever de quem o projeta, governa e utiliza.