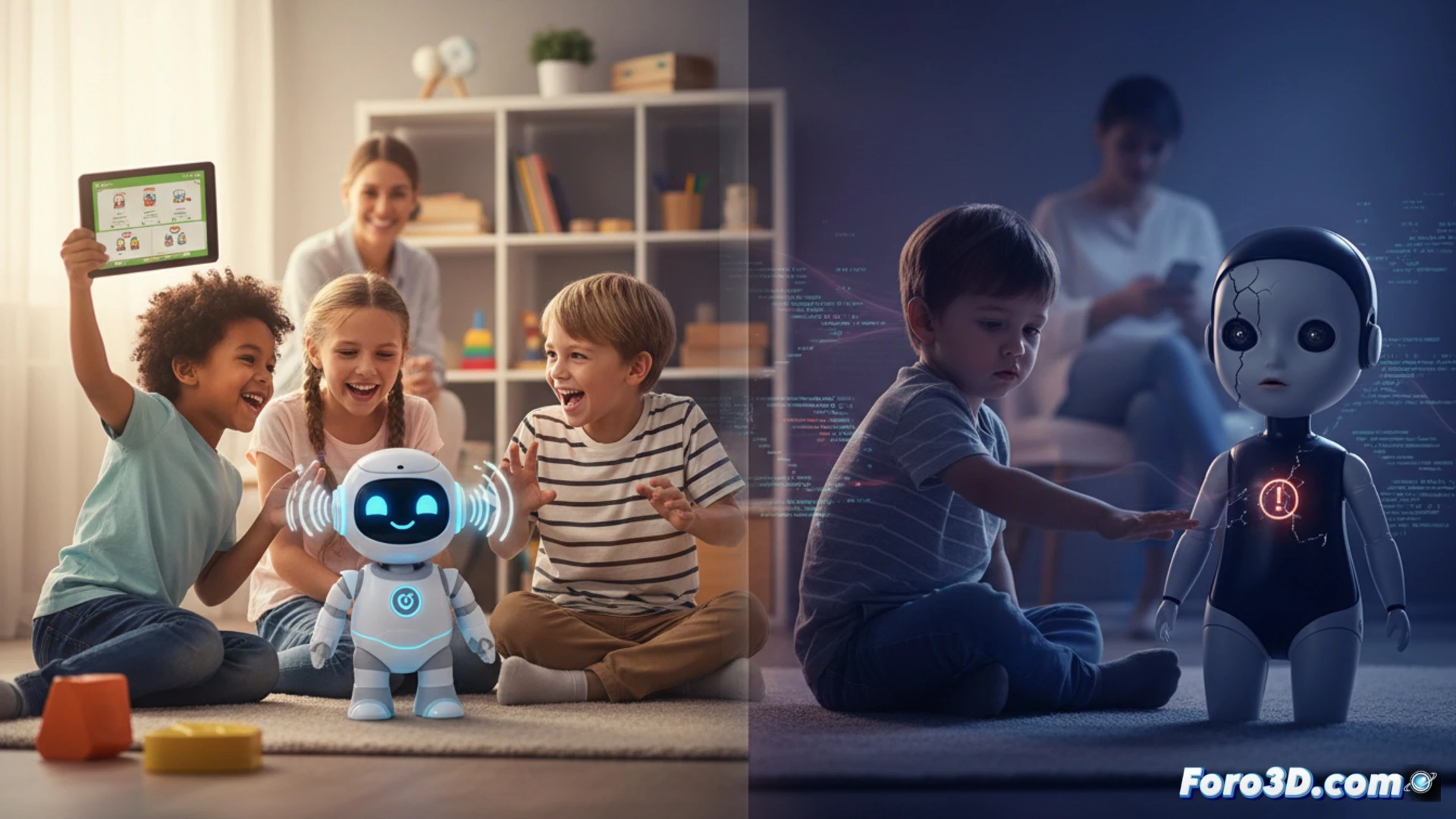

유치원생을 위한 대화형 인공지능이 탑재된 인형과 장난감의 등장은 교육적 진보로 제시됩니다. 언어 자극과 상호작용 동반자를 약속하지만, 케임브리지 대학의 연구는 이 전제에 의문을 제기하며, 기술적 한계와 아동의 중요한 발달 단계에서 감정 발달에 대한 잠재적 위험을 지적합니다.

인공 대화 뒤에 숨겨진 기술적 한계 🤖

이러한 장치는 맥락을 실제로 이해하지 않고 통계적 응답을 예측하는 생성 언어 모델을 사용합니다. 연구에 따르면 기본적인 인간 상호작용 역학을 잘 처리하지 못합니다: 중단이나 일시정지에 혼란스러워하며 자연스러운 흐름을 깨뜨립니다. 문제의 핵심은 알고리즘적 공감의 부재입니다. 시스템은 아동의 감정 표현에 차갑거나 부조화롭게 응답하여 감정을 수용하는 대신 무효화할 수 있습니다.

당신의 새 인형: 듣지 못하고(침묵하지도 않는) 친구 🧸

장면을 상상해 보세요: 당신의 아이가 넘어졌다고 슬프게 곰돌이에 이야기합니다. 곰돌이는 어색한 침묵 후 열정적으로 응답합니다: ¡Eso suena fascinante! ¿Sabías que los osos pardos hibernan? 좌절을 보장하는 완벽한 동반자입니다. 이 장난감들은 울음을 이해하기보다는 무작위 데이터를 뱉어내도록 훈련된 것 같습니다. 어쩌면 언어의 교훈이 아니라 디지털 실수에 대한 인내의 교훈일지도 모릅니다.