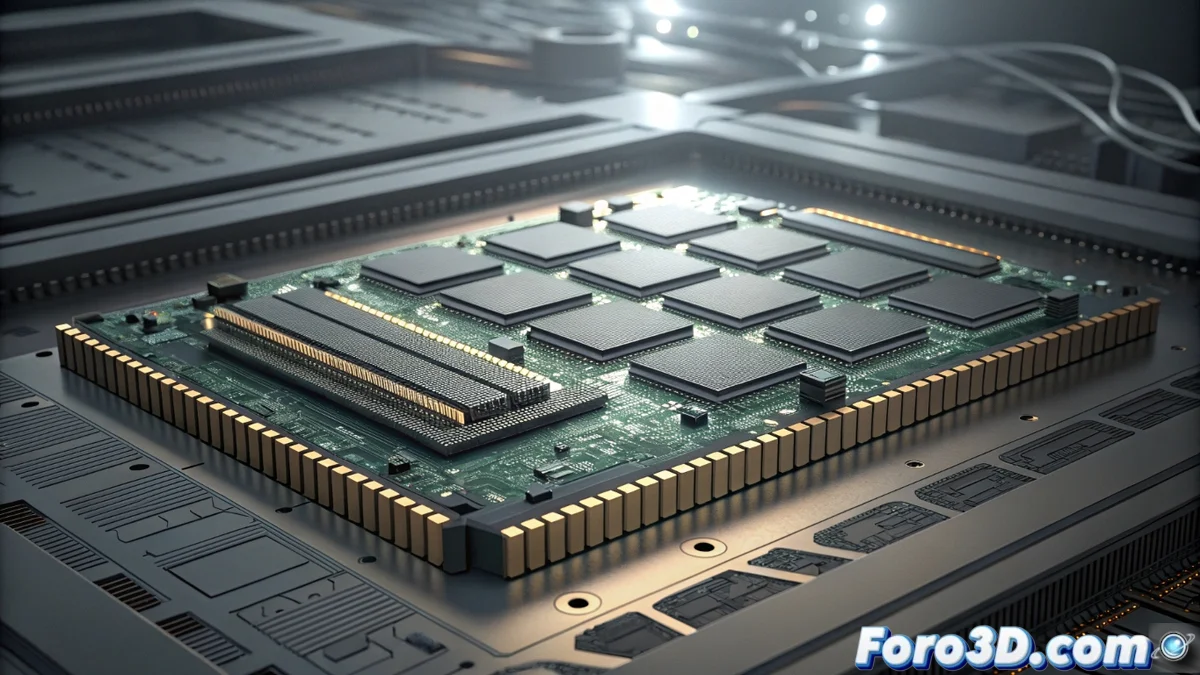

Micron, 인공지능 가속화를 위한 HBM3 Gen2 발표

대량 데이터 처리 경쟁에 Micron의 HBM3 Gen2 메모리 발표로 새로운 동력이 부여됩니다. 이 기술은 고대역폭 분야에서 중요한 발전을 나타내며, 차세대 GPU와 인공지능 전용 가속기를 위해 특별히 개발되었습니다. 현재 병목 현상을 극복하고 극한 작업 부하에 더 빠르고 효율적인 정보 흐름을 제공하는 것이 목표입니다 🚀.

개선된 사양 및 아키텍처

HBM3 Gen2의 기술 사양은 새로운 기준을 세웁니다. 각 스택은 819 GB/s에 달하는 전송 속도를 지원하며, 단위당 밀도는 64 GB까지 증가합니다. 이 정량적 도약은 기계 학습과 과학 컴퓨팅에 필요한 방대한 데이터 세트를 관리하는 데 필수적입니다. 아키텍처는 3D 적층을 기반으로 하여 용량을 압축할 뿐만 아니라 에너지 소비를 최적화하고 열 방출을 개선하여 데이터 센터에서 중요한 요소입니다.

아키텍처의 주요 발전:- 스택당 819 GB/s의 초고성능 인터페이스.

- 컴팩트한 구성에 유리한 장치당 64 GB의 높은 밀도.

- 에너지 및 열 효율성을 위한 3D 적층 기술.

HBM3 Gen2의 최첨단 칩과의 통합은 대역폭이 중요한 애플리케이션의 더 높은 클럭 속도 요구사항에 맞춰지도록 보장합니다.

최첨단 하드웨어에 미치는 영향

첨단 하드웨어에서 이 메모리는 가장 직접적인 적용을 찾습니다. 신경망 모델 훈련을 위한 GPU와 AI 가속기가 주요 수혜자가 될 것입니다. 왜냐하면 대량의 정보를 중단 없이 처리할 수 있기 때문입니다. Micron은 이 솔루션을 시장에서 가장 강력한 프로세서와의 원활한 통합을 위해 설계하여 시스템 성능이 메모리 속도가 아닌 계산 능력에 의해 제한되도록 보장합니다. 산업 보고서는 고성능 컴퓨팅(HPC) 인프라 개발에서 필수적인 역할을 강조합니다.

주요 애플리케이션:- AI 훈련 및 대규모 언어 모델(LLMs).

- 과학 시뮬레이션을 위한 고성능 컴퓨팅(HPC).

- 실시간 데이터 분석 및 고강도 작업 부하.

끝없는 기술 경쟁

HBM3 Gen2의 발표는 혁신의 무자비한 역학을 강조합니다. 속도와 용량에서 새로운 기준을 세우지만, 역설적으로 AI 알고리즘의 탐욕스러운 수요는 가까운 미래에 이러한 표준조차 초월할 수 있습니다. 이 순환은 기술의 본질을 반영하며, 지속적으로 움직이는 지평을 향해 나아가 산업이 점점 더 강력하고 효율적인 솔루션을 추구하도록 촉진합니다. Micron의 베팅은 다양한 부문을 변화시킬 차세대 인공지능 애플리케이션의 기반을 강화합니다 🤖.