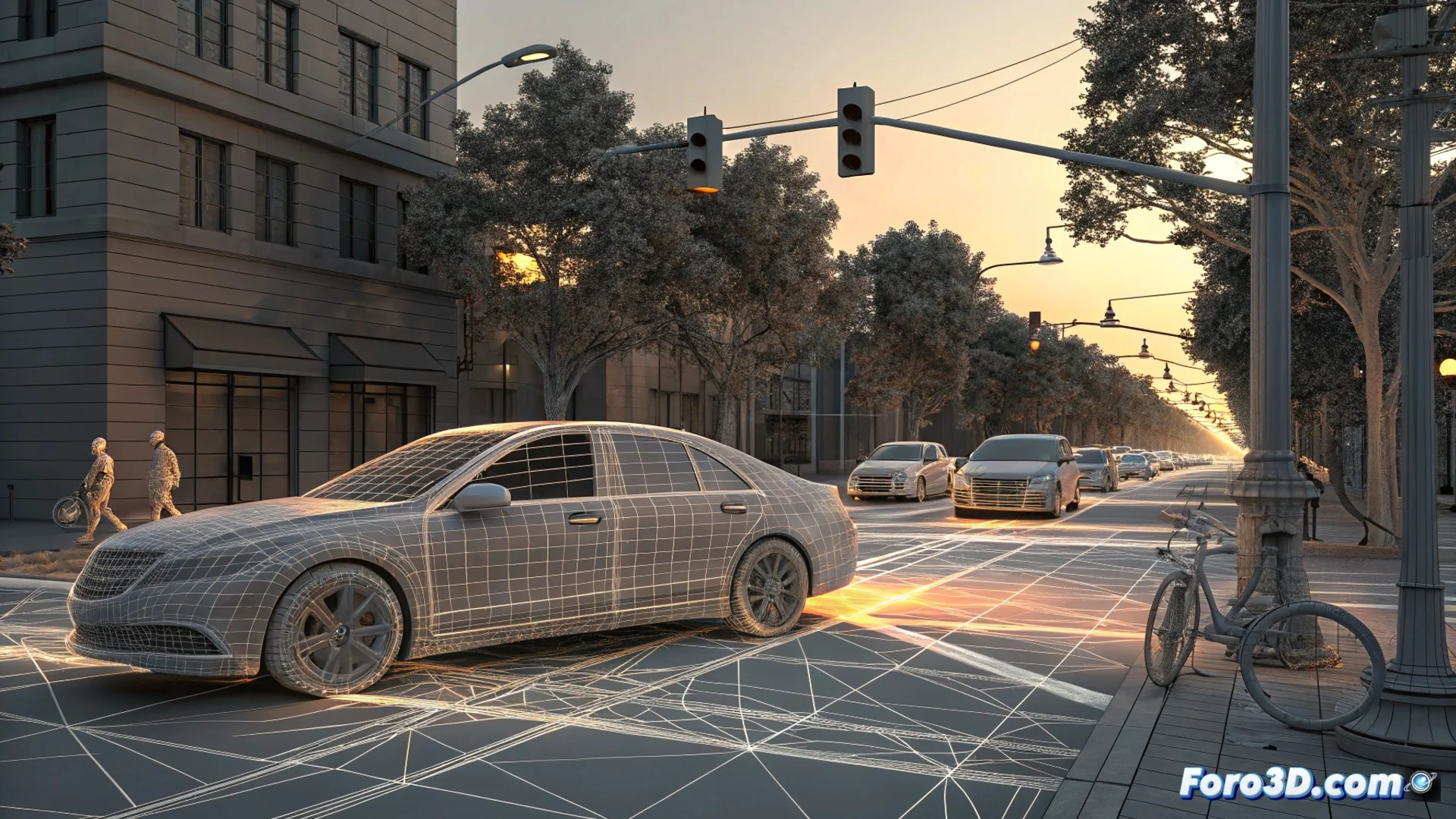

자율주행 차량 사고 재구성은 3D 환경 모델링을 요구합니다

자율주행 차량이 사고에 연루되면, 조사관들은 단순히 녹화 영상을 검토하지 않습니다. 그들의 핵심 업무는 물리적 세계를 디지털로 정확하게 재현하는 것입니다. 이 3차원 법의학적 재구성은 실제로 무슨 일이 일어났는지 이해하는 초석입니다. 🕵️♂️

LIDAR 점 구름: 실제 세계의 디지털 몰드

이 과정은 차량의 LIDAR 센서가 캡처한 데이터로 시작됩니다. 이러한 장치는 빠른 레이저 빛 펄스를 방출하고 반사되는 데 걸리는 시간을 계산합니다. 결과는 거대한 세부적인 3D 점 구름으로, 공간을 정의합니다. 각 점은 정확한 좌표를 나타내며, 아스팔트와 교통 신호부터 다른 차량과 사람들까지 매핑합니다. 이 데이터 컬렉션은 필수적인 원시 재료입니다; 이를 없이는 후속 분석이 객관적 기반을 잃습니다.

점 구름이 캡처하는 주요 요소:- 도로 기하학: 곡선, 경사, 차선 및 도로 가장자리.

- 정적 객체: 기둥, 신호등, 장벽 및 인근 건물.

- 동적 요소: 사건 순간 다른 차량, 자전거 타는 사람 또는 보행자의 위치, 형태 및 움직임.

핵심은 3D 모델이 추측이나 사실을 왜곡하는 보간 없이 정확한 복제본이 되어야 한다는 것입니다.

자율 시스템의 인식 및 결정 시뮬레이션

환경이 이미 모델링되면, 전문가들은 재현할 수 있습니다. 원시 점 구름을 차량 제어 장치의 소프트웨어가 다시 해석할 수 있는 가상 환경으로 변환합니다. 이 시뮬레이션에서 모든 조건을 복제합니다: 가시성, 각 객체의 정확한 위치 및 모든 센서 데이터(LIDAR만이 아님). 목표는 명확합니다: 시스템이 본 것을 보고 왜 그렇게 행동했는지 이해하는 것입니다. 장애물을 어떻게 분류했는지, 궤적을 올바르게 예측했는지, 회피 기동을 실행하거나 하지 않은 논리를 분석합니다.

시뮬레이션 분석 단계:- 해석 가능한 환경 재현: 원시 데이터를 주행 알고리즘이 처리할 수 있는 3D 메쉬 또는 가상 장면으로 변환.

- 이벤트 시퀀스 재현: 원본 차량과 동일한 시간 및 센서 매개변수로 시뮬레이션 실행.

- 분리