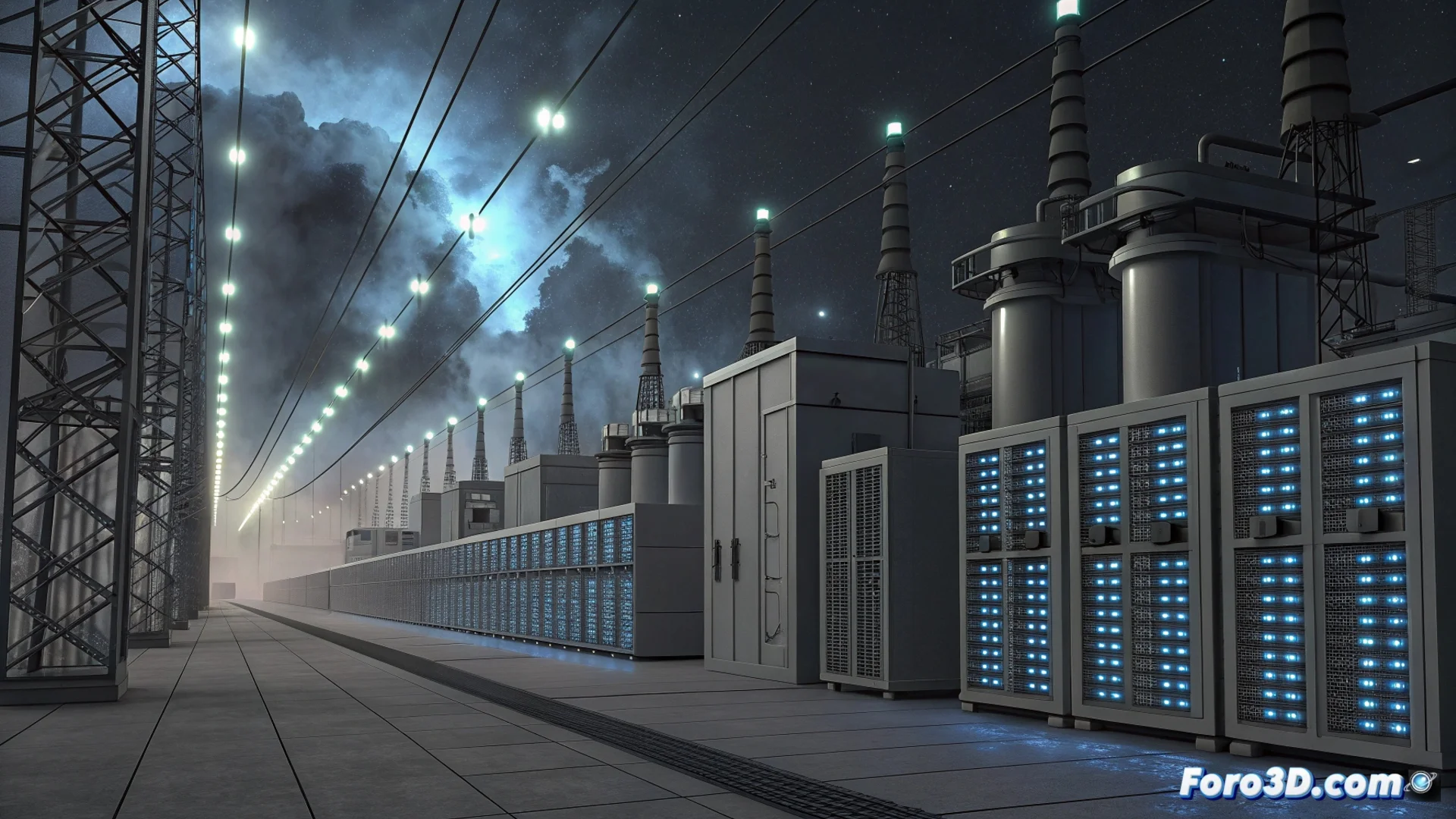

AI 데이터 센터의 에너지 수요가 계속 증가하고 있습니다

인공 지능을 위한 전문화된 인프라 구축 경쟁이 멈추지 않고 계속되고 있습니다. 이러한 지속적인 확장은 전력 공급 네트워크에 점점 더 큰 압력을 가하고 있으며, 이는 특히 미국에서 두드러집니다. 최근 분석이 구체적인 수치로 이 영향을 정량화하며, 에너지 소비가 배가되는 미래를 예측합니다. ⚡

미래 소비에 대한 구체적인 전망

12월에 발표된 BloombergNEF 보고서는 지금까지 가장 상세한 추정치 중 하나를 제공합니다. 이 연구는 이러한 데이터 센터의 에너지 수요가 2035년까지 106기가와트에 이를 수 있다고 전망합니다. 이 수치는 현재 용량에 비해 매우 큰 증가를 나타내며, 고급 AI 모델을 훈련하고 실행하는 데 필요한 에너지 집약성을 강조합니다. 이는 수천만 가구에 전기를 공급하는 것과 맞먹습니다.

이 소비를 촉진하는 주요 요인:- 대형 언어 모델 및 기타 복잡한 AI 애플리케이션을 개발하고 훈련하려는 경쟁.

- 연속적으로 대량의 데이터를 처리할 필요성.

- 고성능 서버 냉각의 핵심 요구사항으로, 전체 소비를 더욱 악화시킵니다.

AI 인프라의 기하급수적 성장은 전력 수요의 병행 증가와 직접적으로 연결되어 있습니다.

지속 가능한 개발을 위한 전략

이 시나리오는 기술 산업과 규제 당국이 혁신과 지속 가능성을 균형 있게 맞추는 솔루션을 찾도록 강요합니다. 영향을 완화하고 네트워크 과부하를 피하기 위한 다양한 경로가 적극적으로 탐구되고 있습니다.

개발 중인 솔루션:- AI용 칩과 프로세서의 효율성 향상.

- 더 발전된 그리고 소비가 적은 냉각 시스템 구현.

- 태양광이나 풍력과 같은 재생 에너지원을 운영에 직접 통합.

에너지의 재귀적 미래

일부 기업은 이미 더 녹색 공급을 보장하기 위해 태양광 또는 풍력 공원 근처에 데이터 센터를 건설할 계획입니다. 일부는 환경 영향에 대한 우려를 표명하는 반면, 다른 일부는 인공 지능 자체가 자신의 에너지 소비를 최적화할 수 있는 미래를 상상하며, AI가 AI에 필요한 에너지를 관리하는 재귀적 순환을 만듭니다. 최종 목표는 명확합니다: 전력 네트워크의 안정성을 해치지 않으면서 혁신 속도를 유지하는 것입니다. 🔄