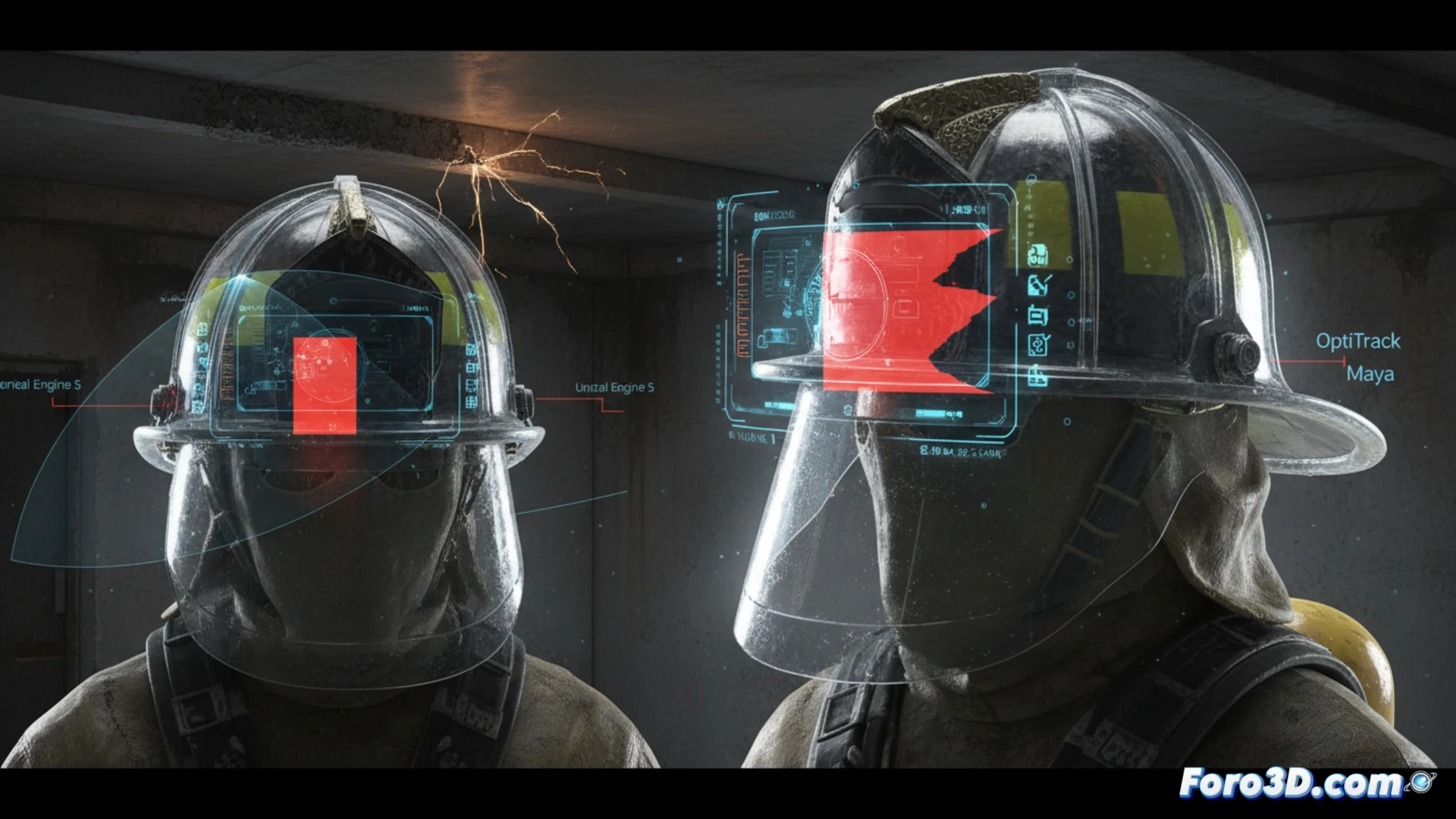

救助訓練中の最近の事故により、過酷な環境における拡張現実インターフェースの安全性が厳しく問われています。ARディスプレイ付きヘルメットを装着した消防士が、自身のHUDが周辺視野に隠していた障害物を認識できませんでした。OptiTrackのモーションキャプチャデータを用いたUnreal Engine 5での事故の再現により、重要なステータスパネルが危険が発生したエリアを正確に遮っていたことが明らかになりました。

障害の3D再現:法医学的ツールとしてのUnreal Engine 5とOptiTrack 🛠️

問題の重大性を示すため、Mayaでシーンをモデリングし、Unreal Engine 5にインポートしました。OptiTrackのデータを使用して、事故発生時の消防士の頭部とヘルメットの位置を正確に再現しました。結果はぞっとするものでした。右上隅に静的に配置されるように設計された温度と圧力のオーバーレイが、ユーザーが梁を点検するために頭を回した際に、視野の35%を占拠していました。シミュレーションにより、衝突の直前、ARインターフェースがデジタルブラインドのように機能し、距離を評価するために必要な視覚情報を排除していたことが実証されました。

適応型デザインへ:透明性と動的再配置 💡

解決策は情報を排除することではなく、その空間的階層を管理することです。私は3つの実現可能な改善を提案します。ユーザーが要素を注視した場合にのみ不透明度を高める適応型透明度、頭部の素早い動きが検出された際にパネルをビューポートの極端な端に移動させる動的再配置、そして実際の障害物の半透明な輪郭をHUD上に投影する閉塞警告システムです。OptiTrackとMayaで検証可能なこれらの変更は、危険なHUDを、決して危険から目をそらさせないアシスタントに変える可能性があります。

HUDの視覚閉塞が原因で失敗した救助訓練の事故を考慮すると、重要な情報が環境内の実際の危険を覆い隠さないようにするために、設計プロトコルはどのように再考されるべきでしょうか?

(追記:メンテナンスに適用されるARは、機械が爆発する前に故障箇所を確認することを可能にします。)