重要インフラにおけるAIシステムは認証を必要とする

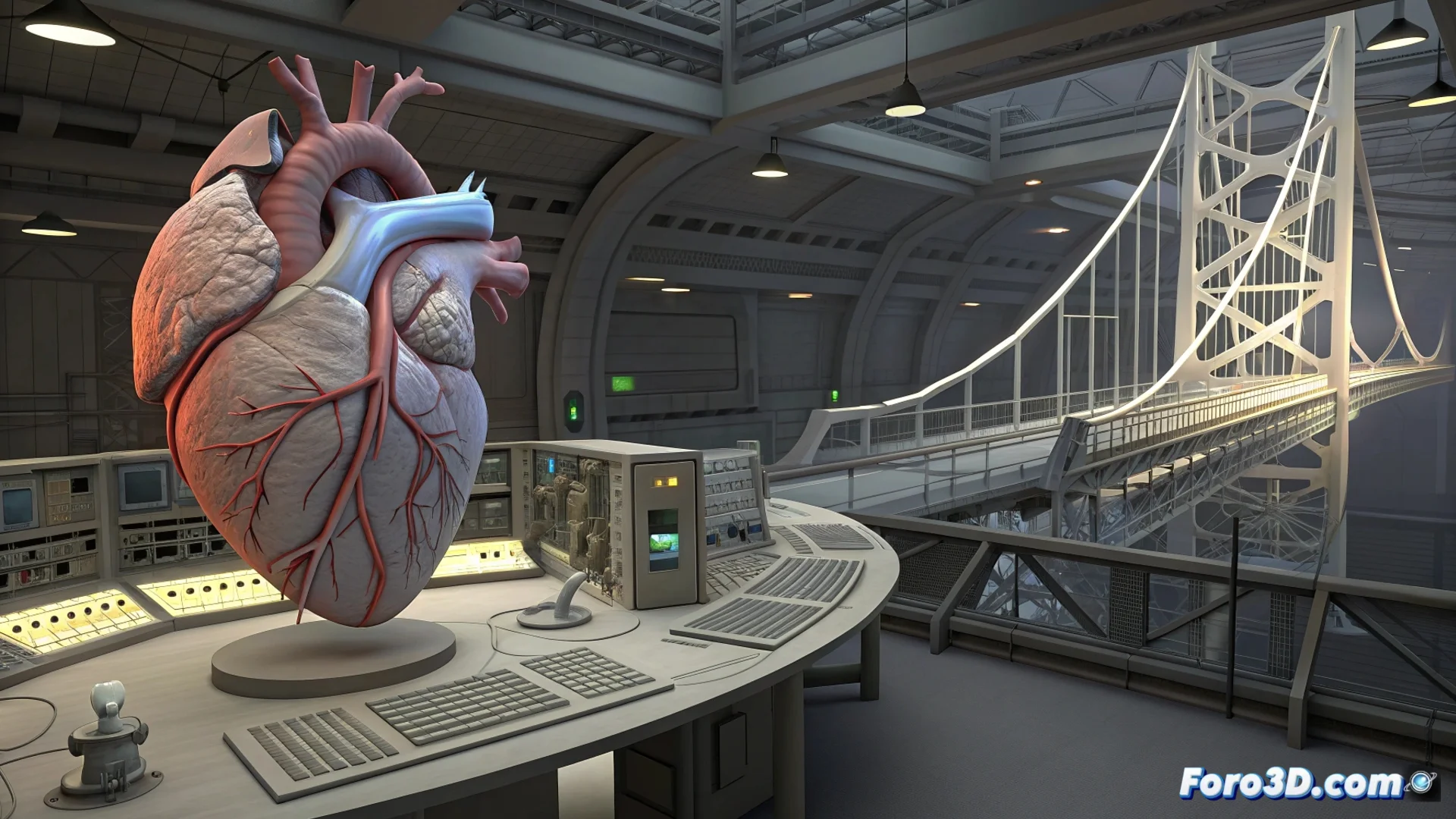

誤りが人命を危険にさらしたり、物的惨事を引き起こしたりする可能性のある分野で人工知能を実装することは、簡単な作業ではありません。🛡️ 規制機関は、土木構造物をモデル化したり複雑な手術を計画したりするようなシステムに対して、使用前に例外的な信頼性を示すことを要求しています。この正式な審査、すなわち認証は、高リスク分野でプロトタイプと運用ツールを分ける障壁です。

システムが堅牢で安全であることを検証するプロセス

認証の核心は、AIアルゴリズムを包括的かつしばしば敵対的な一連のテストにさらすことにあります。評価者は通常の条件下での動作だけでなく、積極的に失敗させることを試みます。破損したデータを導入し、サイバー攻撃をシミュレートし、論理の限界を探って弱点を見つけます。建物の応力計算や薬物の体内挙動を計算するソフトウェアにとって、誤った結果は許容できません。そのため、テストは現実で起こり得る極端なシナリオを再現し、システムが常に予測可能で制御された方法で動作することを保証します。

検査される主要領域:- エラーや攻撃に対する耐性:システムが誤った情報や悪意ある情報を受け取った場合の反応。

- 決定の説明可能性:AIが特定の結論に至った理由を理解し正当化する能力。これはその作業を監査するために重要です。

- バイアスの検出と修正:アルゴリズムに存在する偏見を特定し、差別的な結果や技術的に危険な結果を引き起こす可能性を分析。

最終認証は単なる印ではなく、システムが人命と財産を保護するためにすべての技術的・法的要件を満たしていることを確認するものです。

法規制は技術進歩のペースに適応する

認証を取得することは一回限りのイベントではなく、継続的なコミットメントの始まりです。基準と規制はAI技術自体と同じくらい速く進化します。これにより、開発者は展開後のシステムのパフォーマンスを監視し、脆弱性を修正したり動作を改善したりするパッチや更新を適用する準備をしなければなりません。このプロセスの基本的な柱は絶対的なトレーサビリティです:AIが取るすべての論理的ステップと決定を追跡・監査できるようにし、しばしば特別なソフトウェアアーキテクチャを要求します。