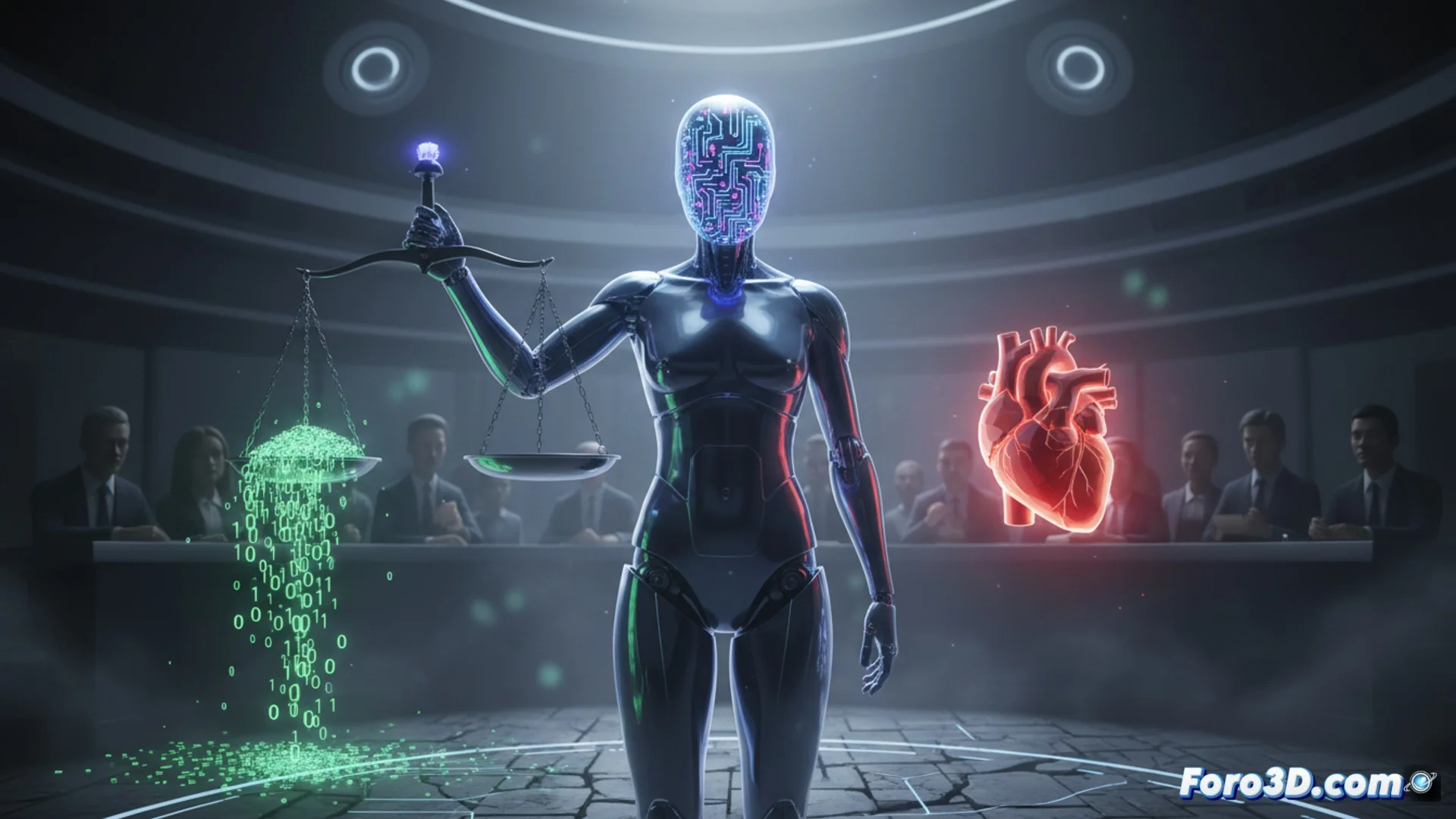

人工知能システムにおける倫理と責任

人工知能システムは現在、融資の承認から医療疾患の検出まで、重要な分野で決定を下しています。これにより、倫理的原則に関する激しい公の議論が生まれ、特に問題が発生した場合に誰が責任を負うべきかについての議論が起こっています。この会話は機械だけに焦点を当てるのではなく、それをプログラミングし、データで訓練し、運用する人々に焦点を当てています。🤖

根本的な問題:偏見のあるデータ

AIアルゴリズムは受け取った情報からしか学習できません。歴史的なデータセットに人間の差別が含まれている場合、システムはその差別を再現し、さらには強化する傾向があります。これは機械を「悪」とするものではなく、その設計の欠陥を示すものです。そのため、一次的な義務は情報を選択し、モデルの目標を設定する人々にあります。

リスクを軽減するための主要な対策:- データの収集と処理方法を継続的に監査する。

- アルゴリズムが追求すべき目標を明確に定義する。

- 結果を監督し、望ましくない逸脱をタイムリーに特定する。

アルゴリズムがデフォルトで中立的だと考えるのは、取扱説明書が勝手に書かれるのを期待するのと同じくらい正しくありません。客観性は目標であり、起点ではありません。

埋めるべき法的空白

自動化された決定が損害を引き起こした場合、責任を特定するのは困難な作業になります。コードを開発したチーム、システムを実装した組織、それとも分析せずに使用したオペレーターが責任を負うべきでしょうか?欧州連合のAI法草案などの新興規制は、リスクレベルに応じた責任の枠組みを作成しようとしています。しかし、決定のチェーンが曖昧な性質を考慮すると、これらの規範を具体的な状況で実践するのは巨大な法的課題です。⚖️

潜在的な責任主体:- モデルを作成し訓練する開発チームとエンジニア。

- システムを展開し使用する企業や機関。

- アルゴリズムの推奨を独自の判断なしに適用する最終ユーザー。

結論:共有された責任

AIの倫理に関する議論は技術的なものを超えています。技術は背後にある人間の決定の反映であることを強調しています。因此、これらのシステムが公正に行動することを保証するには、入力データの監査から明確な法的枠組みの定義まで、継続的かつ共同の努力が必要です。責任はソフトウェアの属性ではなく、それを設計し、管理し、使用する人々の義務です。