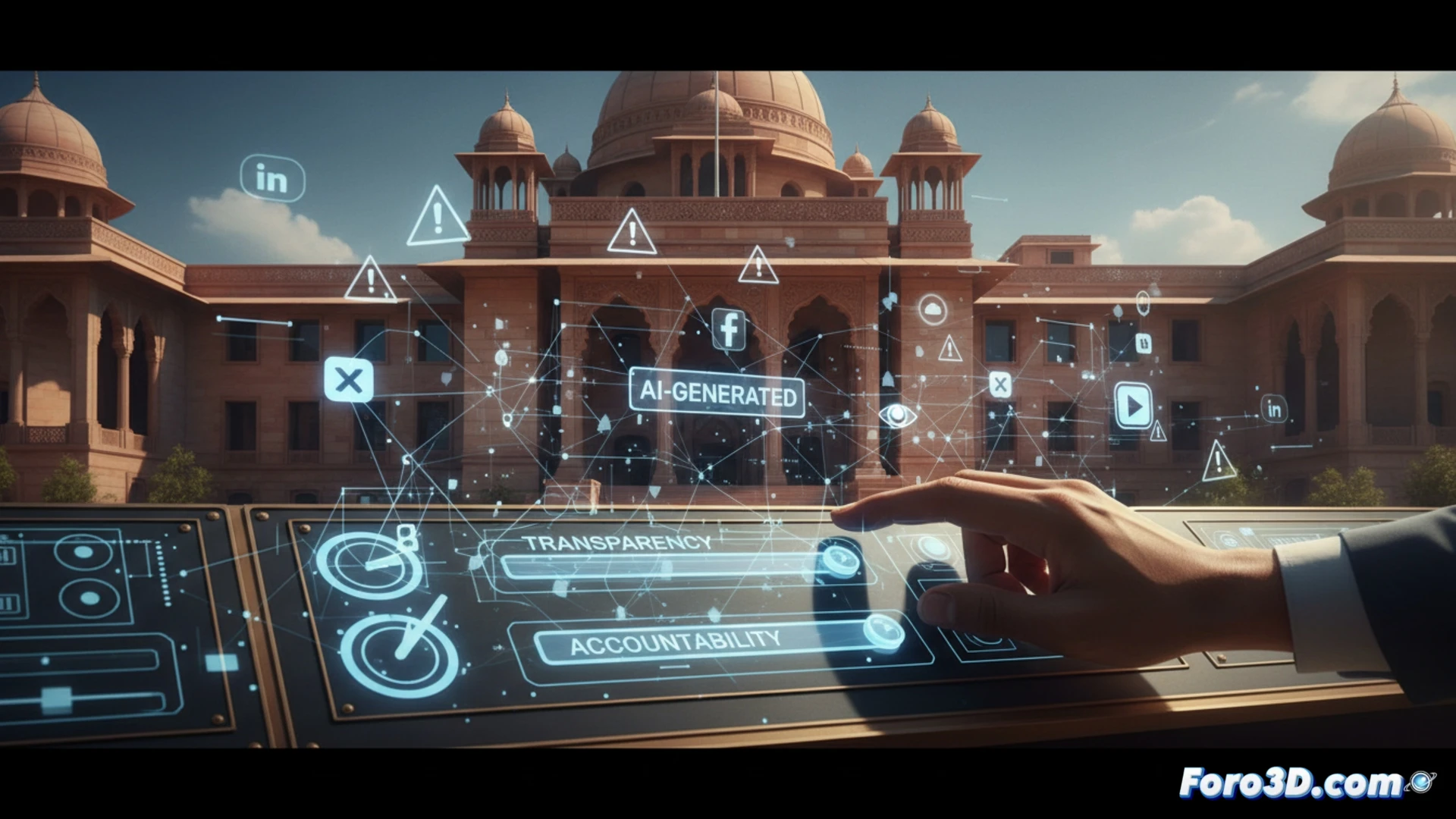

インドがソーシャルメディアにおける人工知能の規制を強化

インドの当局は、インターネット規制枠組みを修正し、主要なソーシャルメディアプラットフォームに新たな要件を課しました。主要な目的は、人工知能システムによって生成された素材をより厳格に管理することであり、偽情報の拡散に対する懸念が高まっています。🛡️

デジタルプラットフォームに対するより大きな義務

今や重要仲介者と指定された企業は、より迅速かつ透明性を持って行動する必要があります。主要なルールの1つは、合成または改変された非現実的なすべてのコンテンツを明確に識別する必要性です。また、利用者に利用ポリシーとその遵守方法を伝える必要があります。

主な要求される行動:- 公式通知後、速やかに違法素材を削除する。

- 利用者にAIシステムの制限と潜在的なエラーを通知する。

- コンテンツが自動生成されたと主張して責任を回避しない。

法的な枠組みは、人工知能の進歩に追いつこうと進化しています。

AI時代に法律を適応させる

これらの変更は、同国の情報技術法の改正により実施されます。政府は、技術革新を促進しつつ、市民を潜在的に有害なコンテンツから保護するというバランスを求めています。この規制は、コンテンツの自動生成元がホストプラットフォームの責任を免除しないことを強調しています。

新しいアプローチの結果:- 企業はコンテンツのレビューとモデレーションにさらに多くのリソースを投資する必要があります。

- 他の国々がデジタル環境でのAIを規制するための前例が確立されます。

- 法務およびコンプライアンス部門への圧力が増大します。

コンテンツモデレーションの新たな課題

機械がテキスト、画像、ビデオを説得力を持って生成する能力は、前例のない法的課題を引き起こしています。インドの新ルールは、プラットフォームがより積極的かつ予防的な役割を果たすための取り組みを表しています。メッセージは明確です:イノベーションは公共の安全と情報の本質性を損なうことはできません。⚖️