MicronがAIを加速するためのHBM3 Gen2を発表

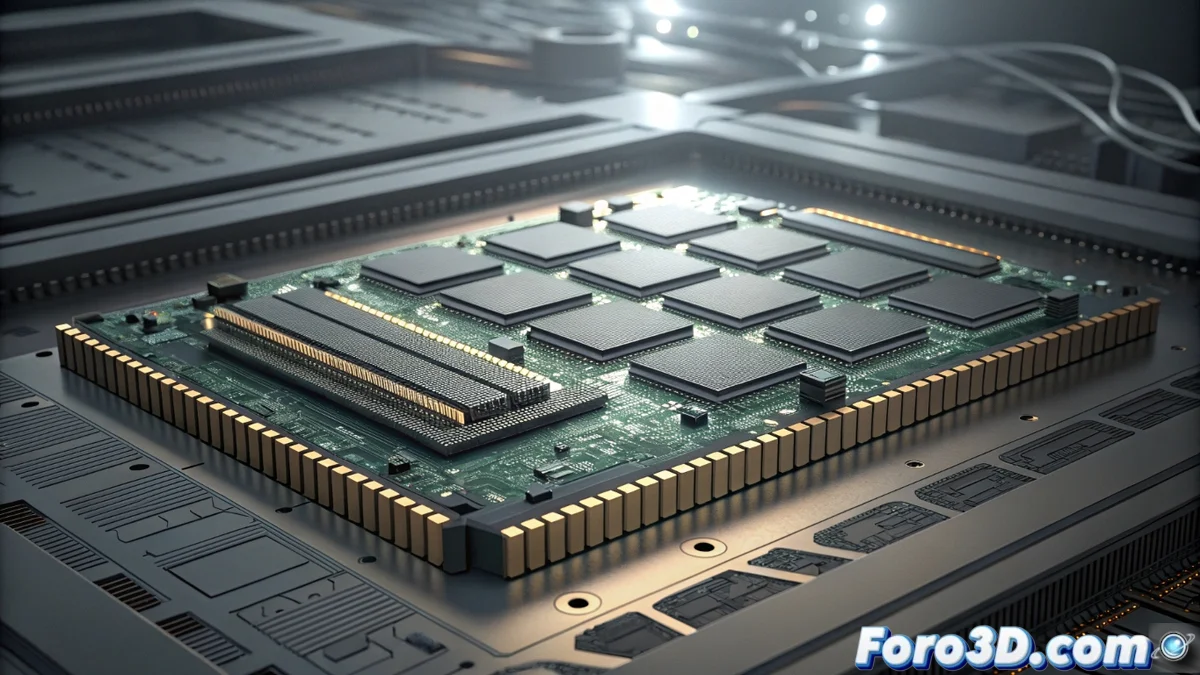

大量データ処理の競争に新たな推進力が加わった。MicronがHBM3 Gen2メモリを発表した。この技術は高帯域幅の分野で大きな進歩を表し、次の世代のGPUや人工知能専用のアクセラレータを駆動するために特別に開発された。その目標は現在のボトルネックを克服し、極端なワークロードに対してより高速で効率的な情報フローを可能にすることだ 🚀。

仕様と改良されたアーキテクチャ

HBM3 Gen2の技術仕様は新たな基準を設定する。各スタックは819 GB/sに達する転送速度をサポートし、ユニットあたりの密度は64 GBまで向上する。この量的な飛躍は機械学習と科学的計算に必要な巨大なデータセットを管理するために不可欠だ。アーキテクチャは3D積層を基盤とし、容量をコンパクトにすると同時にエネルギー消費を最適化し、熱放散を改善する。これらはデータセンターで重要な要素だ。

アーキテクチャの主な進歩:- スタックあたり819 GB/sの超高性能インターフェース。

- デバイスあたり64 GBの高密度で、コンパクトな構成を容易に。

- エネルギー効率と熱性能を向上させる3D積層技術。

HBM3 Gen2の最先端チップとの統合により、帯域幅がクリティカルアプリケーションの高クロック速度の要求に適合する。

最先端ハードウェアへの影響

先進ハードウェアでは、このメモリが最も直接的な応用を見つける。ニューラルモデルのトレーニングのためのGPUやAIアクセラレータが主な受益者で、大規模な情報量を中断なく処理できる。Micronはこのソリューションを市場で最も強力なプロセッサとのシームレスな統合のために設計し、システム性能がメモリ速度ではなく計算能力によって制限されることを保証する。業界レポートは、高性能コンピューティング(HPC)インフラの開発におけるその本質的な役割を強調している。

主なアプリケーション:- AIトレーニングおよび大規模言語モデル(LLMs)。

- 科学的シミュレーションのための高性能コンピューティング(HPC)。

- リアルタイムデータ分析および高負荷ワークロード。

終わりのない技術競争

HBM3 Gen2の発表はイノベーションの容赦ないダイナミクスを強調する。速度と容量で新たな基準を設定するものの、パラドックスは続く:AIアルゴリズムの貪欲な需要は、近い将来これらの基準さえ超える可能性がある。このサイクルは技術の本質を反映し、絶えず動く地平線に向かって進化し、業界をより強力で効率的なソリューションを求めるよう駆り立てる。Micronの賭けは、多様なセクターを変革する次の人工知能アプリケーションの波のための基盤を固める 🤖。