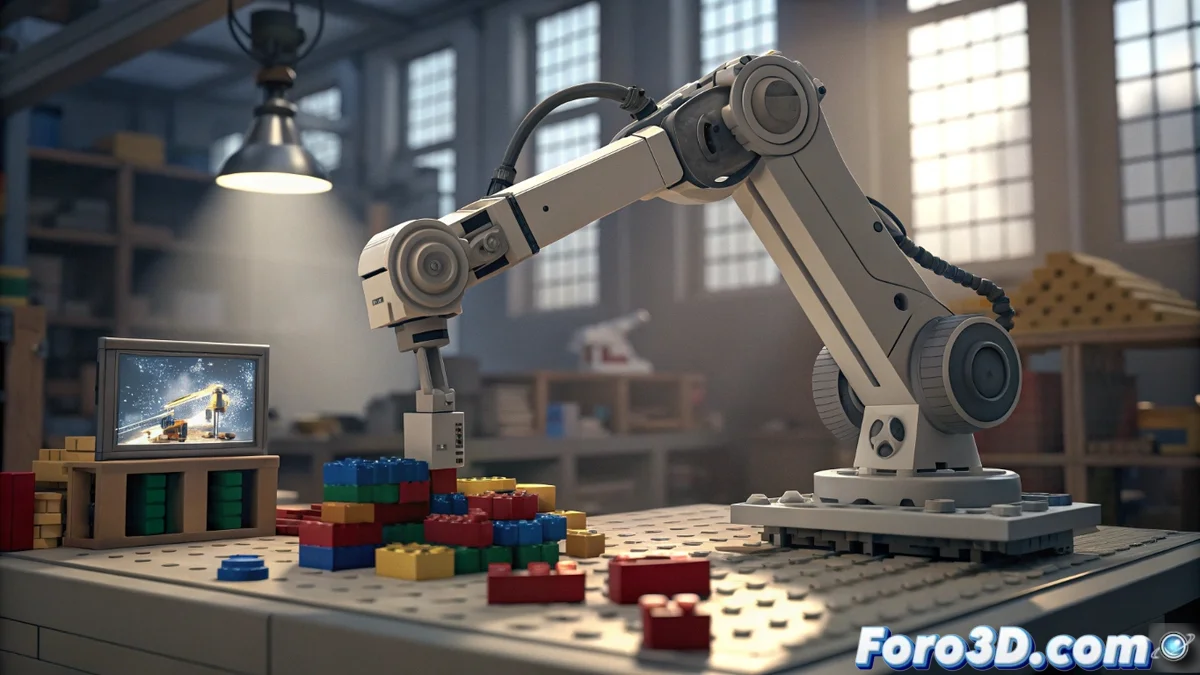

ManualVLA:マルチモーダルマニュアルでロボット計画を向上させるフレームワーク

Vision-Language-Action (VLA) モデルは汎化能力で優れていますが、明確な目標状態を要求する複雑なタスク、例えば組み立てや再配置でつまずきます。主要な課題は、高レベル計画と精密操作の調整です。これを解決するため、ManualVLAが提案されます。これは統一フレームワークで、VLAモデルが結果の何からプロセスどうを推論し、抽象的な目標を実行可能なアクションシーケンスに変換します。🤖

2つのエキスパートとガイド付き推論の建築

ManualVLAはMixture-of-Transformers (MoT)アーキテクチャに基づいています。感覚知覚を直接モーターコマンドにマッピングするのではなく、重要な中間ステップを導入します。まず、計画エキスパートが中間マルチモーダルマニュアルを生成します。これらのマニュアルは画像、空間指示、テキスト指示を統合します。次に、Manual Chain-of-Thought (ManualCoT)プロセスがこれらのマニュアルをアクションエキスパートに導きます。各マニュアルステップが明示的な制御条件を提供し、その潜在表現が精密操作のための暗黙のガイドとして機能します。

システムの主要コンポーネント:- 計画エキスパート:最終タスクを理解し実行可能なステップに分解した詳細なマニュアルを生成します。

- ManualCoT:マニュアル情報を構造化し、アクション実行エキスパートに供給する推論メカニズムです。

- アクションエキスパート:マニュアルのマルチモーダル指示を精密で協調されたロボット動作に翻訳します。

ManualVLAは、LEGO組み立てと物体再配置タスクで、従来の最良の階層モデルより平均32%高い成功率を達成します。

自動生成による訓練データの作成

計画エキスパートの訓練には大量のマニュアルデータが必要で、手動収集は非常に高コストです。この障害を克服するため、チームは3D Gaussian Splatting技術に基づくデジタルツイン・ツールキットを開発しました。このキットは高忠実度のマニュアルデータを自動生成し、人間による広範な注釈に依存せずに効率的かつスケーラブルに計画者を訓練します。

デジタルツイン・ツールキットの利点:- 複雑な計画モデルの訓練のための現実的で多様な合成データを生成します。

- 実世界データの収集に伴う負担とコストを大幅に削減します。

- 物理実行前にシミュレーション環境でマニュアルをテスト・洗練します。

示唆と将来の展望

このアプローチは、ロボットが複雑な操作タスクを計画・実行する方法を改善するだけでなく、ゼロから指示に従うプログラミングプロセスを簡素化します。最終目標と達成に必要なステップのギャップを埋めることで、ManualVLAはより自律的で有能なロボットへの大きな進歩を表します。このフレームワークは、明確な手順生成を堅牢で信頼性の高いロボット操作の中心に据えた新しいパラダイムを確立します。🧩