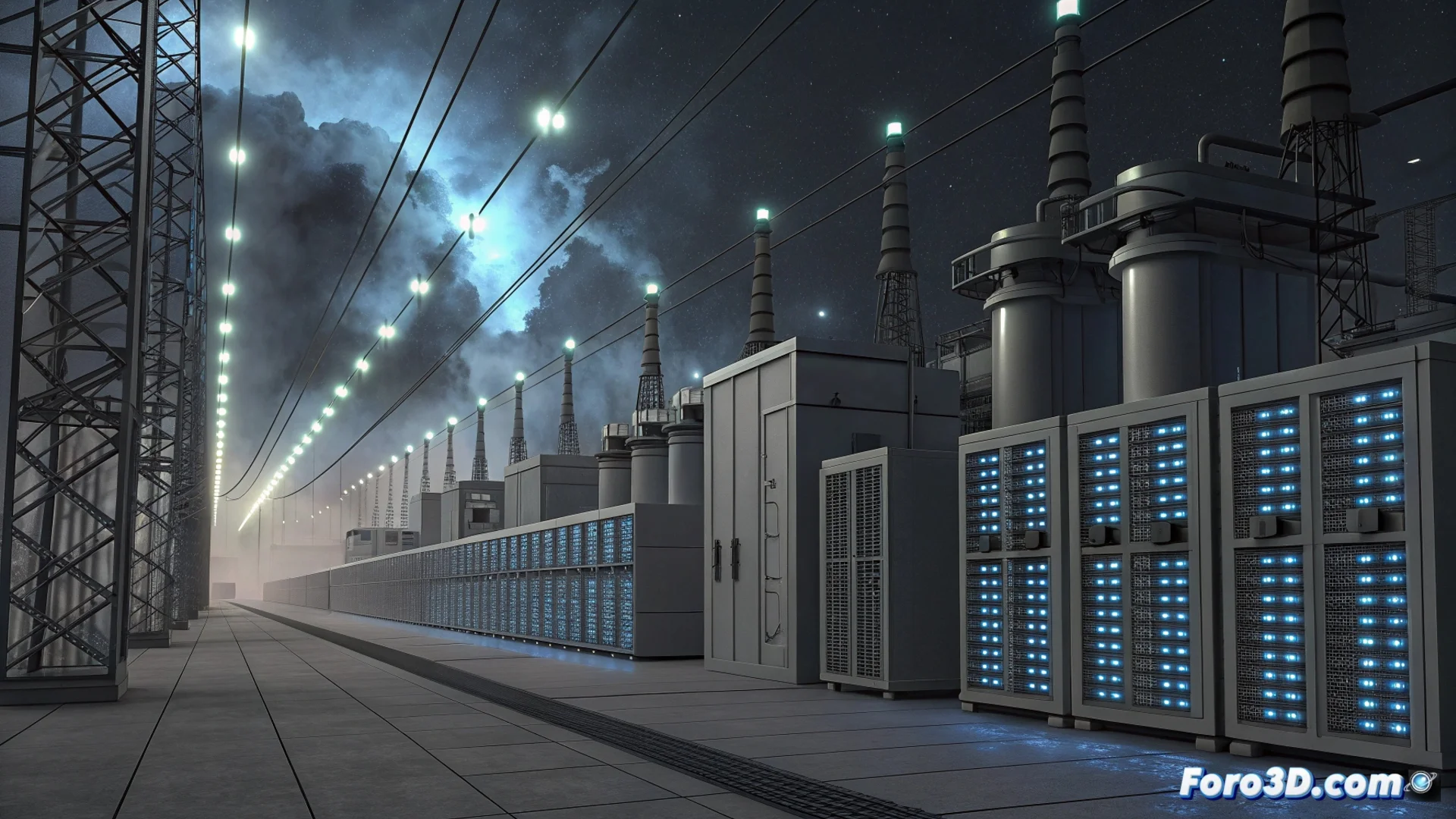

AIを搭載したデータセンターのエネルギー需要は引き続き成長

人工知能のための専用インフラ構築競争は休みなく続いている。この絶え間ない拡大は、電力供給網にますます大きな圧力をかけ、特に米国で顕著な現象となっている。最近の分析がこの影響を具体的な数字で定量化し、エネルギー消費が倍増する未来を予測している。⚡

将来の消費に関する具体的な予測

12月に公開されたBloombergNEFの報告書は、これまでで最も詳細な推定値の一つを提供している。この研究は、これらのデータセンターのエネルギー需要が2035年までに106ギガワットに達する可能性を予測している。この数字は現在の容量に比べて非常に大きな増加を示し、訓練と実行に必要な先進的なAIモデルのエネルギー集約性を強調している。これは数千万世帯への電力供給に相当する。

この消費を推進する主な要因:- 大規模言語モデルや他の複雑なAIアプリケーションの開発と訓練競争。

- 大量のデータを継続的に処理する必要性。

- 高性能サーバーの冷却という重要な要件で、総消費をさらに悪化させる。

AIインフラの指数関数的な成長は、電力需要の並行した増加に直接結びついている。

持続可能な開発のための戦略

このシナリオは、技術業界と規制当局にイノベーションと持続可能性を均衡させる解決策を求めることを強いる。影響を緩和し、グリッドの過負荷を避けるためのさまざまな手段が積極的に探求されている。

開発中の解決策:- AI向けチップとプロセッサの効率向上。

- より高度で低消費の冷却システムの実施。

- 太陽光や風力などの再生可能エネルギー源を運用に直接統合。

エネルギーの再帰的な未来

一部の企業はすでに、太陽光や風力発電所近くにデータセンターを建設する計画を立て、よりグリーンな供給を保証している。環境影響への懸念を表明する声がある一方で、他者は人工知能自体がそのエネルギー消費を最適化する未来を想像しており、AIがAIが必要とするエネルギーを管理する再帰的なサイクルを生み出す。最終目標は明確だ:電力網の安定性を損なうことなく、イノベーションのペースを維持すること。🔄