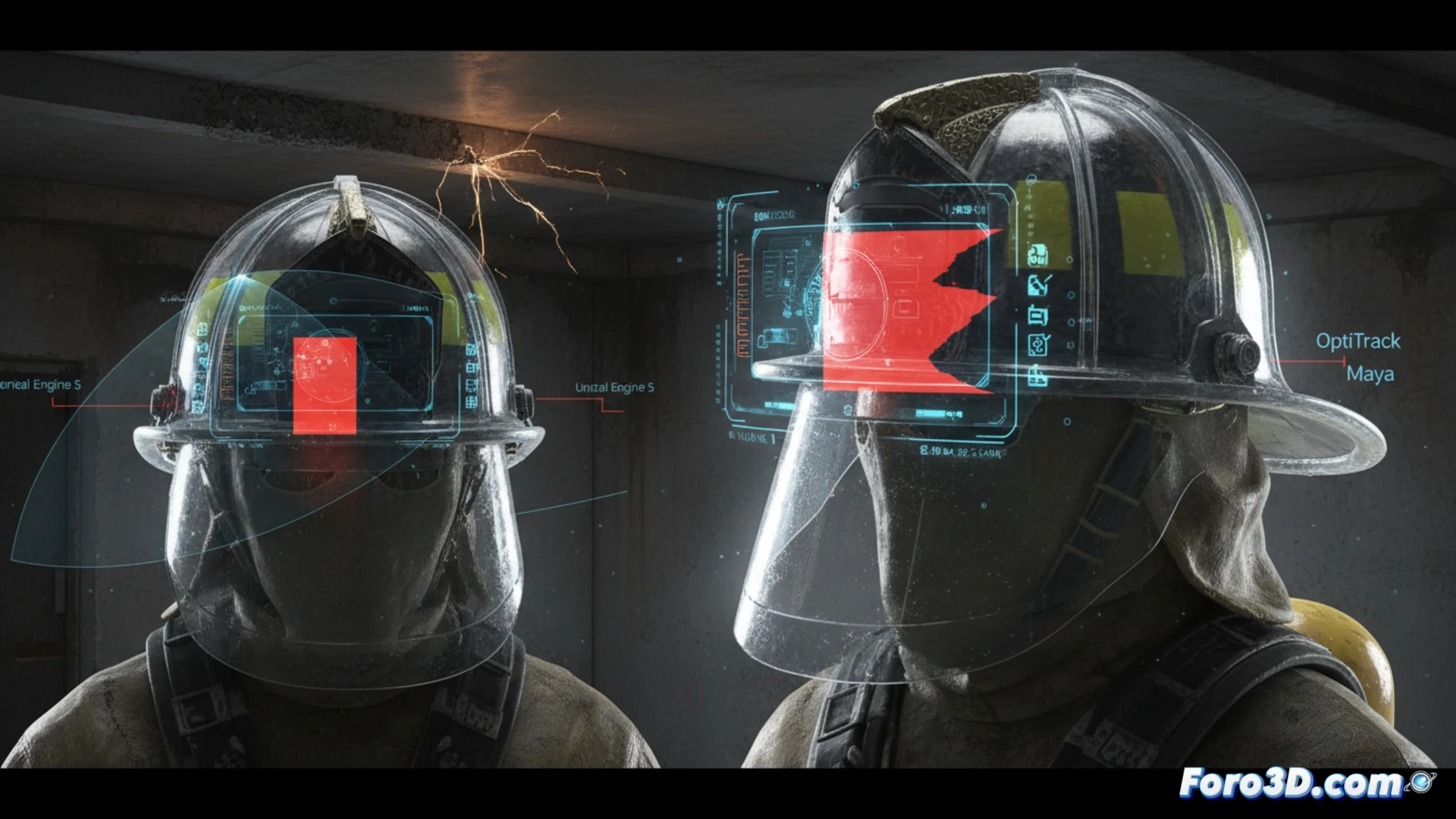

Un recente incidente in un simulacro di salvataggio ha messo sotto la lente d'ingrandimento la sicurezza delle interfacce di Realtà Aumentata in ambienti ostili. Un vigile del fuoco, equipaggiato con un casco con display AR, non ha rilevato un ostacolo che il suo stesso HUD nascondeva nella sua periferia. La ricostruzione dell'incidente in Unreal Engine 5, con dati di motion capture di OptiTrack, ha rivelato che un pannello di stato critico ha bloccato esattamente l'area in cui si verificava il pericolo.

Ricostruzione 3D del guasto: Unreal Engine 5 e OptiTrack come strumenti forensi 🛠️

Per dimostrare la portata del problema, abbiamo modellato la scena in Maya e l'abbiamo importata in Unreal Engine 5. Abbiamo utilizzato i dati di OptiTrack per replicare con precisione la posizione della testa e del casco del vigile del fuoco durante l'incidente. Il risultato è stato agghiacciante: l'overlay di temperatura e pressione, progettato per essere statico nell'angolo superiore destro, invadeva il 35% del campo visivo quando l'utente girava la testa per ispezionare una trave. La simulazione ha dimostrato che, nella frazione di secondo precedente all'impatto, l'interfaccia AR ha agito come una persiana digitale, eliminando le informazioni visive necessarie per valutare la distanza.

Verso un design adattivo: trasparenza e riposizionamento dinamico 💡

La soluzione non è eliminare le informazioni, ma gestire la loro gerarchia spaziale. Propongo tre migliorie praticabili: trasparenza adattiva che aumenta l'opacità solo quando l'utente fissa lo sguardo sull'elemento, riposizionamento dinamico che sposta i pannelli verso i bordi estremi del visore quando viene rilevato un movimento rapido della testa, e un sistema di allerta di occlusione che proietti un contorno semitrasparente dell'ostacolo reale sull'HUD. Questi cambiamenti, validabili con OptiTrack e Maya, potrebbero trasformare un HUD pericoloso in un assistente che non ruba mai la vista dal pericolo.

Considerando l'incidente nel simulacro di salvataggio, dove l'occlusione visiva dell'HUD ha fallito, come dovrebbero essere ripensati i protocolli di progettazione per garantire che le informazioni critiche non oscurino i pericoli reali dell'ambiente?

(PS: La RA applicata alla manutenzione ti permette di vedere dove si trova il guasto... prima che la macchina esploda.)