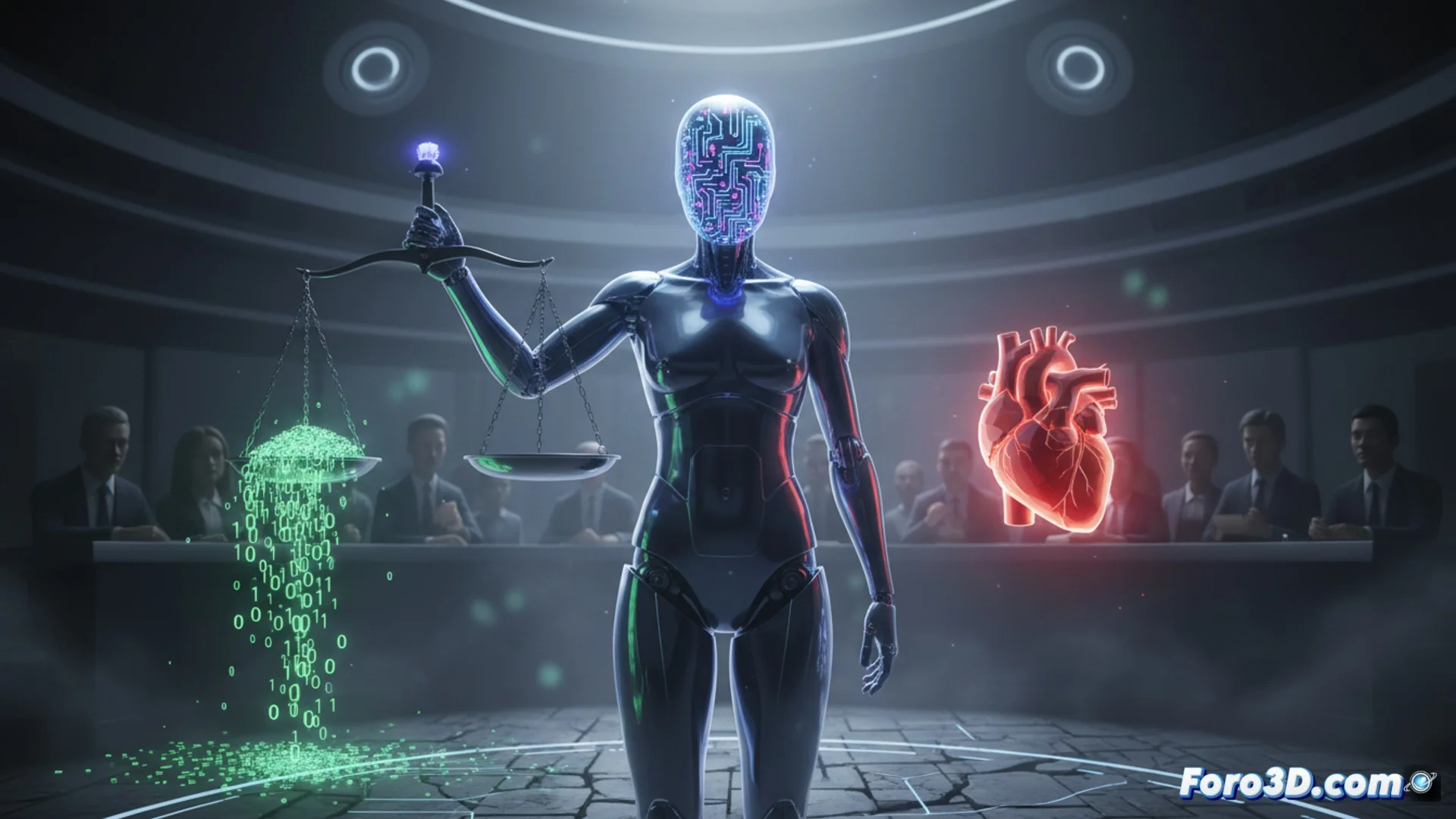

L'etica e la responsabilità nei sistemi di intelligenza artificiale

I sistemi di intelligenza artificiale ora decidono in ambiti vitali, dal concedere prestiti al rilevare patologie mediche. Questo genera un intenso dibattito pubblico sui principi etici e, soprattutto, su chi debba rispondere quando le cose vanno male. La conversazione non ruota solo attorno alla macchina, ma alle persone che la programmano, alimentano con dati e la mettono in funzione. 🤖

Il problema di fondo: i dati con pregiudizi

Un algoritmo di IA può solo imparare dalle informazioni che riceve. Se i set di dati storici includono discriminazioni umane, il sistema tenderà a replicarle e persino a potenziarle. Questo non rende la macchina "cattiva", ma evidenzia i fallimenti nella sua concezione. Per questo, l'obbligo primario spetta a chi seleziona le informazioni e stabilisce gli obiettivi del modello.

Misure chiave per mitigare i rischi:- Auditare costantemente come vengono raccolti e processati i dati.

- Definire chiaramente gli obiettivi che l'algoritmo deve perseguire.

- Supervisionare i risultati per identificare deviazioni indesiderate in tempo.

Pensare che un algoritmo sia neutrale per impostazione predefinita è corretto quanto aspettarsi che un manuale di istruzioni si scriva da solo. L'oggettività è un obiettivo, non un punto di partenza.

Un vuoto legale da colmare

Quando una decisione automatizzata causa un danno, determinare la colpa diventa un compito arduo. Deve rispondere il team che ha sviluppato il codice, l'organizzazione che lo ha implementato o l'operatore che lo ha usato senza analizzarlo? Regolamentazioni emergenti, come la bozza della Legge sull'IA dell'Unione Europea, cercano di creare quadri di responsabilità in base al livello di rischio. Tuttavia, portare queste norme alla pratica in situazioni concrete rappresenta una sfida giuridica monumentale, data la natura diffusa della catena decisionale. ⚖️

Entità potenzialmente responsabili:- Team di sviluppo e ingegneri che creano e addestrano i modelli.

- Aziende o istituzioni che dispiegano e usano il sistema.

- Utenti finali che applicano le raccomandazioni dell'algoritmo senza criterio proprio.

Conclusione: una responsabilità condivisa

La discussione sull'etica dell'IA trascende l'aspetto tecnico. Sottolinea che la tecnologia è un riflesso delle decisioni umane che ci sono dietro. Pertanto, garantire che questi sistemi agiscano in modo giusto richiede uno sforzo continuo e congiunto: dall'auditare i dati in ingresso alla definire quadri legali chiari. La responsabilità non è un attributo del software, ma un dovere di chi lo progetta, governa e utilizza.