AlignSAE migliora l'interpretazione dei modelli di linguaggio

Un nuovo approccio chiamato AlignSAE sta cambiando il modo in cui comprendiamo i modelli di linguaggio grandi. Questo metodo mappa concetti specifici a posizioni precise all'interno degli spazi latenti del modello, rendendo il suo funzionamento interno più accessibile e gestibile. 🧠

Un ponte tra concetti astratti e codice

La tecnica opera in due fasi fondamentali. Prima, una fase di addestramento non supervisionato esplora le attivazioni del modello per scoprire pattern e rappresentazioni interne in modo autonomo. Poi, una fase supervisionata si occupa di ancorare ogni concetto identificato a uno slot o spazio dedicato all'interno dell'architettura neurale. Questo ancoraggio è la chiave che permette successivamente di localizzare e manipolare idee in modo isolato.

Vantaggi chiave dell'ancoraggio dei concetti:- Permette di intervenire in modo causale nel modello, ad esempio, scambiando il concetto di "stile" senza alterare la "pose" di un personaggio.

- Facilita l'ispettione delle relazioni interne del modello, apportando trasparenza a un sistema che spesso funziona come una scatola nera.

- Converte il funzionamento del modello in qualcosa di più manipolabile, dando ai ricercatori un controllo preciso su attributi specifici.

Ora gli artisti potranno discutere se un cambiamento nel latente sia stato intenzionale o un glitch creativo, con argomenti tecnici reali.

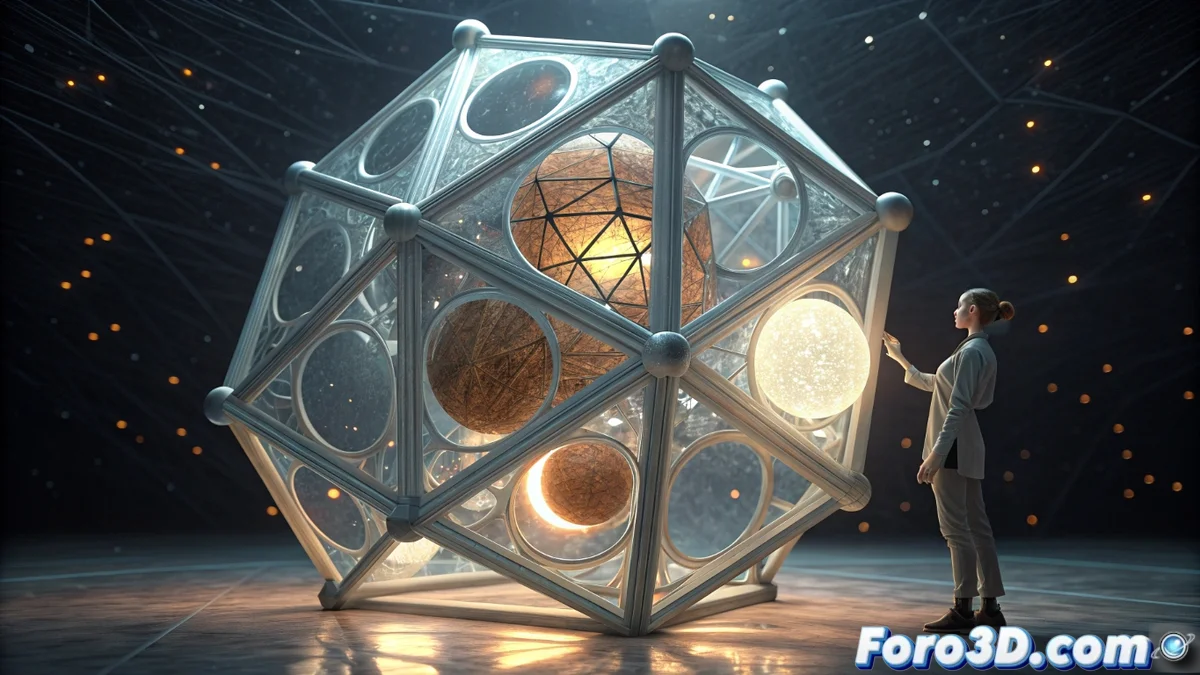

Applicazioni dirette in grafica 3D e generativa

Per la comunità di foro3d.com, questo avanzamento ha implicazioni pratiche immediate. Potendo editare attributi semantici concreti all'interno degli spazi latenti, si aprono nuove possibilità per flussi di lavoro creativi.

Potenziale per artisti e tecnici:- Editare attributi di immagine o scena 3D in modo isolato, come materiali, illuminazione o stile compositivo, senza influenzare altri elementi.

- Creare interfacce utente più stabili e prevedibili per manipolare gli spazi latenti in strumenti di generazione di immagini.

- Assistere processi di texture e modellazione con un controllo semantico fine, permettendo regolazioni basate su concetti invece di valori numerici astratti.

Verso strumenti creativi più trasparenti

Il risultato finale sono strumenti generativi che non solo producono, ma anche spiegano il loro processo. Gli artisti tecnici possono comprendere meglio perché un modello prende certe decisioni e regolare il suo comportamento basandosi su un ragionamento comprensibile, non su prove ed errori. Questo rappresenta un passo significativo per integrare l'intelligenza artificiale in modo più intuitivo e affidabile nelle pipeline di produzione visiva. 🎨