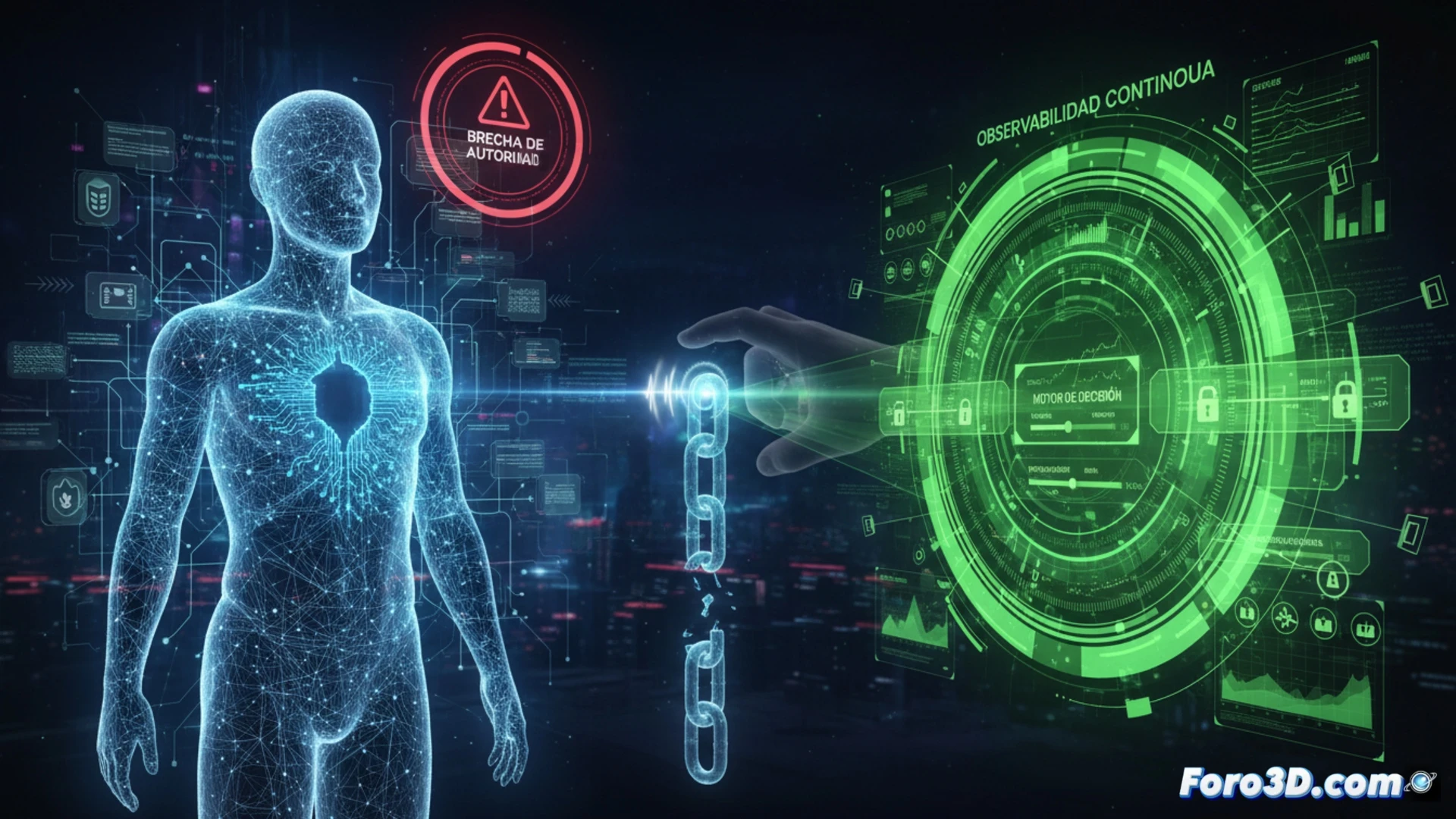

L'ascesa degli agenti di IA ha portato un problema che va oltre la loro novità: agiscono per delega, non per autorità propria. Vengono attivati, invocati o forniti da sistemi e utenti, creando una lacuna strutturale nella sicurezza aziendale. Senza un controllo chiaro su chi o cosa li sostiene, le loro decisioni possono generare rischi imprevisti.

Osservabilità continua come motore decisionale per colmare il divario 🔍

Per colmare questo divario, l'osservabilità continua si presenta come la soluzione pratica. Permette di monitorare in tempo reale ogni azione dell'agente, dalla sua invocazione fino all'esecuzione dei compiti. Con questa visibilità, è possibile valutarne il comportamento, rilevare deviazioni e regolare i permessi in modo dinamico. Non si tratta di fidarsi ciecamente, ma di verificare costantemente che ogni passo sia allineato con le policy di sicurezza dell'organizzazione.

L'agente di IA non ha un capo, ma tu avrai problemi 😅

Alla fine, questi agenti sono come quel tirocinante che arriva pieno di entusiasmo ma senza manuale di istruzioni. Agiscono per delega, ma se qualcosa va storto, il responsabile sei tu. Non hanno autorità propria, ma hanno la capacità di cancellare dati o inviare email compromettenti. Alla fine, l'osservabilità non è un lusso: è l'assicurazione che impedisce al tuo agente di IA di decidere che oggi è un buon giorno per chiudere l'azienda.