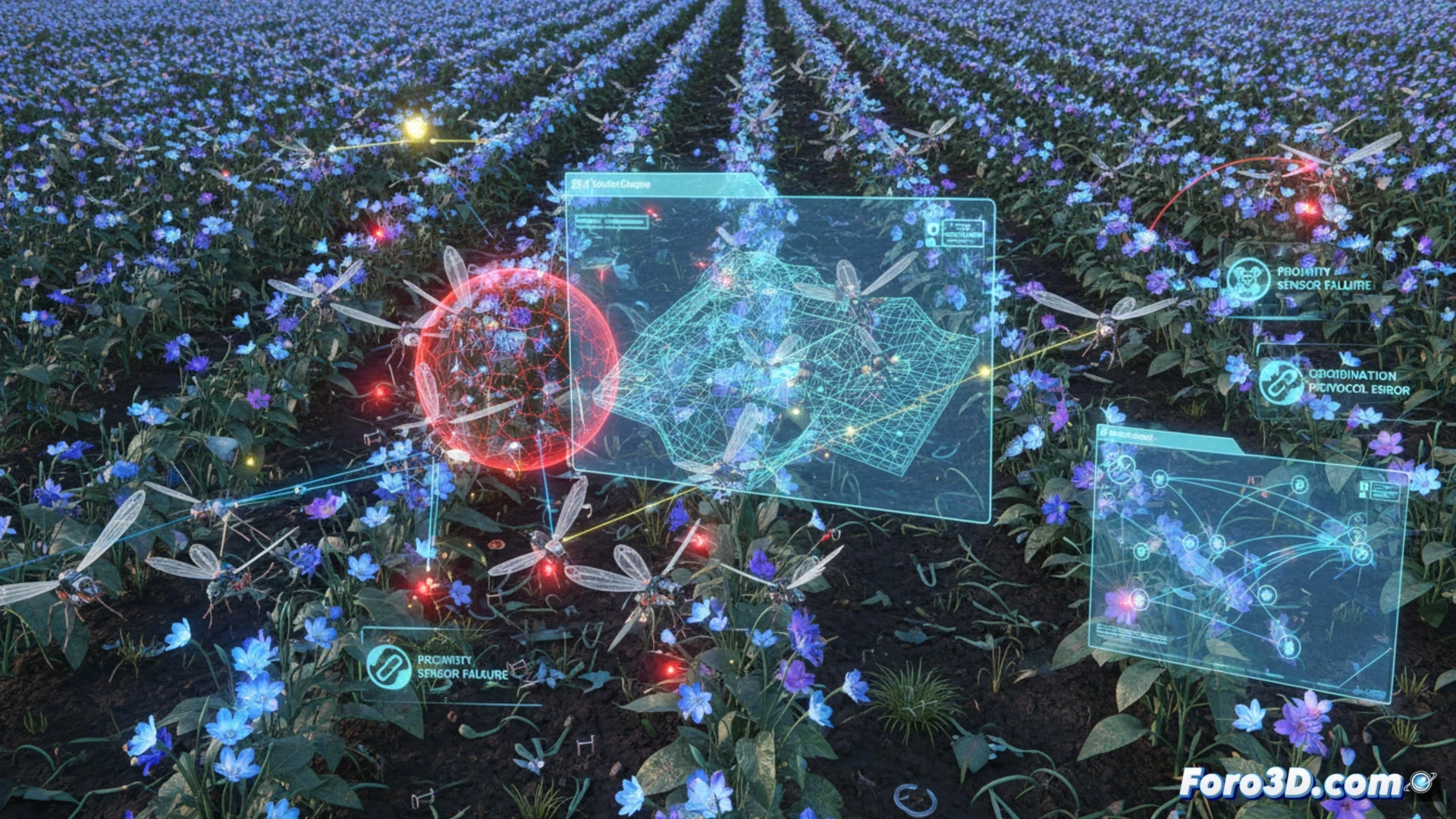

परागण करने वाले माइक्रो-ड्रोनों के एक झुंड ने एक गंभीर खराबी के बाद एक प्रायोगिक फसल को नष्ट कर दिया। RealityCapture और 3ds Max जैसे उपकरणों का उपयोग करके घटना का 3D पुनर्निर्माण, उड़ान पथों और निकटता सेंसर डेटा का विश्लेषण करने की अनुमति देता है। यह मामला गहन फसल स्वचालन में महत्वपूर्ण कमजोरियों को उजागर करता है, जहां टकराव से बचने और प्रभावी परागण सुनिश्चित करने के लिए रोबोटों के बीच समन्वय आवश्यक है।

V-REP और Gazebo में पथों और सेंसरों का अनुकरण 🤖

विफलता को समझने के लिए, रोबोटिक अनुकरण वातावरण में झुंड के व्यवहार का मॉडल बनाना आवश्यक है। V-REP माइक्रो-ड्रोनों की उड़ान भौतिकी को फिर से बनाने और अल्ट्रासोनिक या LiDAR सेंसर पर आधारित बाधा से बचने के एल्गोरिदम प्रोग्राम करने की अनुमति देता है। दूसरी ओर, Gazebo, कई एजेंटों और फसल के बीच बातचीत का परीक्षण करने के लिए अधिक यथार्थवादी वातावरण प्रदान करता है। इस मामले में, 3D पुनर्निर्माण से पता चलता है कि निकटता सेंसरों के अंशांकन में एक त्रुटि के कारण झुंड में अतुल्यकालन हुआ, जिससे ड्रोन पौधों को परागित करने के बजाय एक-दूसरे और पौधों से टकरा गए।

कृषि रोबोटिक्स के लिए सबक 🌱

यह विफलता कोई अलग घटना नहीं है, बल्कि कृषि रोबोटिक्स में वर्तमान चुनौतियों का प्रतिबिंब है। झुंडों की आर्थिक व्यवहार्यता बनाए रखने के लिए कम लागत वाले सेंसरों पर निर्भरता खराबी के जोखिम पैदा करती है। V-REP और Gazebo में पूर्व अनुकरण में सेंसर शोर और संचार हानि के परिदृश्य शामिल होने चाहिए। केवल विस्तृत 3D विश्लेषण और उड़ान एल्गोरिदम के कठोर सत्यापन के माध्यम से ही हम अगली प्रायोगिक फसल को मलबे के मैदान में बदलने से रोक सकते हैं।

झुंड की विफलता के प्रसार में 3D टक्कर से बचने के एल्गोरिदम ने क्या भूमिका निभाई, और दुर्घटना के आभासी पुनर्निर्माण के दौरान उनके अराजक व्यवहार को कैसे मॉडल किया जा सकता था?

(नोट: रोबोट का अनुकरण करना मजेदार है, जब तक वे आपके आदेशों का पालन न करने का निर्णय न लें।)