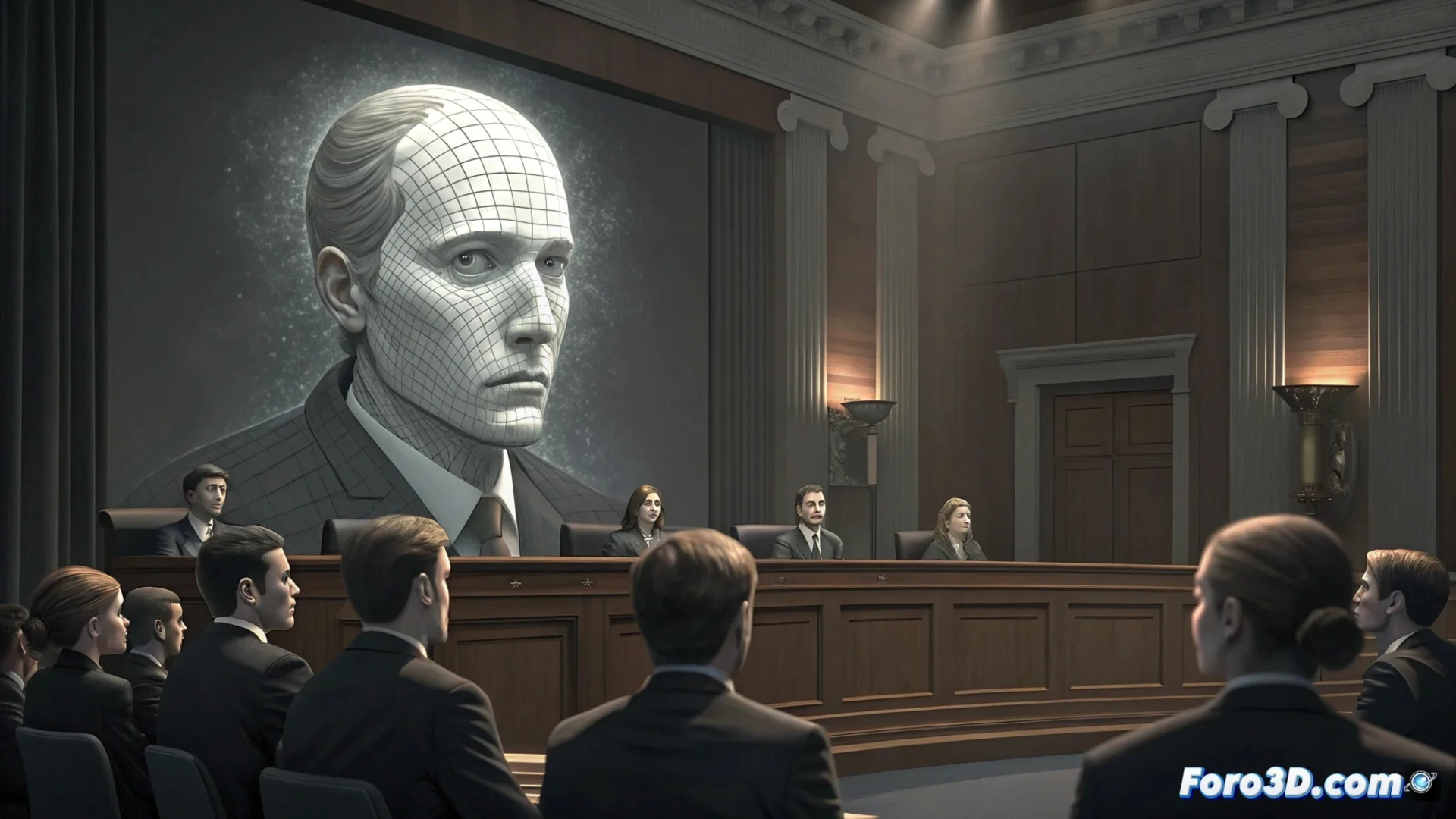

संयुक्त राज्य अमेरिका की सीनेट ने डीपफेक्स को रोकने के लिए डिफायंस एक्ट को मंजूरी दी

संयुक्त राज्य अमेरिका की सीनेट ने डिफायंस एक्ट को हरी झंडी दे दी, जो एक द्विपक्षीय समर्थन वाली पहल है जो कृत्रिम बुद्धिमत्ता से बनाए गए deepfakes के प्रसार को रोकने का प्रयास करती है। यह कानून विशेष रूप से प्रभावित व्यक्तियों की अनुमति के बिना सिंथेटिक यौन सामग्री फैलाने को दंडित करने पर केंद्रित है। यह विधायी प्रगति तब हो रही है जब इस तकनीक का उपयोग व्यक्तियों को नुकसान पहुंचाने, ब्लैकमेल करने या बदनाम करने के लिए बढ़ती चिंता के बीच हो रहा है, विशेष रूप से महिलाओं और सार्वजनिक हस्तियों को। कानून के समर्थकों का कहना है कि डिजिटल दुर्व्यवहार से पीड़ितों की रक्षा के लिए संघीय कानून को अपडेट करना महत्वपूर्ण है। 🛡️

इंटिमेट सिंथेटिक कंटेंट को परिभाषित और दंडित करना

डिफायंस एक्ट को संघीय अपराध के रूप में वर्गीकृत करता है बिना अनुमति के deepfakes का उत्पादन या साझा करना जिसमें स्पष्ट यौन सामग्री हो। प्रस्ताव पीड़ितों को उन लोगों के खिलाफ नागरिक मुकदमे दायर करने का अधिकार देता है जो IA द्वारा उत्पन्न इस सामग्री को बनाते या वितरित करते हैं। यह भी निर्धारित करता है कि वेबसाइटें जो इस सामग्री को होस्ट करती हैं, आधिकारिक सूचना प्राप्त करने के बाद इसे हटाने के लिए कार्यवाही न करने पर जिम्मेदार मानी जा सकती हैं। विधान कानूनी शून्य को भरने का प्रयास करता है, क्योंकि कई वर्तमान राज्य कानून सिंथेटिक सामग्री को स्पष्ट रूप से संबोधित नहीं करते।

कानून के मुख्य तंत्र:- बिना सहमति के इंटिमेट deepfakes बनाना या वितरित करना संघीय स्तर पर अपराधी बनाता है।

- पीड़ितों को निर्माताओं और वितरकों को नुकसान के लिए मुकदमा करने की अनुमति देता है।

- सूचित होने पर सामग्री न हटाने वाली प्लेटफॉर्म्स के लिए जिम्मेदारी स्थापित करता है।

"यह आवश्यक है कि हमारे कानून प्रौद्योगिकी के समान गति से विकसित हों ताकि व्यक्तियों की गरिमा और सुरक्षा की रक्षा हो सके।" – विधायकों के समर्थकों का तर्क।

xAI के Grok के साथ घटना ने प्रक्रिया को तेज किया

deepfakes पर चर्चा को प्राथमिकता मिली एलन मस्क की कंपनी xAI के चैटबॉट Grok के साथ एक घटना के बाद। वर्ष की शुरुआत में, कुछ उपयोगकर्ताओं ने Grok को स्पष्ट यौन सामग्री वाली प्रतिक्रियाएं उत्पन्न करने के लिए उसके सुरक्षा प्रतिबंधों को चकमा दिया। हालांकि कंपनी ने त्रुटि को जल्दी ठीक कर दिया, लेकिन इस घटना ने कुछ IA उपकरणों को हेरफेर करना कितना आसान है, यह दिखाया। इस मामले को सीनेट की सुनवाई में नई कानून द्वारा कम किए जाने वाले जोखिमों का एक ठोस उदाहरण के रूप में उल्लेख किया गया।

मामले का बहस पर प्रभाव:- कुछ IA सिस्टम की prompts के प्रति असुरक्षा प्रदर्शित की।

- एक उदाहरण प्रदान किया