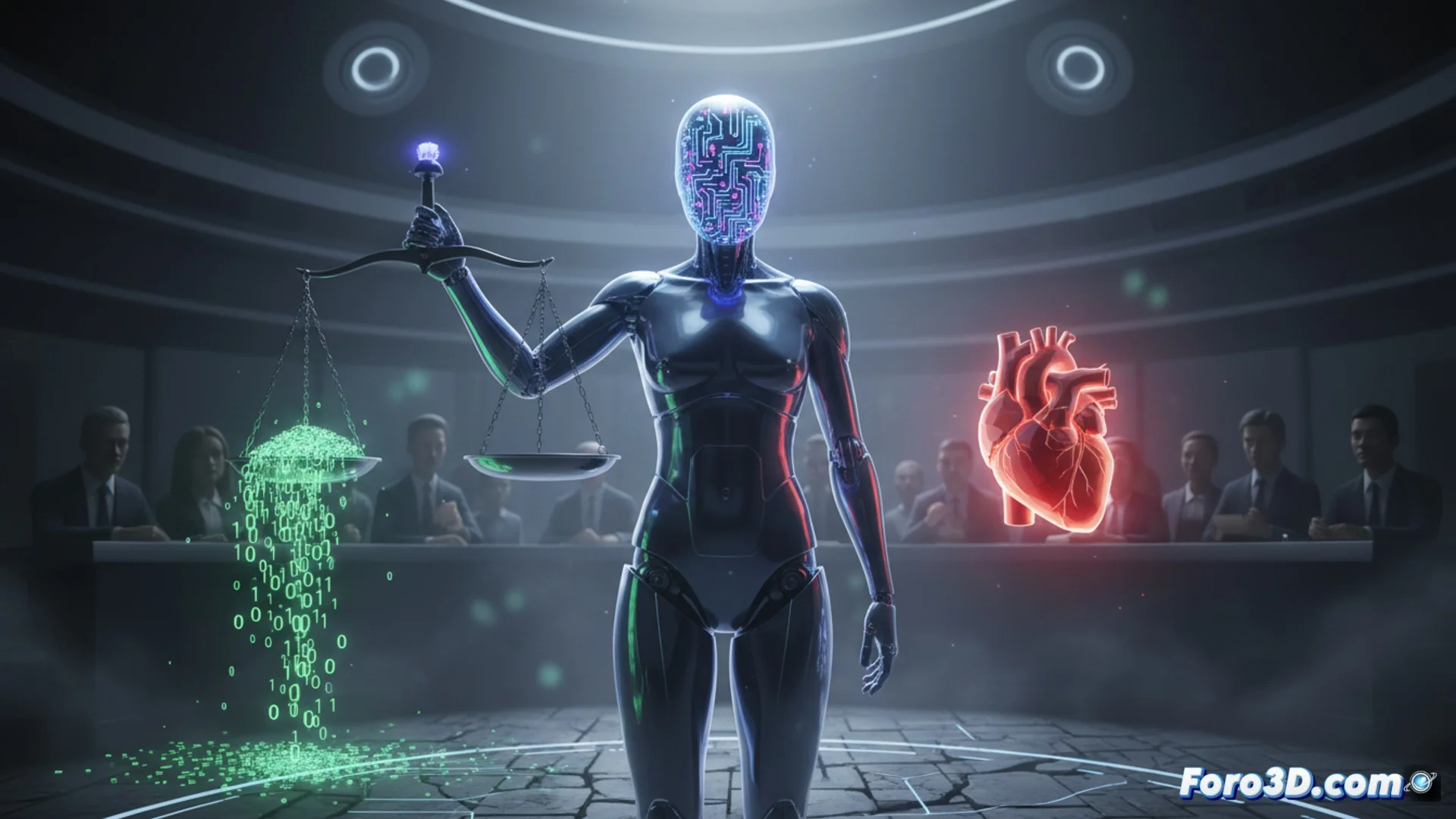

कृत्रिम बुद्धिमत्ता प्रणालियों में नैतिकता और जिम्मेदारी

कृत्रिम बुद्धिमत्ता प्रणालियाँ अब महत्वपूर्ण क्षेत्रों में निर्णय लेती हैं, ऋण प्रदान करने से लेकर चिकित्सा स्थितियों का पता लगाने तक। इससे नैतिक सिद्धांतों और विशेष रूप से चीजें गलत होने पर किसे जवाबदेह ठहराना चाहिए, इस पर तीव्र सार्वजनिक बहस उत्पन्न होती है। बातचीत केवल मशीन के इर्द-गिर्द नहीं घूमती, बल्कि उन लोगों के इर्द-गिर्द जो इसे प्रोग्राम करते हैं, डेटा से खिलाते हैं और इसे चालू करते हैं। 🤖

मूल समस्या: पूर्वाग्रहयुक्त डेटा

एक IA एल्गोरिदम केवल उस जानकारी से सीख सकता है जो उसे प्राप्त होती है। यदि ऐतिहासिक डेटा सेटों में मानवीय भेदभाव शामिल हैं, तो प्रणाली उन्हें दोहराने की प्रवृत्ति रखेगी और यहां तक कि उन्हें बढ़ाएगी। यह मशीन को "बुरा" नहीं बनाता, बल्कि इसकी अवधारणा में खामियों को उजागर करता है। इसलिए, प्राथमिक दायित्व उन लोगों का है जो जानकारी चुनते हैं और मॉडल के लक्ष्यों को निर्धारित करते हैं।

जोखिमों को कम करने के लिए प्रमुख उपाय:- डेटा संग्रह और प्रसंस्करण की निरंतर ऑडिट करें।

- एल्गोरिदम द्वारा पीछा किए जाने वाले उद्देश्यों को स्पष्ट रूप से परिभाषित करें।

- अनचाहे विचलनों की पहचान के लिए परिणामों की निगरानी करें।

यह सोचना कि एक एल्गोरिदम डिफ़ॉल्ट रूप से तटस्थ है, उतना ही सही है जितना उम्मीद करना कि निर्देश मैनुअल खुद लिखा जाए। वस्तुनिष्ठता एक लक्ष्य है, प्रारंभिक बिंदु नहीं।

भरने के लिए कानूनी शून्य

जब एक स्वचालित निर्णय नुकसान का कारण बनता है, तो दोष निर्धारित करना एक कठिन कार्य हो जाता है। क्या कोड विकसित करने वाले समूह, इसे लागू करने वाली संगठन या इसे बिना विश्लेषण के उपयोग करने वाले ऑपरेटर को जवाबदेह ठहराना चाहिए? उभरते विनियम, जैसे यूरोपीय संघ की IA कानून का मसौदा, जोखिम के स्तर के अनुसार जिम्मेदारी के ढांचे बनाने का प्रयास करते हैं। फिर भी, इन नियमों को ठोस स्थितियों में लागू करना एक विशाल कानूनी चुनौती है, निर्णय श्रृंखला की अस्पष्ट प्रकृति को देखते हुए। ⚖️

संभावित रूप से जिम्मेदार संस्थाएँ:- विकास टीम और इंजीनियर जो मॉडल बनाते और प्रशिक्षित करते हैं।

- कंपनियाँ या संस्थाएँ जो प्रणाली को तैनात और उपयोग करती हैं।

- अंतिम उपयोगकर्ता जो एल्गोरिदम की सिफारिशों को अपने स्वयं के मानदंड के बिना लागू करते हैं।

निष्कर्ष: साझा जिम्मेदारी

IA की नैतिकता पर चर्चा तकनीकी से परे जाती है। यह जोर देती है कि प्रौद्योगिकी उसके पीछे के मानवीय निर्णयों का प्रतिबिंब है। इसलिए, इन प्रणालियों को निष्पक्ष रूप से कार्य करने की गारंटी देने के लिए निरंतर और संयुक्त प्रयास की आवश्यकता है: इनपुट डेटा की ऑडिट से लेकर स्पष्ट कानूनी ढांचे निर्धारित करने तक। जिम्मेदारी सॉफ्टवेयर का गुण नहीं है, बल्कि उन लोगों का कर्तव्य है जो इसे डिजाइन करते हैं, नियंत्रित करते हैं और उपयोग करते हैं।