AI एजेंटों के उदय ने एक ऐसी समस्या ला दी है जो उनकी नवीनता से परे है: वे अपने स्वयं के अधिकार से नहीं, बल्कि प्रतिनिधि के रूप में कार्य करते हैं। वे सिस्टम और उपयोगकर्ताओं द्वारा सक्रिय, आह्वान या प्रावधानित किए जाते हैं, जो उद्यम सुरक्षा में एक संरचनात्मक अंतर पैदा करता है। उनका समर्थन कौन या क्या करता है, इस पर स्पष्ट नियंत्रण के बिना, उनके निर्णय अप्रत्याशित जोखिम पैदा कर सकते हैं।

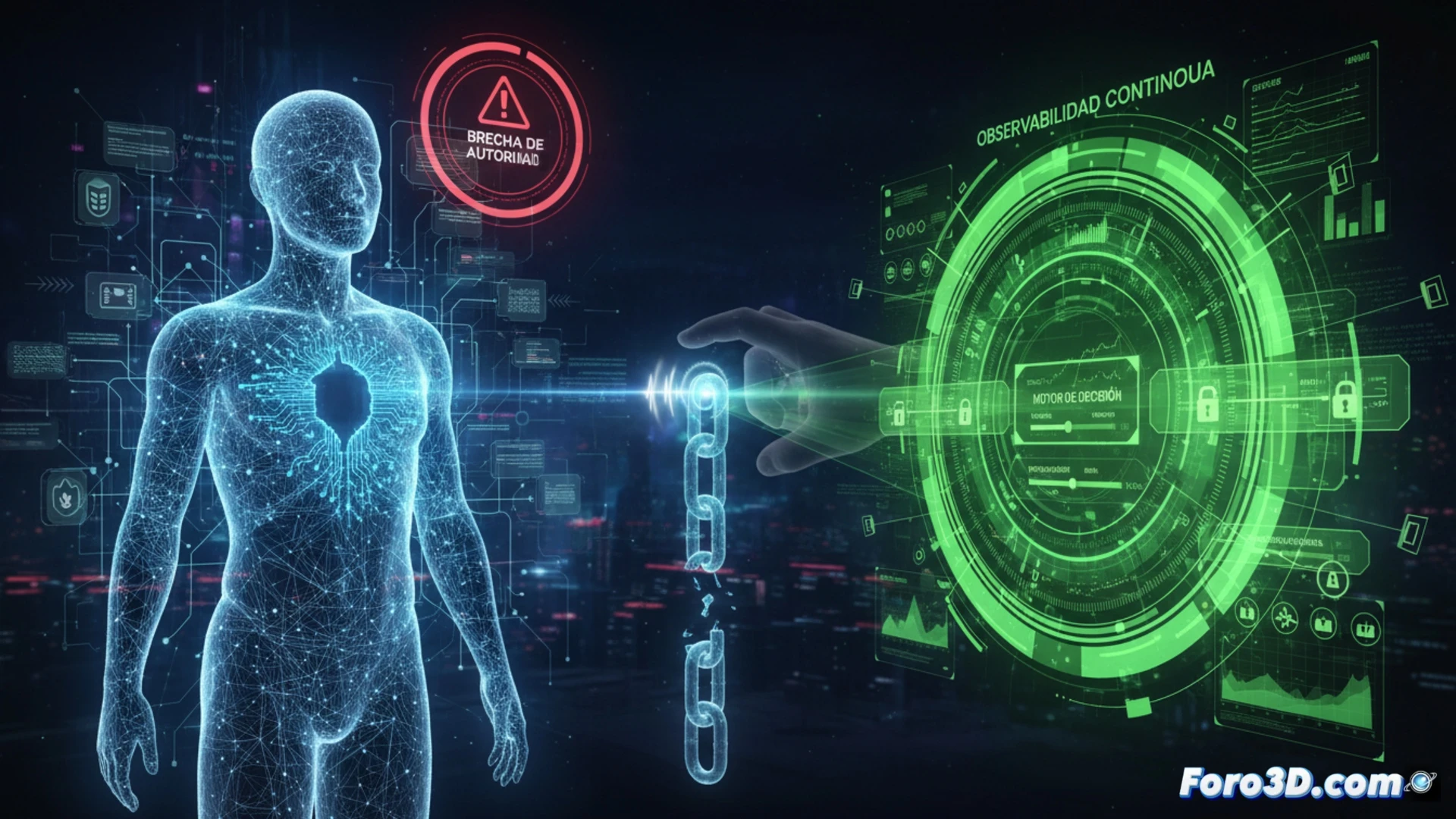

अंतर को पाटने के लिए निर्णय इंजन के रूप में सतत अवलोकन क्षमता 🔍

इस अंतर को पाटने के लिए, सतत अवलोकन क्षमता एक व्यावहारिक समाधान के रूप में सामने आती है। यह एजेंट के आह्वान से लेकर कार्यों के निष्पादन तक, प्रत्येक क्रिया की वास्तविक समय में निगरानी करने की अनुमति देता है। इस दृश्यता के साथ, इसके व्यवहार का मूल्यांकन करना, विचलन का पता लगाना और गतिशील रूप से अनुमतियों को समायोजित करना संभव है। यह आँख बंद करके भरोसा करने के बारे में नहीं है, बल्कि लगातार यह सत्यापित करने के बारे में है कि प्रत्येक कदम संगठन की सुरक्षा नीतियों के अनुरूप है।

AI एजेंट का कोई बॉस नहीं है, लेकिन आपको निश्चित रूप से समस्याएँ होंगी 😅

पता चला है कि ये एजेंट उस इंटर्न की तरह हैं जो बहुत उत्साह के साथ आता है लेकिन बिना किसी निर्देश पुस्तिका के। वे प्रतिनिधि के रूप में कार्य करते हैं, लेकिन अगर कुछ गलत होता है, तो जिम्मेदार आप हैं। उनके पास अपना कोई अधिकार नहीं है, लेकिन डेटा मिटाने या समझौता करने वाले ईमेल भेजने की क्षमता है। अंत में, अवलोकन क्षमता कोई विलासिता नहीं है: यह वह बीमा है जो आपके AI एजेंट को यह तय करने से रोकता है कि आज आपकी कंपनी बंद करने का एक अच्छा दिन है।