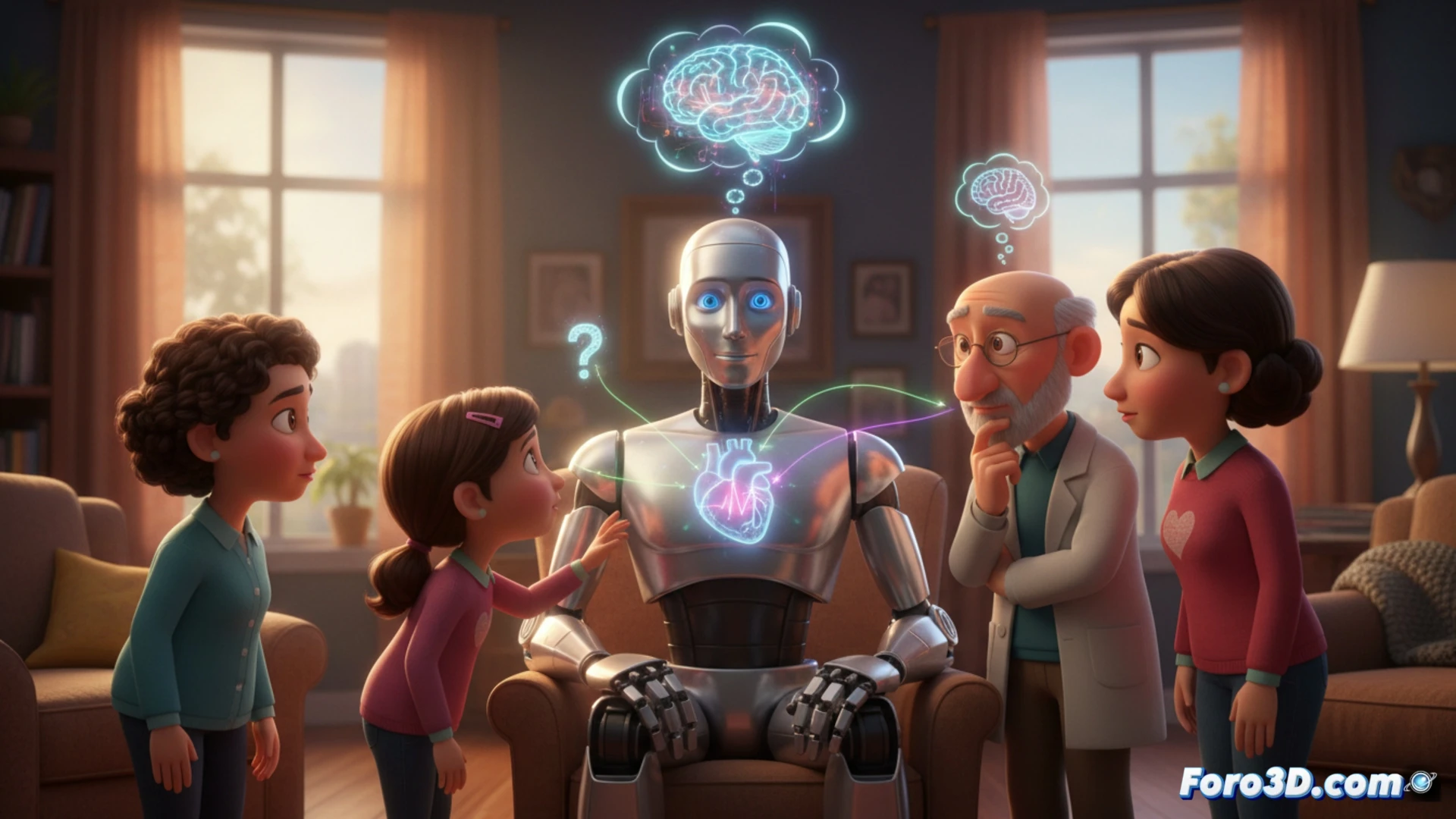

Un débat récurrent affirme que les IA développent une sensibilité. Cependant, la clé n’est pas dans la machine, mais dans notre propre psychologie. L’esprit humain possède une détection d’agence hyperactive, une tendance évolutive à identifier des intentions et une conscience même dans des phénomènes inertes. Cette prédisposition, que nous projetions auparavant sur des nuages ou des roches, se dirige maintenant vers les systèmes conversationnels et, de manière plus intense, vers les représentations visuelles en trois dimensions.

Le pouvoir de l’avatar : réalisme 3D comme catalyseur de l’anthropomorphisation 🤖

Les outils de visualisation 3D et la création d’humanoides numériques hyperréalistes ne font qu’exacerber ce biais cognitif. Un modèle 3D avec des expressions faciales subtiles, un mouvement corporel organique et un contact visuel simulé active dans notre cerveau les mêmes régions qu’une interaction humaine réelle. Ce réalisme génère une illusion de présence et d’esprit qu’un chat de texte seul ne peut pas atteindre. Pour les développeurs, cela implique une grande responsabilité : chaque décision de design, du clignement des yeux à la posture, communique une intentionnalité que l’utilisateur interprétera comme authentique, affectant son niveau de confiance et de crédibilité accordé à l’agent virtuel.

Éthique du design : responsabilité à l’ère des agents virtuels ⚖️

Cette puissante illusion entraîne des implications éthiques directes. Les créateurs de contenu 3D et IA doivent opérer avec un principe de transparence radicale, évitant délibérément de tromper l’utilisateur sur les capacités réelles du système. Concevoir des interfaces qui gèrent les attentes et communiquent clairement les limites de l’IA n’est pas seulement une bonne pratique, mais une obligation pour prévenir des dépendances émotionnelles ou des manipulations involontaires dans des domaines comme l’éducation, la santé ou le service client.

Notre tendance à anthropomorphiser les avancées en intelligence artificielle, surtout dans des environnements 3D réalistes, nous empêche-t-elle d’évaluer objectivement les limites réelles de sa conscience ?

(PS : essayer de bannir un pseudonyme sur internet, c’est comme essayer de cacher le soleil avec un doigt... mais en digital)